Merge pull request #93 from zhaopu7/develop

update language model's README

Showing

212.8 KB

language_model/images/ps.png

已删除

100644 → 0

1.8 KB

language_model/images/ps2.png

已删除

100644 → 0

1.6 KB

167.4 KB

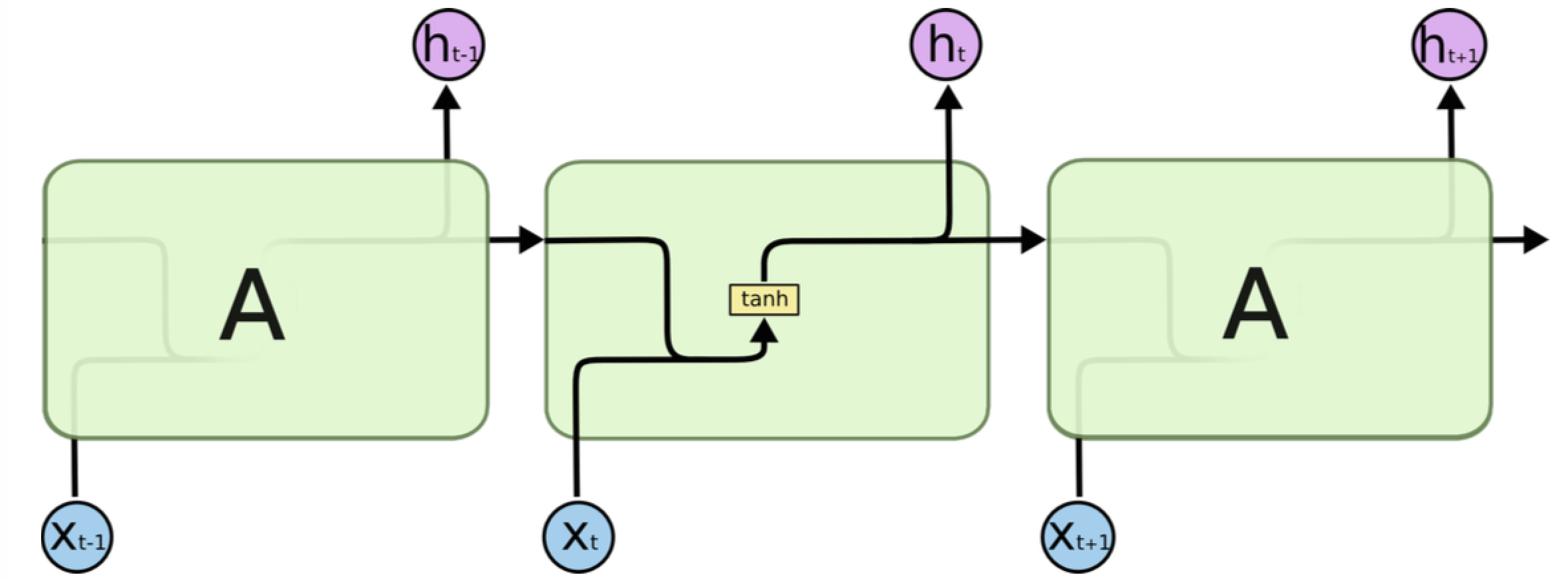

language_model/images/s.png

已删除

100644 → 0

720 字节