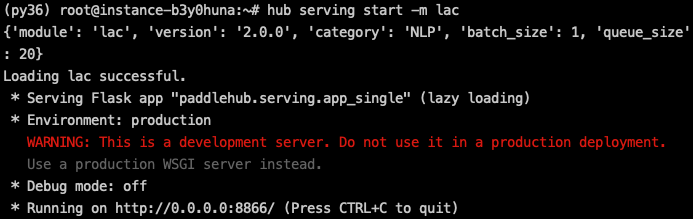

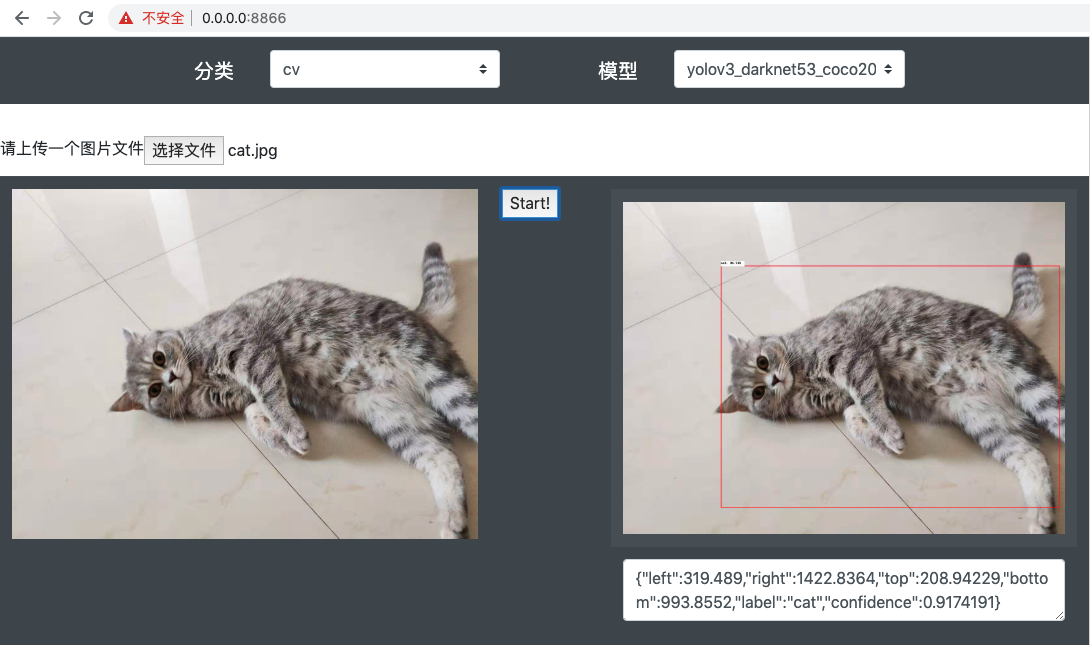

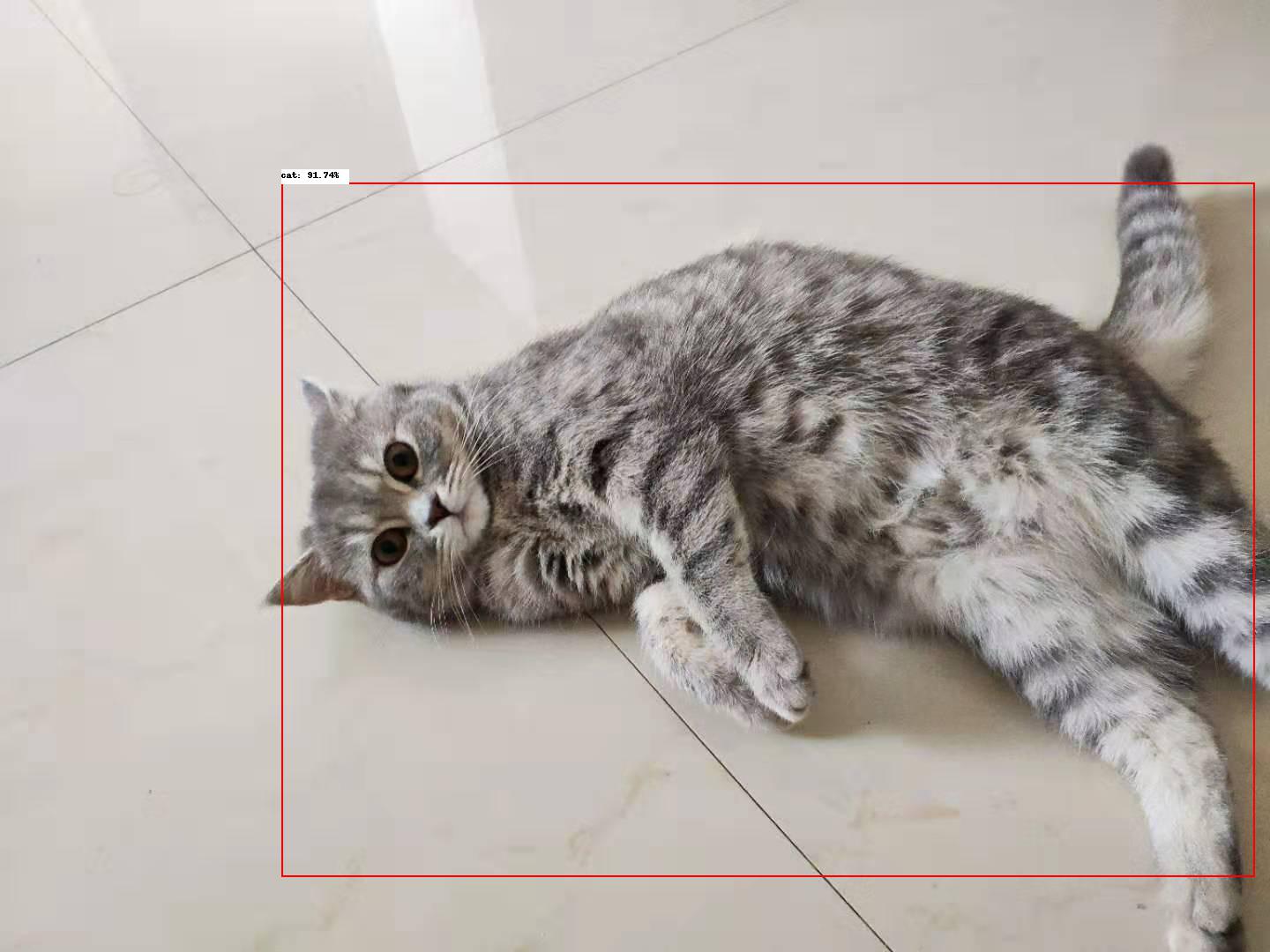

update serving demo

Showing

28.5 KB

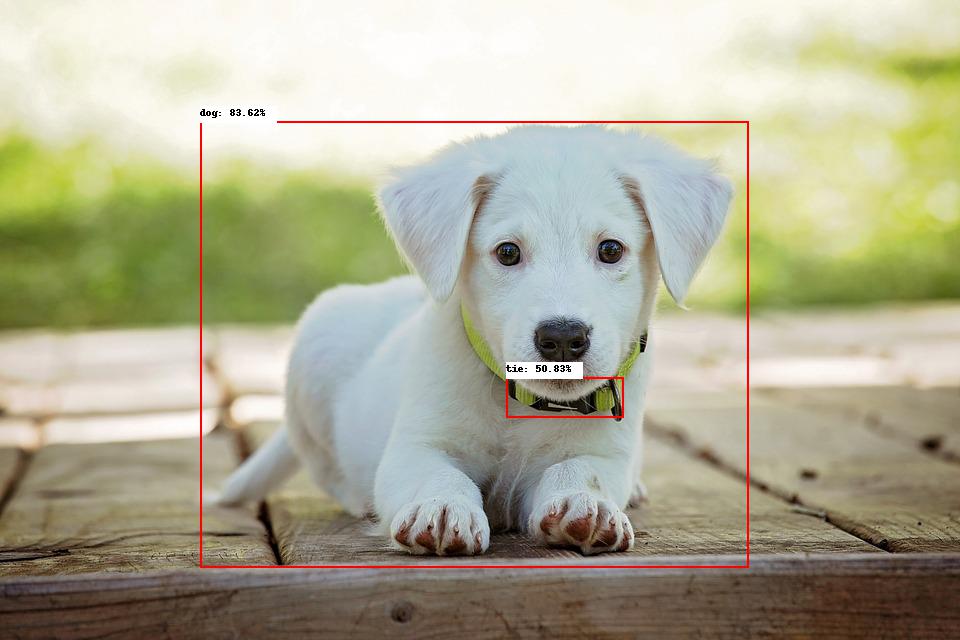

demo/serving/serving/README.md

0 → 100644

文件已移动

文件已移动

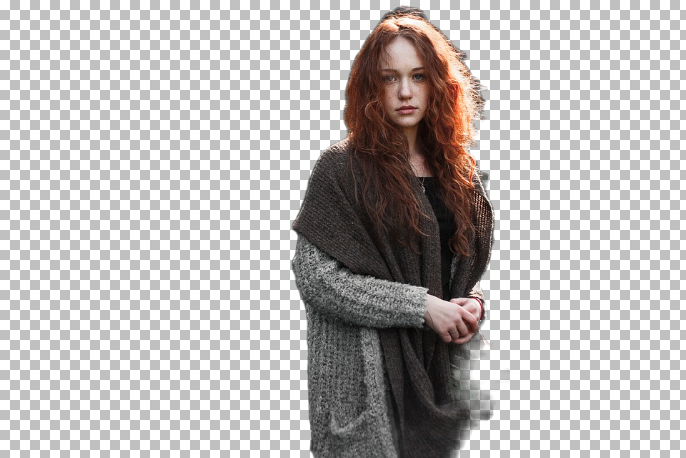

demo/serving/serving/img/man.png

0 → 100644

88.0 KB

39.6 KB

366.7 KB

文件已移动

文件已移动

文件已移动

125.2 KB

58.9 KB

文件已移动

文件已移动

304.2 KB