更新了文档

Showing

426.9 KB

232.6 KB

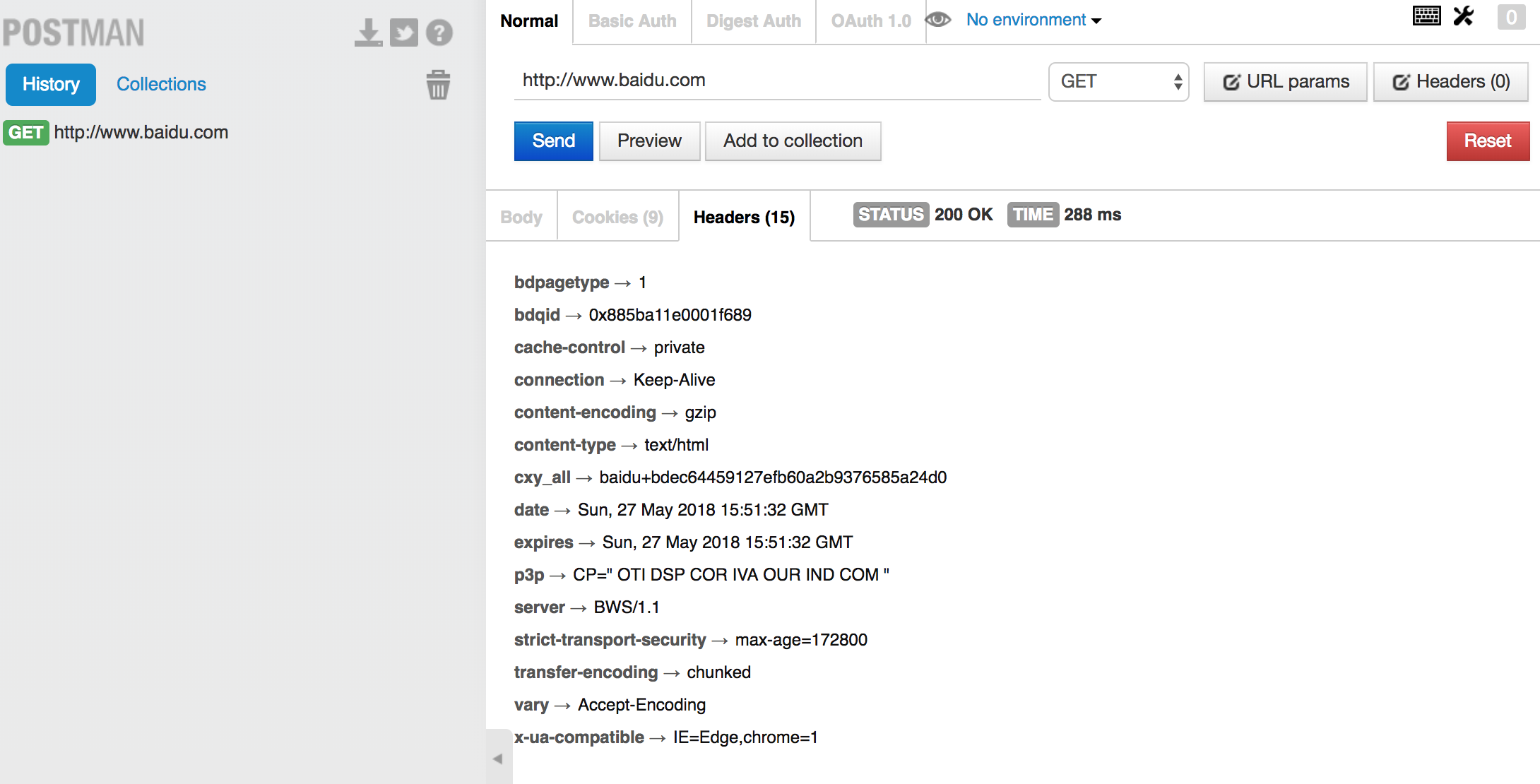

Day66-75/res/postman.png

0 → 100644

329.2 KB

Day66-75/存储数据.md

0 → 100644

Day66-75/数据清洗.md

0 → 100644

Day66-75/爬虫中的陷阱.md

已删除

100644 → 0

Day66-75/缓存数据.md

已删除

100644 → 0

Day66-75/网络爬虫和相关工具.md

0 → 100644

Day66-75/网络爬虫简介和相关工具.md

已删除

100644 → 0