updata doc of infer

Showing

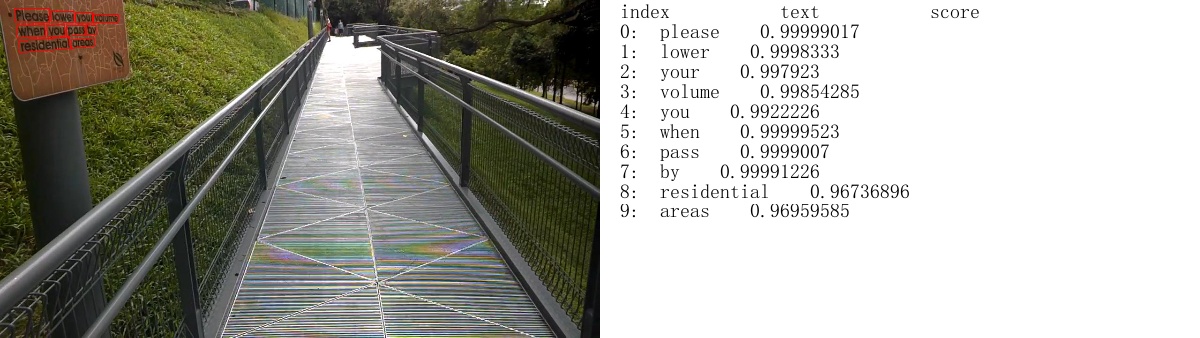

doc/imgs_en/img_10.jpg

0 → 100644

175.6 KB

doc/imgs_en/img_11.jpg

0 → 100644

140.1 KB

doc/imgs_en/img_195.jpg

0 → 100644

70.9 KB

doc/imgs_results/det_res_2.jpg

0 → 100644

79.5 KB

330.5 KB

331.4 KB

doc/imgs_results/img_10.jpg

0 → 100644

147.6 KB

doc/imgs_words_en/.DS_Store

0 → 100644

文件已添加

doc/imgs_words_en/word_10.png

0 → 100644

5.6 KB

doc/imgs_words_en/word_116.png

0 → 100644

72.4 KB

doc/imgs_words_en/word_19.png

0 → 100644

7.1 KB

doc/imgs_words_en/word_201.png

0 → 100644

6.2 KB

doc/imgs_words_en/word_308.png

0 → 100644

17.9 KB

doc/imgs_words_en/word_336.png

0 → 100644

17.1 KB

doc/imgs_words_en/word_401.png

0 → 100644

18.3 KB

doc/imgs_words_en/word_461.png

0 → 100644

18.8 KB

doc/imgs_words_en/word_52.png

0 → 100644

16.1 KB

doc/imgs_words_en/word_545.png

0 → 100644

27.9 KB