Remove CN comments in roadsign config. (#1791)

* Update QUICK_STARTED_cn.md (#1757) fix typo * cherry-pick #1757 and #1473, test=document_fix

Showing

273.6 KB

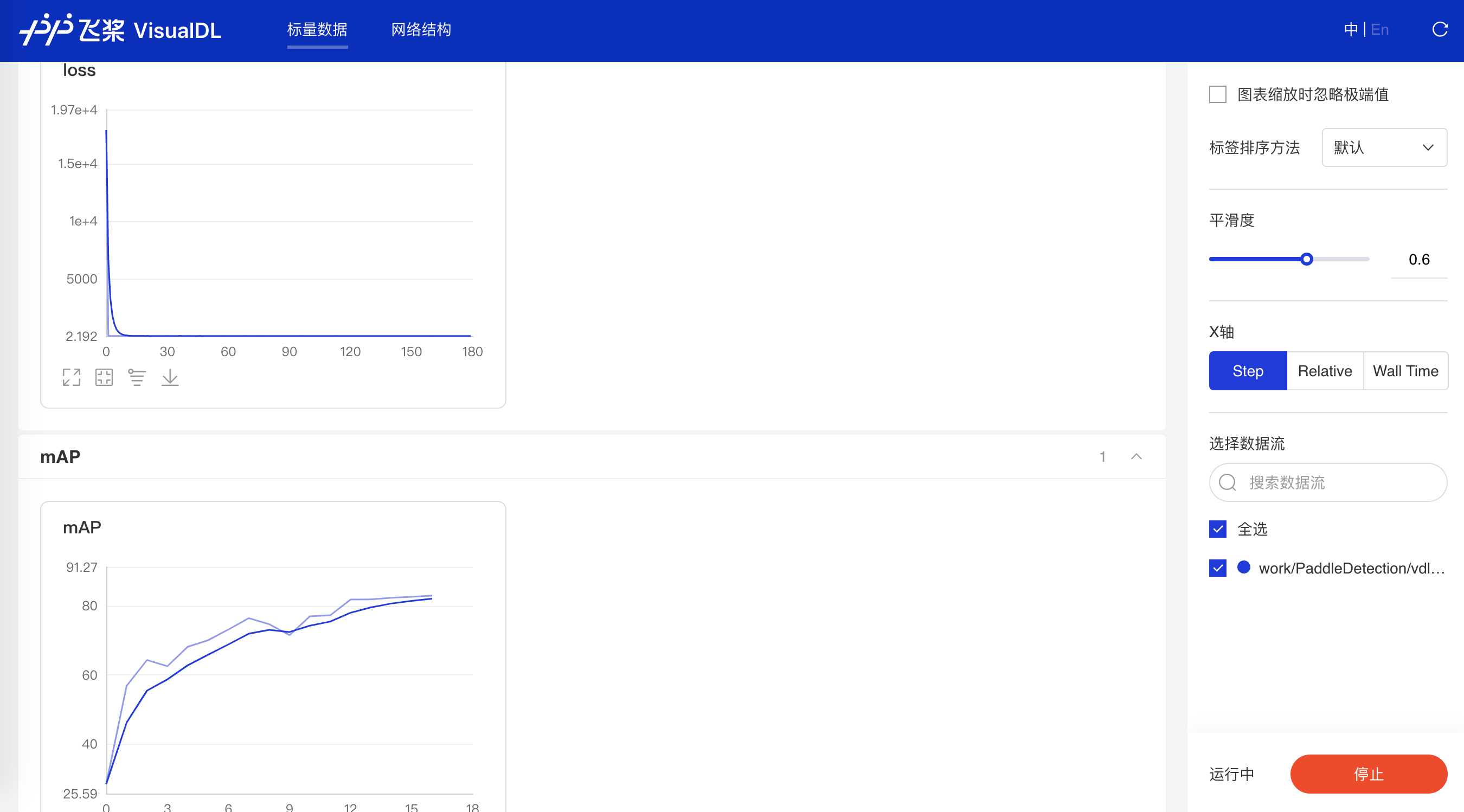

docs/images/visualdl_roadsign.png

0 → 100644

216.8 KB

* Update QUICK_STARTED_cn.md (#1757) fix typo * cherry-pick #1757 and #1473, test=document_fix

273.6 KB

216.8 KB