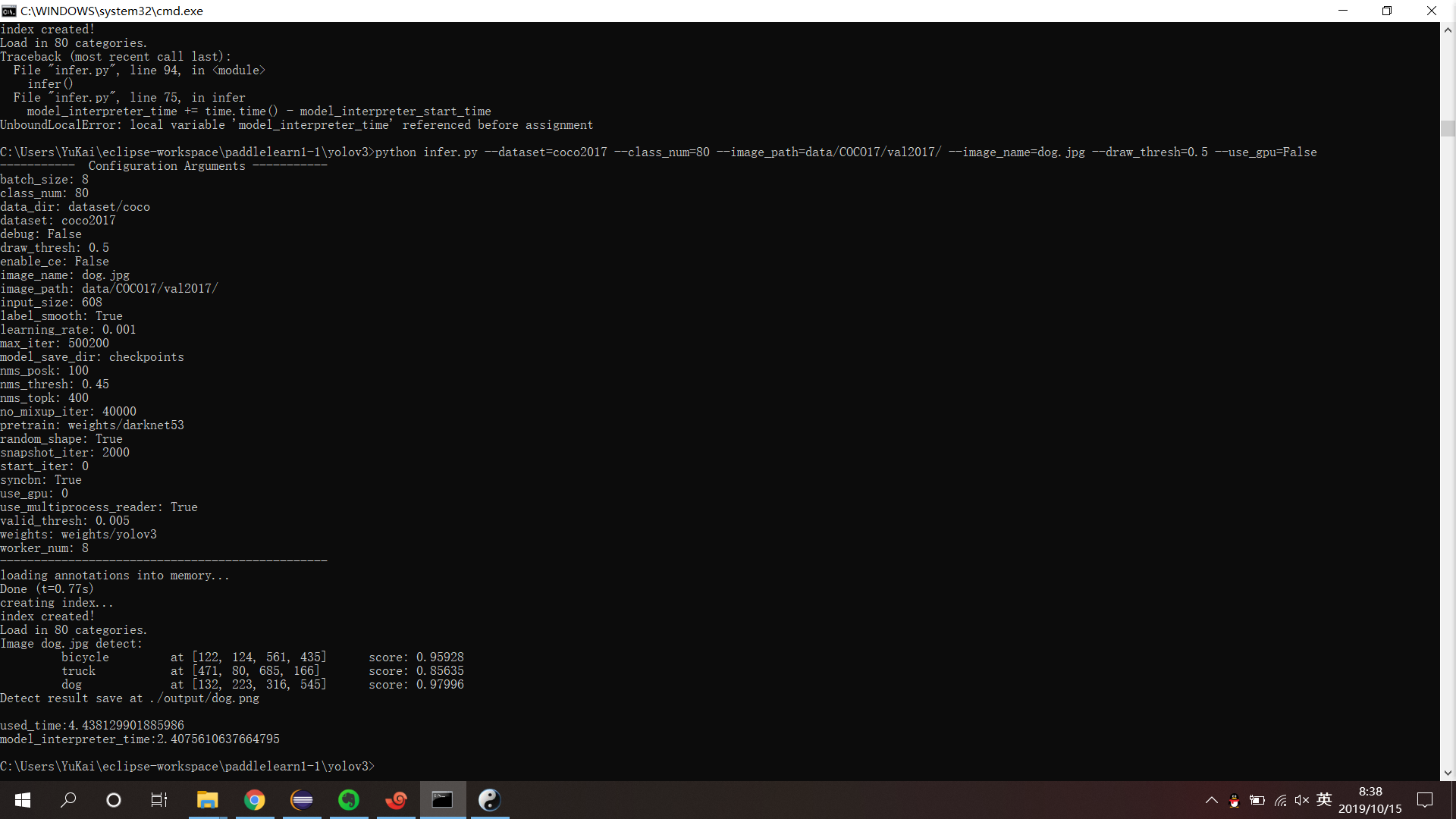

采用win10笔记本电脑跑YOLOV3模型推理的耗时2.4s

Created by: dhdljd

屏幕截图如上,其中,used_time:4.438s代表从模型加载到推理完成的时间,model_interpreter_time:2.407s代表从模型开始推理到结束的时间。 采用官方提供的infer文件、权重。 环境是: 联想x1笔记本电脑; noGPU 酷睿i5CPU win10系统。 请问,这样的耗时是否正常?是否需要在什么地方做优化?

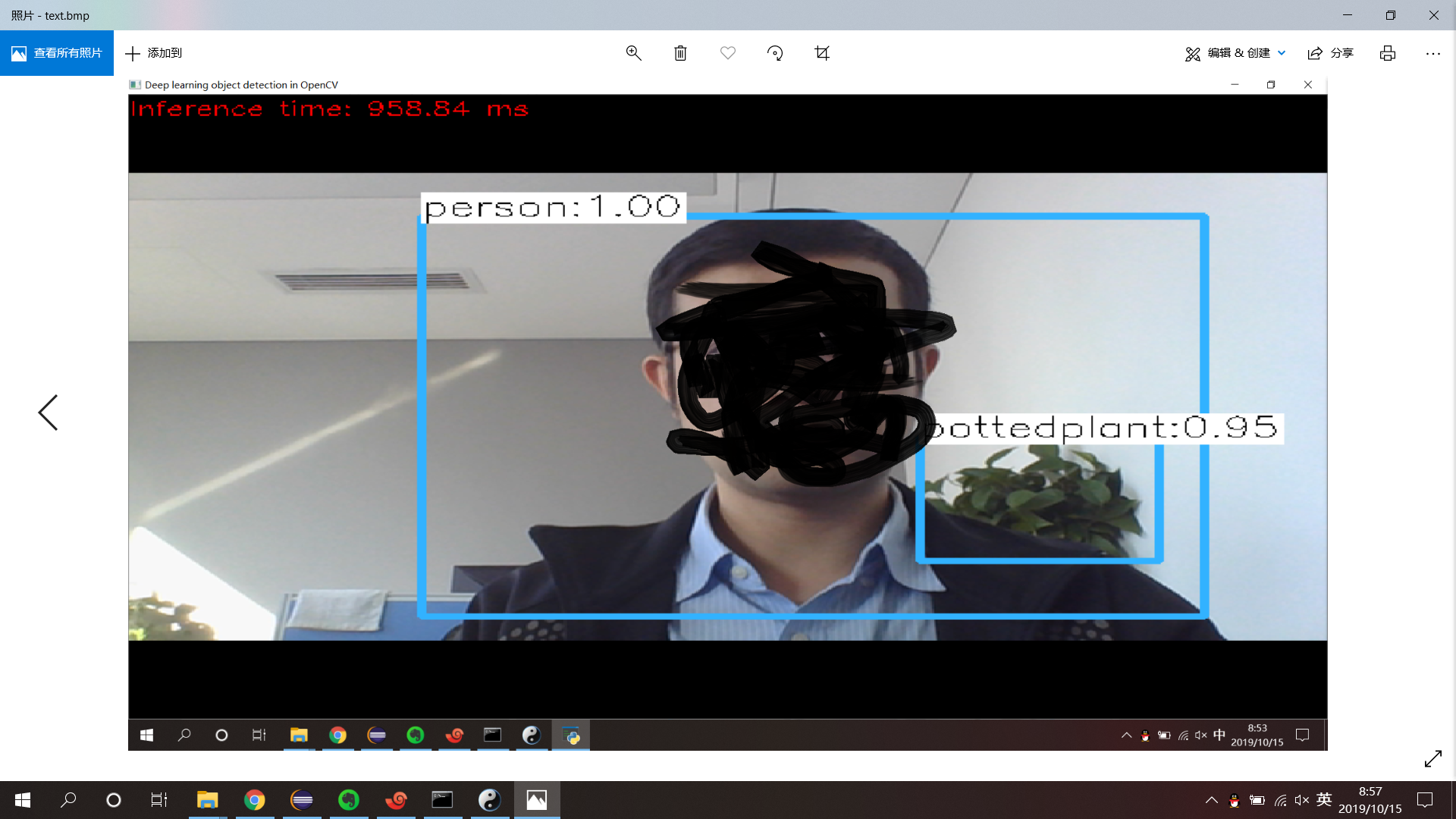

另外,在同样的平台,采用opencv+YOLOV3模型,耗时在500~1000ms之间,调用的opencv语句是:

label = 'Inference time: %.2f ms' % (t * 1000.0 / cv.getTickFrequency())

截图如下:

在同样的平台,采用tensorflow跑lite模型,耗时基本上也要在500ms以上。