Merge pull request #84 from wangjiawei04/master

Add one-click Baiduyun CTR document (master branch)

Showing

doc/ELASTIC_CTR.rst

0 → 100644

doc/elastic_ctr/ctr.png

0 → 100644

164.3 KB

114.9 KB

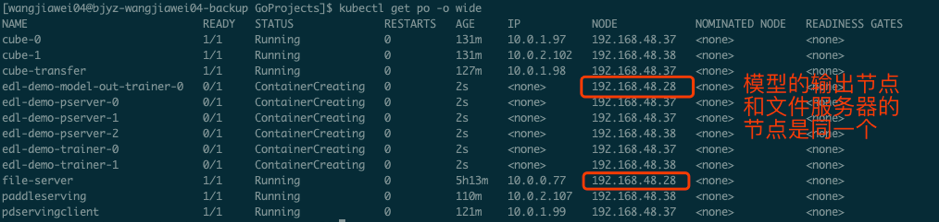

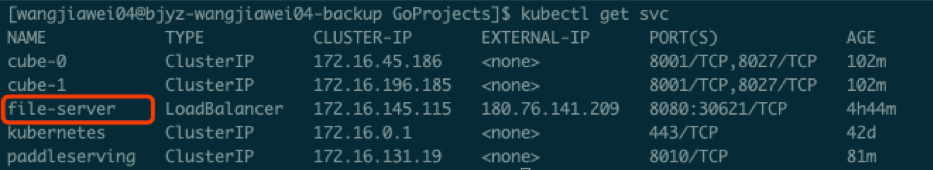

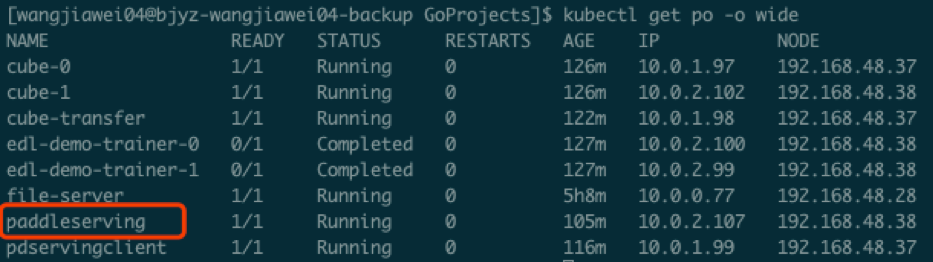

doc/elastic_ctr/ctr_node.png

0 → 100644

74.6 KB

doc/elastic_ctr/ctr_pods.png

0 → 100644

186.9 KB

341.8 KB

777.4 KB

155.7 KB

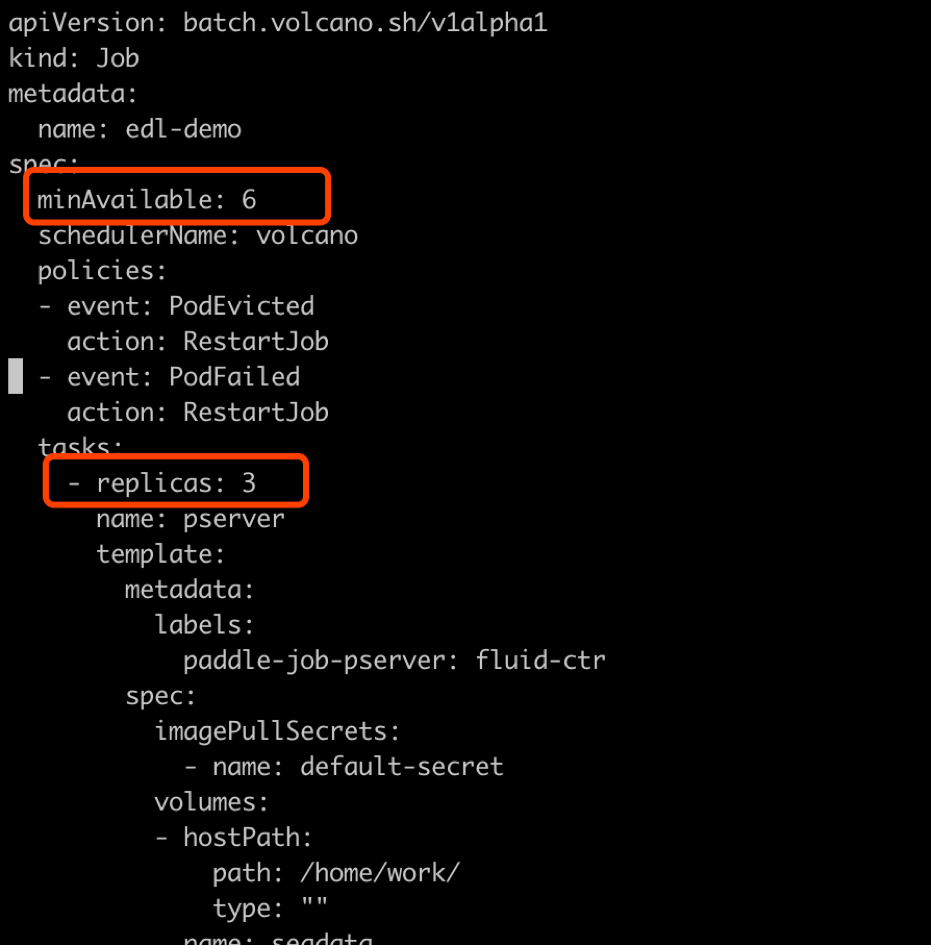

doc/elastic_ctr/ctryaml1.png

0 → 100644

131.0 KB

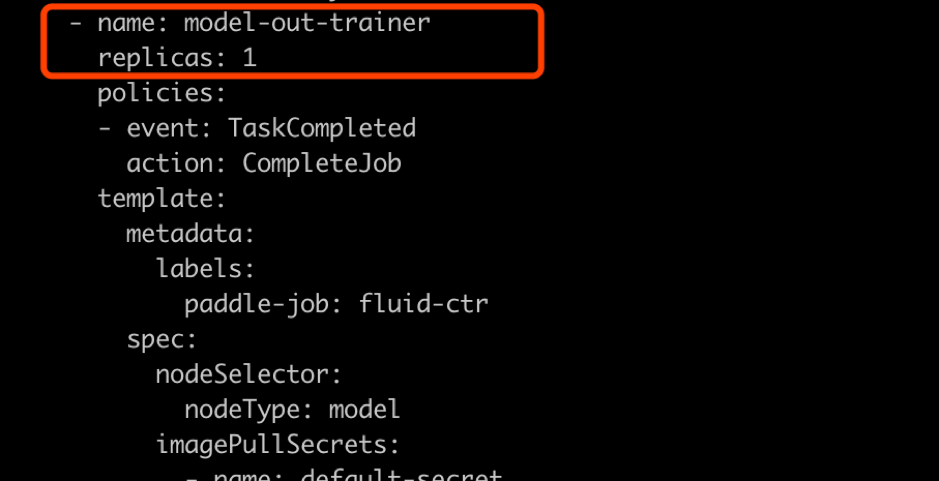

doc/elastic_ctr/ctryaml2.png

0 → 100644

65.6 KB

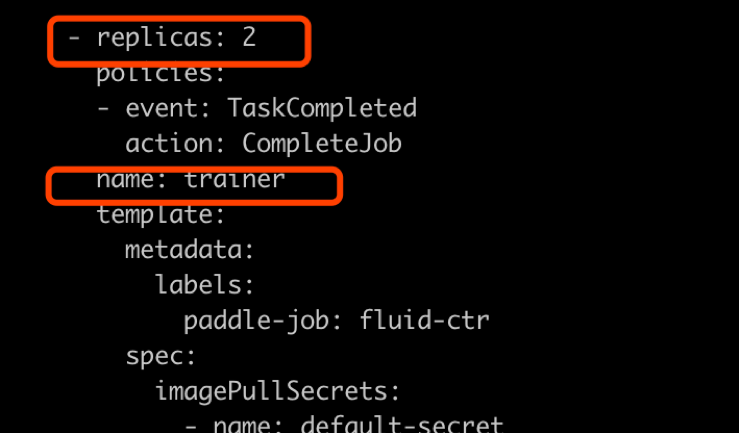

doc/elastic_ctr/ctryaml3.png

0 → 100644

56.3 KB

doc/elastic_ctr/cube.png

0 → 100644

104.4 KB

doc/elastic_ctr/cube_config1.png

0 → 100644

178.2 KB

doc/elastic_ctr/cube_config2.png

0 → 100644

107.1 KB

150.9 KB

98.0 KB

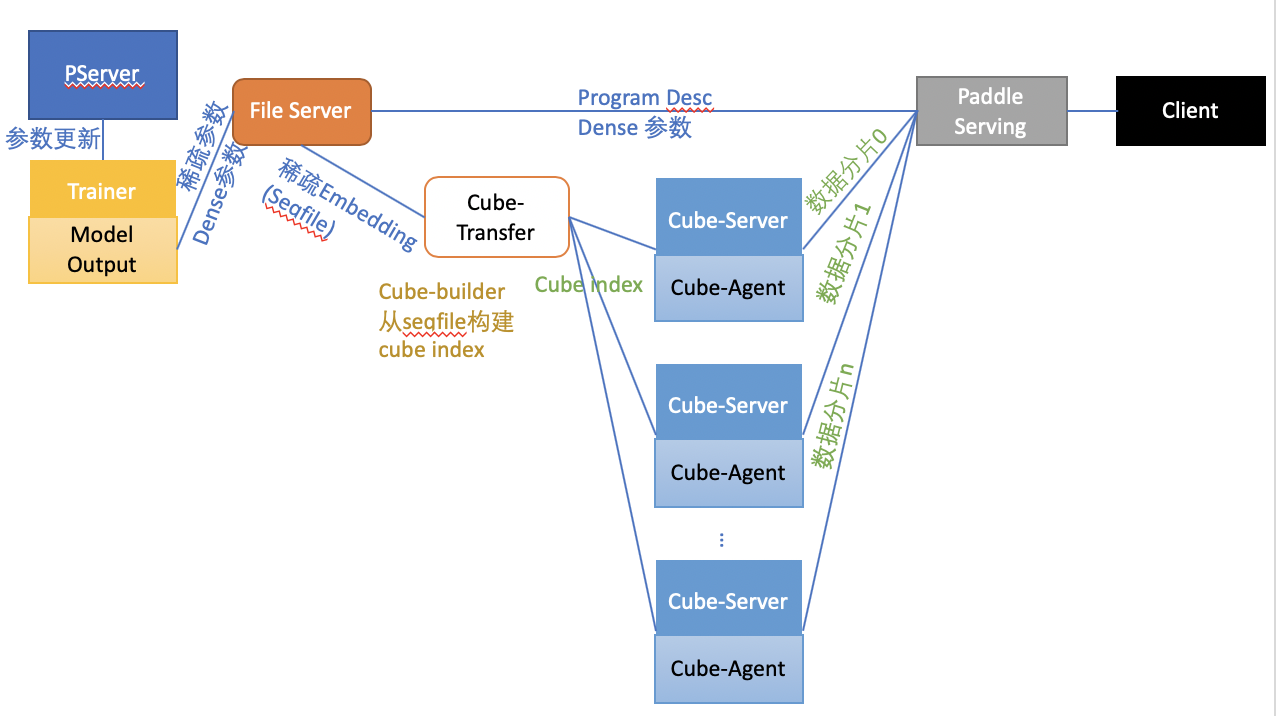

doc/elastic_ctr/overview.png

0 → 100644

228.5 KB

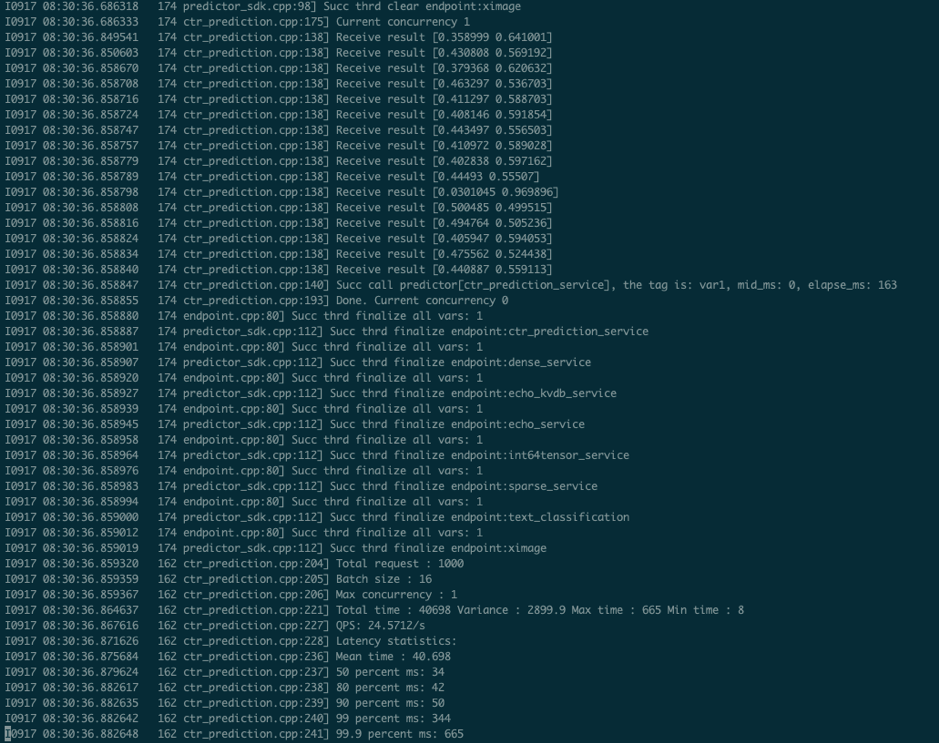

doc/elastic_ctr/paddleclient.png

0 → 100644

547.4 KB

145.4 KB

104.8 KB

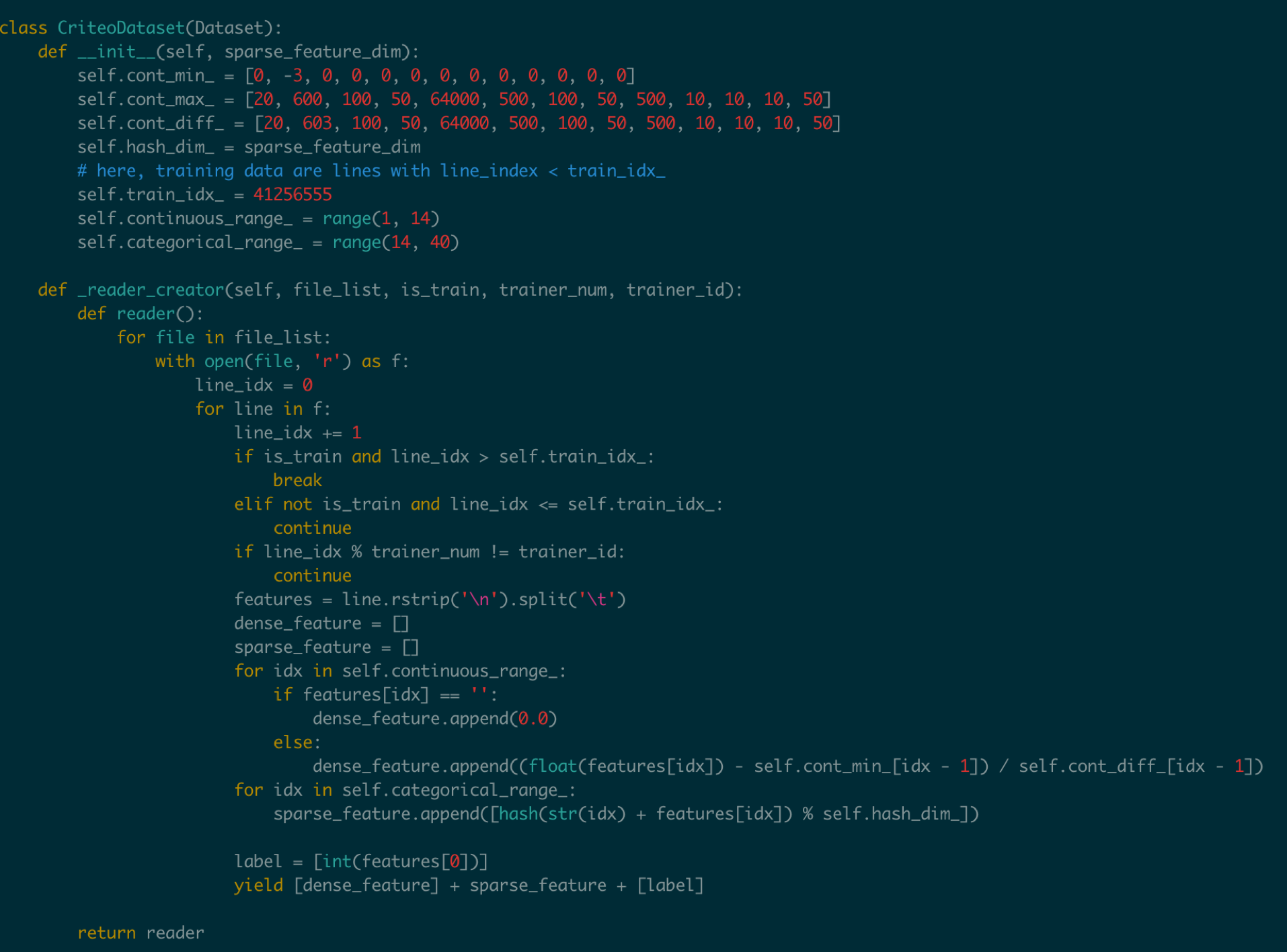

doc/elastic_ctr/pyreader.png

0 → 100644

456.1 KB

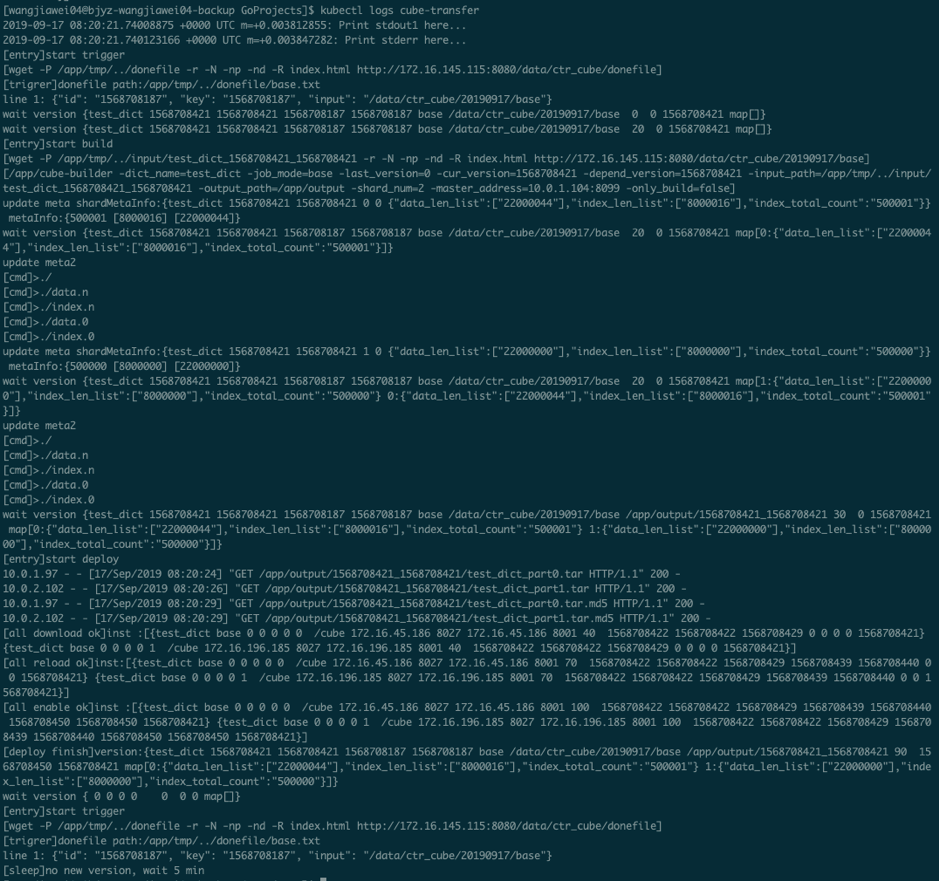

doc/elastic_ctr/transfer.png

0 → 100644

603.7 KB