Merge pull request #5 from PaddlePaddle/master

update from origin

Showing

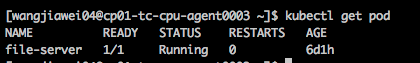

doc/deploy/file_server.png

0 → 100644

13.9 KB

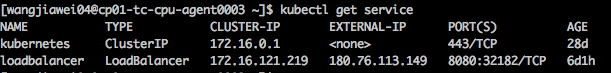

doc/deploy/load_balancer.png

0 → 100644

22.6 KB

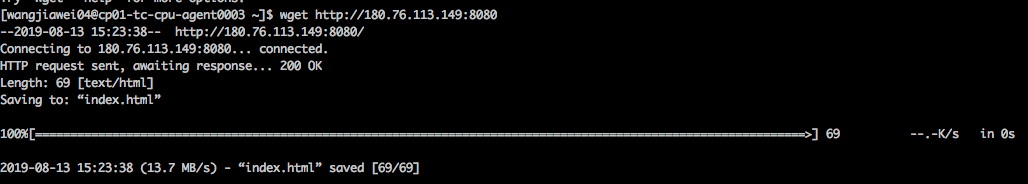

doc/deploy/wget_example.png

0 → 100644

39.3 KB