Merge pull request #2250 from RainFrost1/develop

更新shitu 主页、主体检测、库管理、lite_shitu文档

Showing

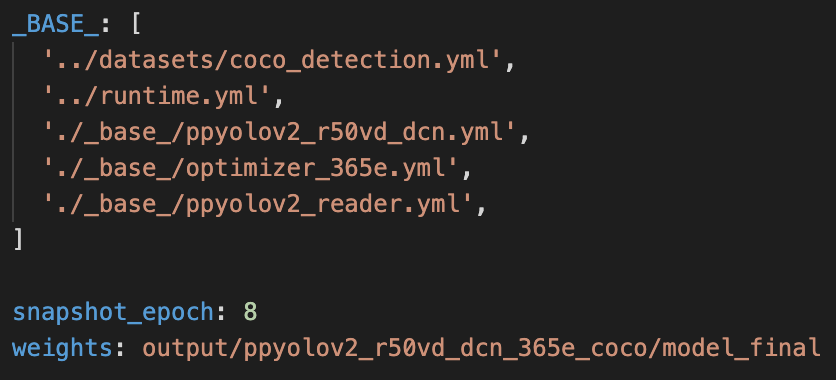

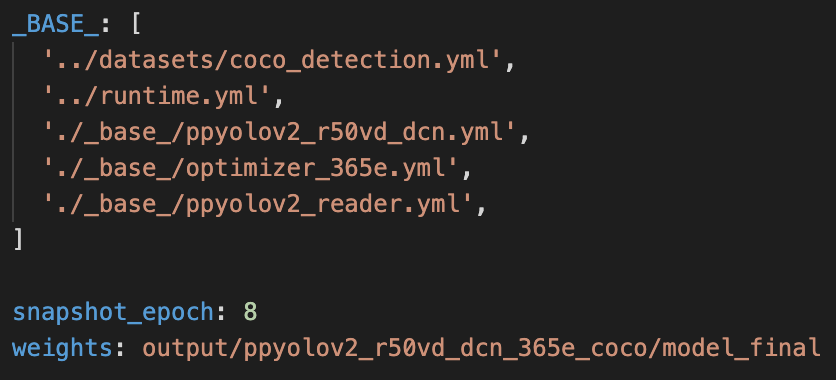

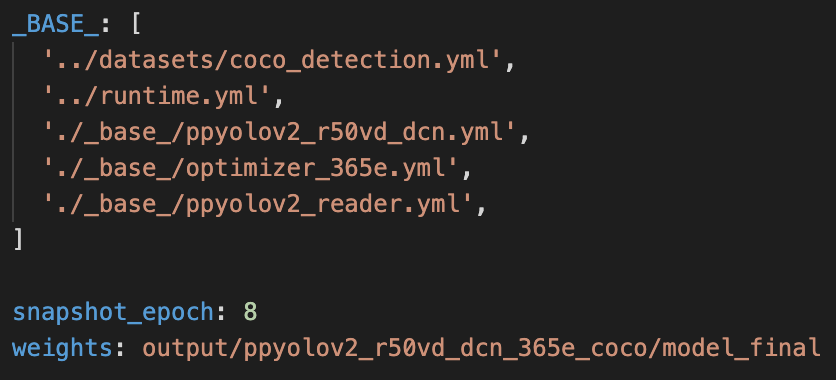

deploy/lite_shitu/README.md

已删除

100644 → 0

deploy/lite_shitu/README.md

0 → 120000

| W: | H:

| W: | H:

文件已移动

111.3 KB

753.8 KB

1.2 MB

767.4 KB

56.2 KB