热启动训练进程不能恢复

Created by: mensaochun

问题:

在使用分布式arcface loss(paddle.fluid.layers.dist_algo._distributed_arcface_classify)训练的时候,出现了热启动不能恢复训练状态的问题。具体细节如下:

环境:

paddle版本:git commit id:0d953806

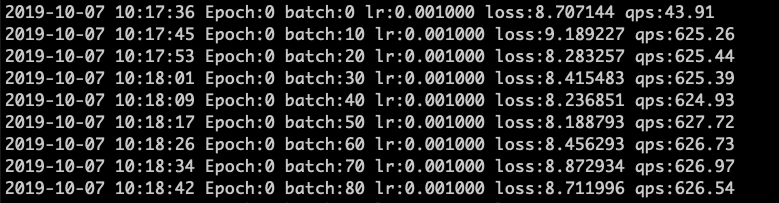

通过fluid.io.save_persistables保存模型之前的loss:

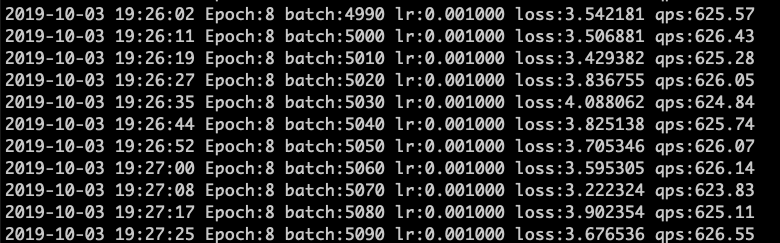

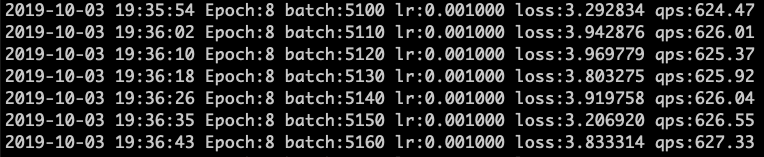

继续运行的loss:

继续运行的loss:

对比可知,重新加载进来之后loss差别很大。

这个问题已经和paddle同学沟通过,他们复现了这个问题,同时,在softmax loss上也复现了这个问题,所以这个可能是一个普遍问题,但他们还没有找到原因。这个问题对目前的训练影响很大,望尽快解决。