Merge pull request #1 from PaddlePaddle/release/1.1

Release/1.1

Showing

.gitignore

已删除

100644 → 0

.travis.yml

0 → 100644

Makefile

已删除

100644 → 0

build/.gitignore

已删除

100644 → 0

doc/about/about_us.rst

0 → 100644

此差异已折叠。

416.1 KB

483.5 KB

247.8 KB

276.6 KB

344.4 KB

189.5 KB

69.0 KB

29.9 KB

44.3 KB

doc/fluid/api/CMakeLists.txt

0 → 100644

doc/fluid/api/average.rst

0 → 100644

doc/fluid/api/backward.rst

0 → 100644

doc/fluid/api/data/dataset.rst

0 → 100644

doc/fluid/api/data/image.rst

0 → 100644

doc/fluid/api/fluid.rst

0 → 100644

此差异已折叠。

doc/fluid/api/gen_doc.py

0 → 100644

此差异已折叠。

doc/fluid/api/gen_index.py

0 → 100644

doc/fluid/api/transpiler.rst

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/design/index_cn.rst

0 → 100644

此差异已折叠。

doc/fluid/design/index_en.rst

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/design/ir/overview.md

0 → 100644

此差异已折叠。

doc/fluid/design/memory/README.md

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/design/modules/prune.md

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/design/others/dcgan.png

0 → 100644

此差异已折叠。

此差异已折叠。

doc/fluid/design/others/graph.md

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/design/others/test.dot

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/dev/api_doc_std_cn.md

0 → 100644

此差异已折叠。

doc/fluid/dev/api_doc_std_en.md

0 → 100644

此差异已折叠。

doc/fluid/dev/ci_build_whl.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/dev/index_cn.rst

0 → 100644

此差异已折叠。

doc/fluid/dev/index_en.rst

0 → 100644

此差异已折叠。

doc/fluid/dev/name_convention.md

0 → 100644

此差异已折叠。

doc/fluid/dev/new_op_cn.md

0 → 100644

此差异已折叠。

doc/fluid/dev/new_op_en.md

0 → 100644

此差异已折叠。

doc/fluid/dev/new_op_kernel.md

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/dev/src/fc.py

0 → 100644

此差异已折叠。

此差异已折叠。

doc/fluid/dev/use_eigen_cn.md

0 → 100644

此差异已折叠。

doc/fluid/dev/use_eigen_en.md

0 → 100644

此差异已折叠。

doc/fluid/dev/versioning_en.md

0 → 100644

此差异已折叠。

doc/fluid/dev/write_docs_cn.md

0 → 120000

此差异已折叠。

doc/fluid/dev/write_docs_cn.rst

0 → 120000

此差异已折叠。

doc/fluid/dev/write_docs_en.rst

0 → 100644

此差异已折叠。

doc/fluid/faq/faq.rst

0 → 100644

此差异已折叠。

doc/fluid/faq/index_cn.rst

0 → 100644

此差异已折叠。

doc/fluid/faq/index_en.rst

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/getstarted/index_cn.rst

0 → 100644

此差异已折叠。

doc/fluid/getstarted/index_en.rst

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/howto/index_cn.rst

0 → 100644

此差异已折叠。

doc/fluid/howto/index_en.rst

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/images/1.png

0 → 100644

此差异已折叠。

doc/fluid/images/2.png

0 → 100644

此差异已折叠。

doc/fluid/images/2_level_rnn.dot

0 → 100644

此差异已折叠。

doc/fluid/images/2_level_rnn.png

0 → 100644

此差异已折叠。

doc/fluid/images/3.png

0 → 100644

此差异已折叠。

doc/fluid/images/4.png

0 → 100644

此差异已折叠。

此差异已折叠。

doc/fluid/images/LoDTensor.png

0 → 100644

此差异已折叠。

doc/fluid/images/asgd.gif

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/images/beam_search.png

0 → 100644

此差异已折叠。

doc/fluid/images/ci_build_whl.png

0 → 100644

此差异已折叠。

此差异已折叠。

doc/fluid/images/compiler.graffle

0 → 100644

此差异已折叠。

doc/fluid/images/compiler.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/images/dcgan.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/images/dist-graph.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/images/ds2_network.png

0 → 100644

此差异已折叠。

doc/fluid/images/executor.png

0 → 100644

此差异已折叠。

doc/fluid/images/feed_forward.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/images/layer.png

0 → 100644

此差异已折叠。

此差异已折叠。

doc/fluid/images/local-graph.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/images/lookup_table.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/images/op.dot

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/images/operator1.png

0 → 100644

此差异已折叠。

doc/fluid/images/operator2.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/images/place.png

0 → 100644

此差异已折叠。

doc/fluid/images/pprof_1.png

0 → 100644

此差异已折叠。

doc/fluid/images/pprof_2.png

0 → 100644

此差异已折叠。

此差异已折叠。

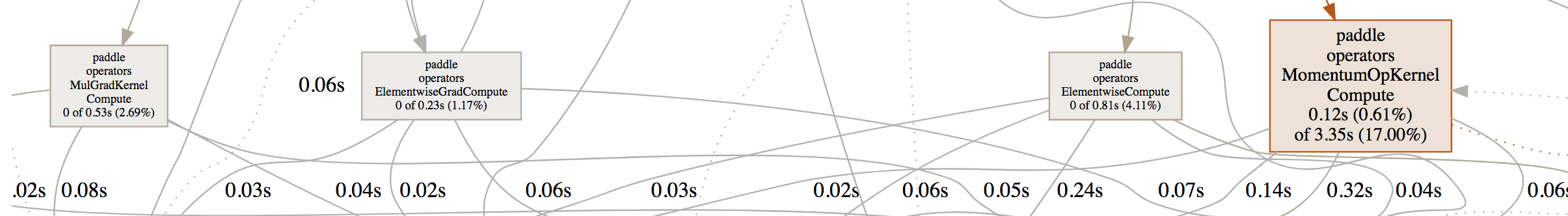

doc/fluid/images/profiler.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/images/raw_input.png

0 → 100644

此差异已折叠。

doc/fluid/images/readers.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/images/rnn.dot

0 → 100644

此差异已折叠。

doc/fluid/images/rnn.jpg

0 → 100644

此差异已折叠。

doc/fluid/images/rnn.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/images/sorted_input.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/images/test.dot

0 → 100644

此差异已折叠。

doc/fluid/images/test.dot.png

0 → 100644

此差异已折叠。

doc/fluid/images/theta_star.gif

0 → 100644

此差异已折叠。

doc/fluid/images/timeline.jpeg

0 → 100644

此差异已折叠。

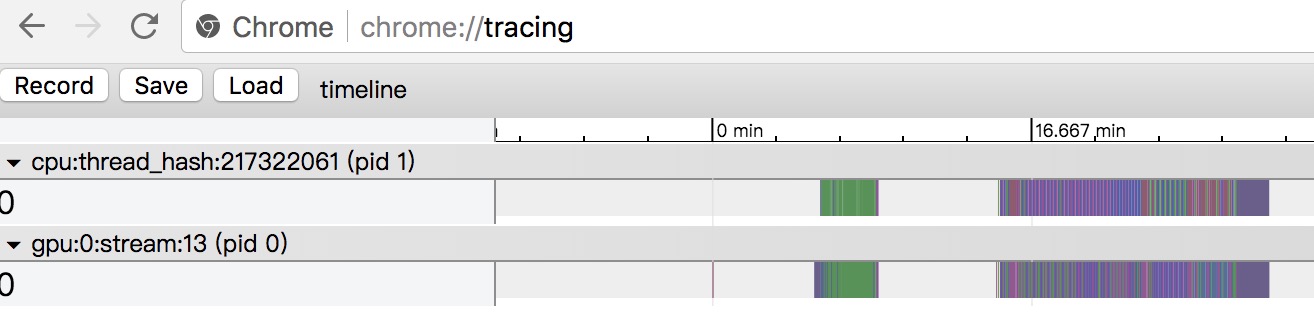

doc/fluid/images/tracing.jpeg

0 → 100644

此差异已折叠。

doc/fluid/images/transpiler.png

0 → 100644

此差异已折叠。

此差异已折叠。

doc/fluid/index_en.rst

0 → 100644

此差异已折叠。

doc/fluid/overview.md

0 → 100644

此差异已折叠。

doc/fluid/read_source.md

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/fluid/user_guides/index.rst

0 → 100644

此差异已折叠。

此差异已折叠。

doc/mobile/CMakeLists.txt

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/mobile/index_cn.rst

0 → 100644

此差异已折叠。

doc/mobile/index_en.rst

0 → 100644

此差异已折叠。

此差异已折叠。

doc/survey/dynamic_graph.md

0 → 100644

此差异已折叠。

doc/survey/op_fusion_design.md

0 → 100644

此差异已折叠。

doc/templates/conf.py.en.in

0 → 100644

此差异已折叠。

doc/templates/layout.html

0 → 100644

此差异已折叠。

doc/v2/CMakeLists.txt

0 → 100644

此差异已折叠。

doc/v2/api/CMakeLists.txt

0 → 100644

此差异已折叠。

doc/v2/api/config/activation.rst

0 → 100644

此差异已折叠。

doc/v2/api/config/attr.rst

0 → 100644

此差异已折叠。

doc/v2/api/config/evaluators.rst

0 → 100644

此差异已折叠。

doc/v2/api/config/layer.rst

0 → 100644

此差异已折叠。

doc/v2/api/config/networks.rst

0 → 100644

此差异已折叠。

doc/v2/api/config/optimizer.rst

0 → 100644

此差异已折叠。

doc/v2/api/config/pooling.rst

0 → 100644

此差异已折叠。

doc/v2/api/data.rst

0 → 100644

此差异已折叠。

doc/v2/api/data/data_reader.rst

0 → 100644

此差异已折叠。

doc/v2/api/data/dataset.rst

0 → 100644

此差异已折叠。

doc/v2/api/data/image.rst

0 → 100644

此差异已折叠。

doc/v2/api/index_en.rst

0 → 100644

此差异已折叠。

doc/v2/api/model_configs.rst

0 → 100644

此差异已折叠。

doc/v2/api/overview.rst

0 → 100644

此差异已折叠。

doc/v2/api/run_logic.rst

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/design/mkl/mkl_packed.md

0 → 100644

此差异已折叠。

doc/v2/design/mkl/mkldnn.md

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/dev/index_cn.rst

0 → 100644

此差异已折叠。

doc/v2/dev/index_en.rst

0 → 100644

此差异已折叠。

doc/v2/dev/new_layer_cn.rst

0 → 100644

此差异已折叠。

doc/v2/dev/new_layer_en.rst

0 → 100644

此差异已折叠。

doc/v2/dev/src/FullyConnected.jpg

0 → 100644

此差异已折叠。

doc/v2/dev/src/doc_en.png

0 → 100644

此差异已折叠。

doc/v2/dev/write_docs_cn.md

0 → 100755

此差异已折叠。

doc/v2/dev/write_docs_cn.rst

0 → 100644

此差异已折叠。

doc/v2/dev/write_docs_en.rst

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/faq/cluster/index_cn.rst

0 → 100644

此差异已折叠。

doc/v2/faq/cluster/index_en.rst

0 → 100644

此差异已折叠。

doc/v2/faq/index_cn.rst

0 → 100644

此差异已折叠。

doc/v2/faq/index_en.rst

0 → 100644

此差异已折叠。

doc/v2/faq/local/index_cn.rst

0 → 100644

此差异已折叠。

doc/v2/faq/local/index_en.rst

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/faq/model/index_cn.rst

0 → 100644

此差异已折叠。

doc/v2/faq/model/index_en.rst

0 → 100644

此差异已折叠。

doc/v2/faq/parameter/index_cn.rst

0 → 100644

此差异已折叠。

doc/v2/faq/parameter/index_en.rst

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/getstarted/index_cn.rst

0 → 100644

此差异已折叠。

doc/v2/getstarted/index_en.rst

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/howto/capi/images/csr.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/howto/capi/index_cn.rst

0 → 100644

此差异已折叠。

doc/v2/howto/capi/index_en.rst

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/howto/cluster/index_cn.rst

0 → 100644

此差异已折叠。

doc/v2/howto/cluster/index_en.rst

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/howto/index_cn.rst

0 → 100644

此差异已折叠。

doc/v2/howto/index_en.rst

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/howto/rnn/index_cn.rst

0 → 100644

此差异已折叠。

doc/v2/howto/rnn/index_en.rst

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/howto/rnn/src/bi_lstm.jpg

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/images/FullyConnected.jpg

0 → 100644

此差异已折叠。

此差异已折叠。

doc/v2/images/bi_lstm.jpg

0 → 100644

此差异已折叠。

doc/v2/images/checkpointing.png

0 → 100644

此差异已折叠。

doc/v2/images/create_efs.png

0 → 100644

此差异已折叠。

doc/v2/images/csr.png

0 → 100644

此差异已折叠。

doc/v2/images/data_dispatch.png

0 → 100644

此差异已折叠。

doc/v2/images/dataset.graffle

0 → 100644

此差异已折叠。

doc/v2/images/dataset.png

0 → 100644

此差异已折叠。

doc/v2/images/doc_en.png

0 → 100644

此差异已折叠。

doc/v2/images/efs_mount.png

0 → 100644

此差异已折叠。

此差异已折叠。

doc/v2/images/engine.png

0 → 100644

此差异已折叠。

此差异已折叠。

doc/v2/images/file_storage.png

0 → 100644

此差异已折叠。

doc/v2/images/glossary_rnn.dot

0 → 100644

此差异已折叠。

此差异已折叠。

doc/v2/images/gradients.png

0 → 100644

此差异已折叠。

doc/v2/images/init_lock.graffle

0 → 100644

此差异已折叠。

doc/v2/images/init_lock.png

0 → 100644

此差异已折叠。

doc/v2/images/k8s-paddle-arch.png

0 → 100644

此差异已折叠。

doc/v2/images/layers.png

0 → 100644

此差异已折叠。

doc/v2/images/managed_policy.png

0 → 100644

此差异已折叠。

doc/v2/images/matrix.png

0 → 100644

此差异已折叠。

doc/v2/images/nvvp1.png

0 → 100644

此差异已折叠。

doc/v2/images/nvvp2.png

0 → 100644

此差异已折叠。

doc/v2/images/nvvp3.png

0 → 100644

此差异已折叠。

doc/v2/images/nvvp4.png

0 → 100644

此差异已折叠。

doc/v2/images/overview.png

0 → 100644

此差异已折叠。

此差异已折叠。

doc/v2/images/paddle-etcd.graffle

0 → 100644

此差异已折叠。

doc/v2/images/paddle-etcd.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/images/paddle-ps-0.png

0 → 100644

此差异已折叠。

doc/v2/images/paddle-ps-1.png

0 → 100644

此差异已折叠。

doc/v2/images/paddle-ps.graffle

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/images/ps_cn.png

0 → 100644

此差异已折叠。

doc/v2/images/ps_en.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/images/pserver_init.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/images/sequence_data.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/images/submit-job.graffle

0 → 100644

此差异已折叠。

doc/v2/images/submit-job.png

0 → 100644

此差异已折叠。

doc/v2/images/trainer.graffle

0 → 100644

此差异已折叠。

doc/v2/images/trainer.png

0 → 100644

此差异已折叠。

doc/v2/images/trainer_cn.png

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

doc/v2/index_cn.rst

0 → 100644

此差异已折叠。

doc/v2/index_en.rst

0 → 100644

此差异已折叠。

此差异已折叠。

此差异已折叠。

requirements.txt

已删除

100644 → 0

此差异已折叠。

scripts/deploy_docs.sh

0 → 100755

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

source/api_guides/index.rst

已删除

100644 → 0

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

source/api_reference/data

已删除

120000 → 0

此差异已折叠。

此差异已折叠。

source/faq.rst

已删除

100644 → 0

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

source/quick_start/index.rst

已删除

100644 → 0

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

此差异已折叠。

source/user_guides/index.rst

已删除

100644 → 0

此差异已折叠。

此差异已折叠。