[add] 添加prometheus文章

Showing

docs/52.Prometheus基本使用.md

0 → 100644

94.6 KB

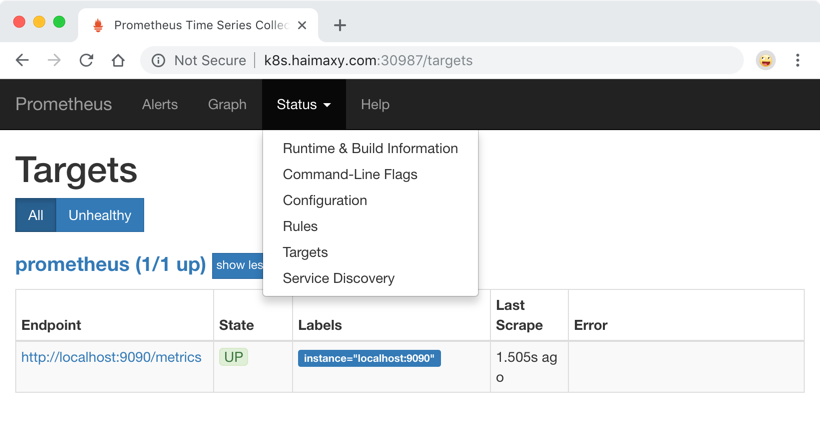

docs/images/prometheus-menu.png

0 → 100644

94.3 KB

89.5 KB

251.9 KB

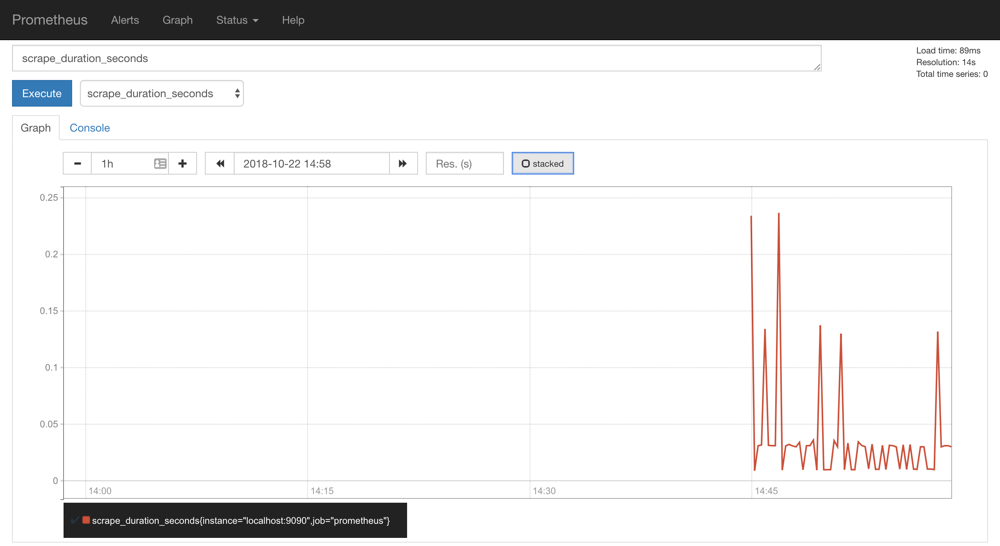

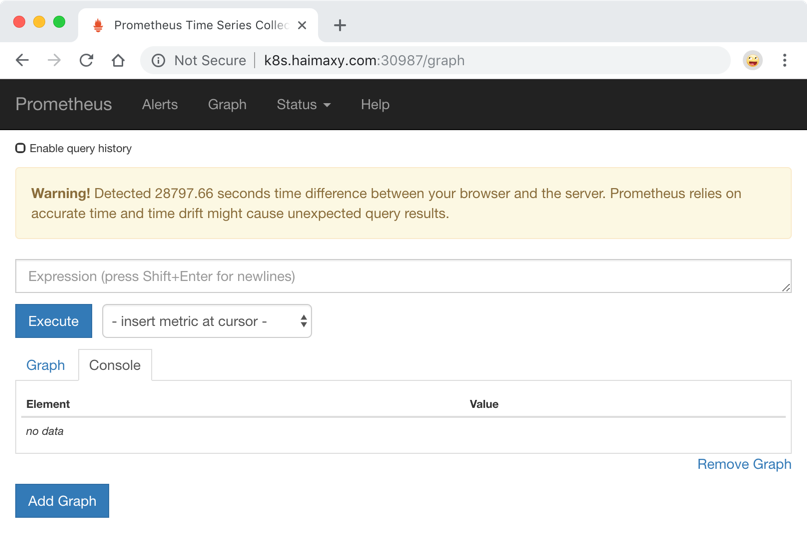

docs/images/prometheus-webui.png

0 → 100644

100.1 KB

grafana/grafana-deploy.yaml

0 → 100644

grafana/grafana-svc.yaml

0 → 100644

package-lock.json

0 → 100644

此差异已折叠。

prometheus/node-exporter.yaml

0 → 100644

prometheus/prometheus-cm.yaml

0 → 100644

prometheus/prometheus-deploy.yaml

0 → 100644

prometheus/prometheus-pv.yaml

0 → 100644

prometheus/prometheus-rbac.yaml

0 → 100644

prometheus/prometheus-svc.yaml

0 → 100644