add 9.3

Showing

此差异已折叠。

img/catdog.jpg

0 → 100644

31.8 KB

img/chapter09/9.3_output1.png

0 → 100644

183.8 KB

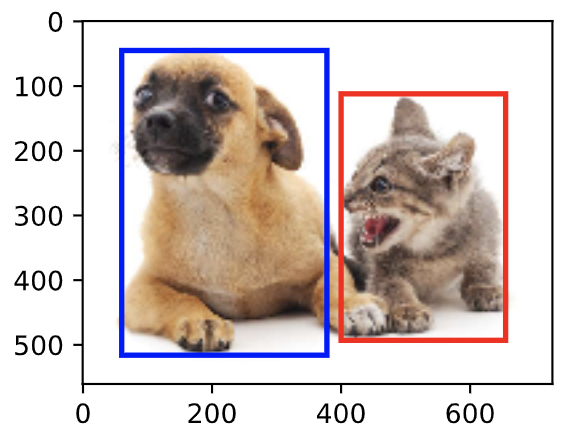

img/chapter09/9.3_output2.png

0 → 100644

180.1 KB

31.8 KB

183.8 KB

180.1 KB