基于 ChatGLM 等大语言模型与 Langchain 等应用框架实现,开源、可离线部署的检索增强生成(RAG)大模型知识库项目。

⚠ ️ 重要提示

0.2.10将会是0.2.x系列的最后一个版本,0.2.x系列版本将会停止更新和技术支持,全力研发具有更强应用性的 Langchain-Chatchat 0.3.x。

0.2.10 的后续 bug 修复将会直接推送到master分支,而不再进行版本更新。

目录

介绍

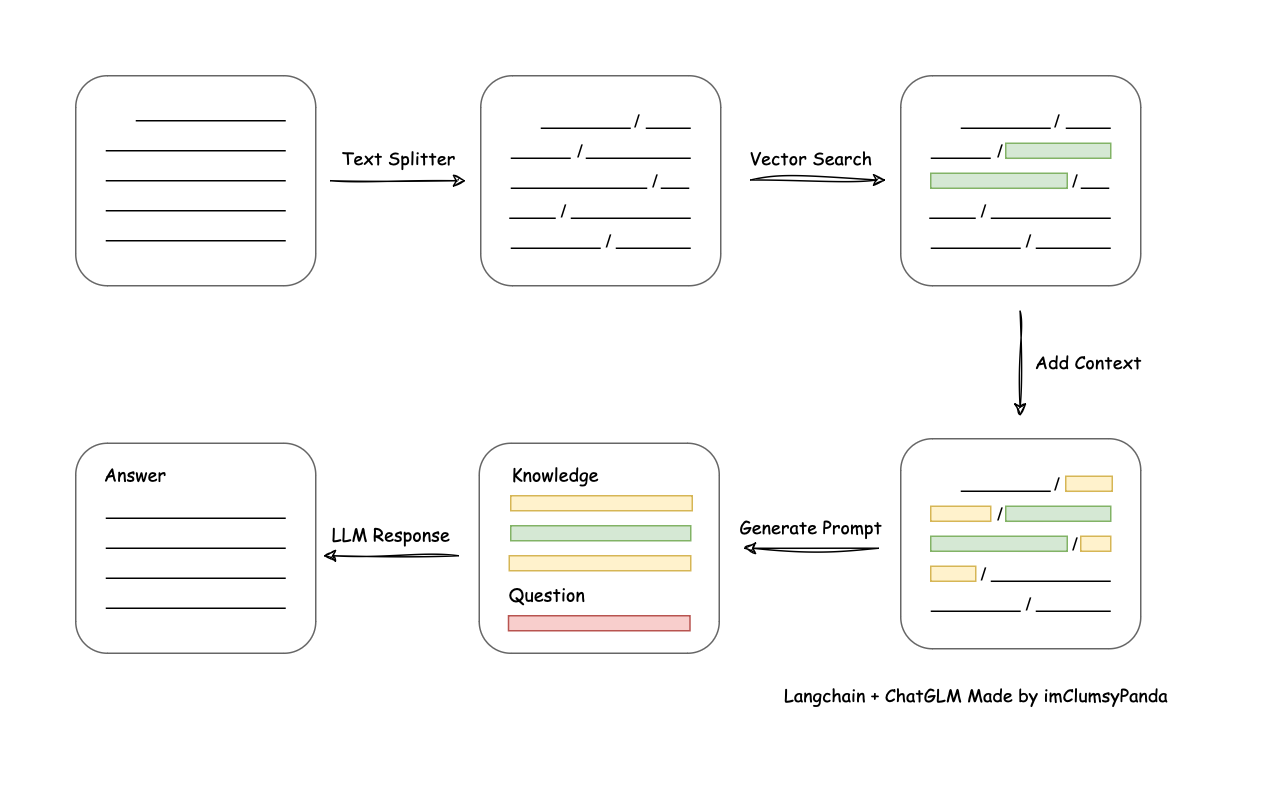

top k个 -> 匹配出的文本作为上下文和问题一起添加到 prompt中 -> 提交给 LLM生成回答。

从文档处理角度来看,实现流程如下:

0.2.10

版本所使用代码已更新至本项目 v0.2.10 版本。

0.2.10 版本。

docker run -d --gpus all -p 80:8501 isafetech/chatchat:0.2.10

docker run -d --gpus all -p 80:8501 uswccr.ccs.tencentyun.com/chatchat/chatchat:0.2.10

docker run -d --gpus all -p 80:8501 registry.cn-beijing.aliyuncs.com/chatchat/chatchat:0.2.10🧩 本项目有一个非常完整的Wiki , README只是一个简单的介绍,_ 仅仅是入门教程,能够基础运行_。 如果你想要更深入的了解本项目,或者想对本项目做出贡献。请移步 Wiki 界面

解决的痛点

该项目是一个可以实现 __完全本地化__推理的知识库增强方案, 重点解决数据安全保护,私域化部署的企业痛点。

本开源方案采用Apache License,可以免费商用,无需付费。

我们支持市面上主流的本地大语言模型和Embedding模型,支持开源的本地向量数据库。 支持列表详见Wiki

快速上手

1. 环境配置

- 首先,确保你的机器安装了 Python 3.8 - 3.11 (我们强烈推荐使用 Python3.11)。

$ python --version

Python 3.11.7接着,创建一个虚拟环境,并在虚拟环境内安装项目的依赖

# 拉取仓库

$ git clone https://github.com/chatchat-space/Langchain-Chatchat.git

# 进入目录

$ cd Langchain-Chatchat

# 安装全部依赖

$ pip install -r requirements.txt

$ pip install -r requirements_api.txt

$ pip install -r requirements_webui.txt

# 默认依赖包括基本运行环境(FAISS向量库)。如果要使用 milvus/pg_vector 等向量库,请将 requirements.txt 中相应依赖取消注释再安装。请注意,LangChain-Chatchat 0.2.x 系列是针对 Langchain 0.0.x 系列版本的,如果你使用的是 Langchain 0.1.x

系列版本,需要降级您的Langchain版本。

2. 模型下载

如需在本地或离线环境下运行本项目,需要首先将项目所需的模型下载至本地,通常开源 LLM 与 Embedding 模型可以从 HuggingFace 下载。

以本项目中默认使用的 LLM 模型 THUDM/ChatGLM3-6B 与 Embedding 模型 BAAI/bge-large-zh 为例:

下载模型需要先安装 Git LFS ,然后运行

$ git lfs install

$ git clone https://huggingface.co/THUDM/chatglm3-6b

$ git clone https://huggingface.co/BAAI/bge-large-zh3. 初始化知识库和配置文件

按照下列方式初始化自己的知识库和简单的复制配置文件

$ python copy_config_example.py

$ python init_database.py --recreate-vs4. 一键启动

按照以下命令启动项目

$ python startup.py -a5. 启动界面示例

如果正常启动,你将能看到以下界面

- FastAPI Docs 界面

- Web UI 启动界面示例:

- Web UI 对话界面:

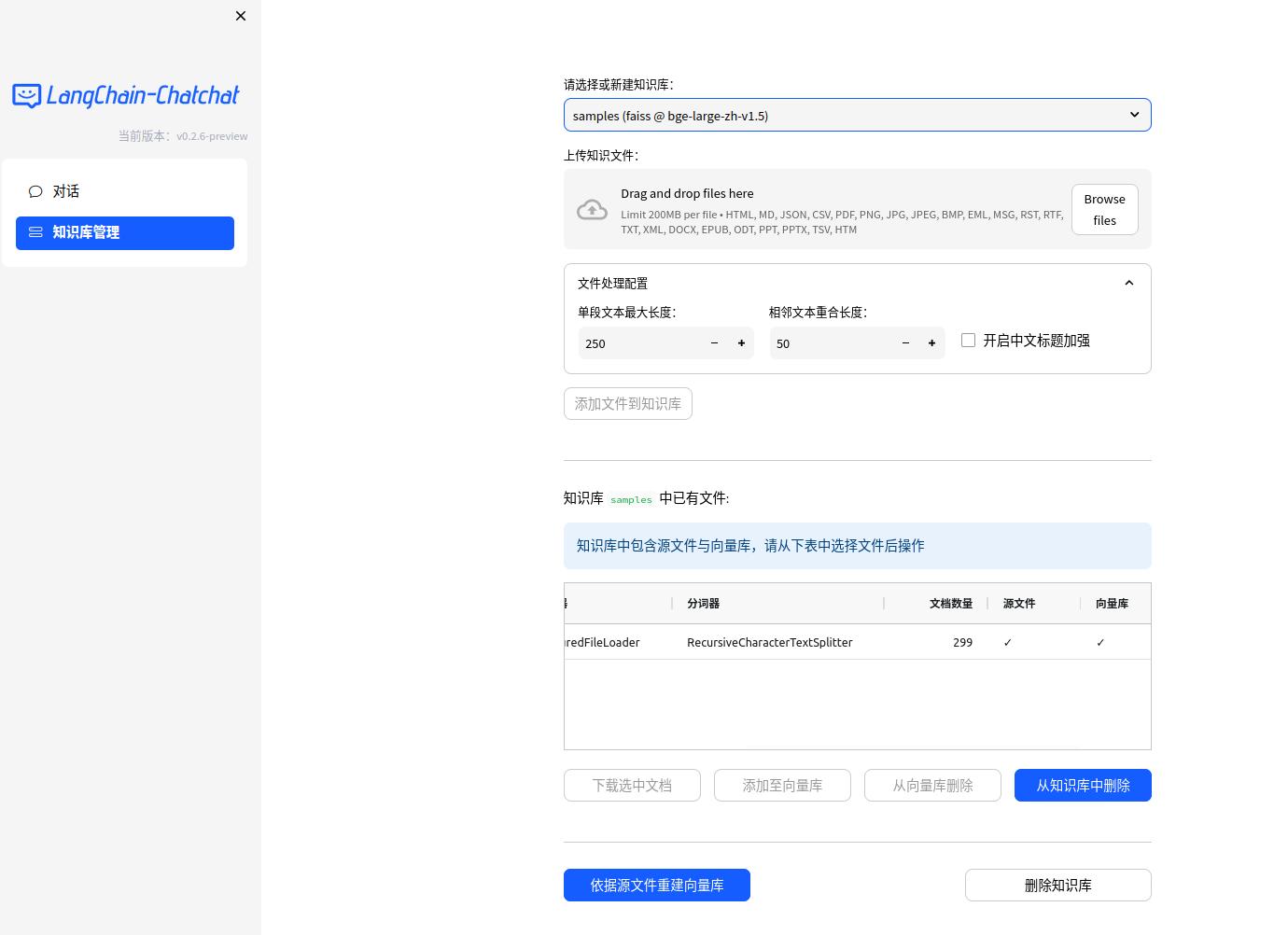

- Web UI 知识库管理页面:

注意

以上方式只是为了快速上手,如果需要更多的功能和自定义启动方式 ,请参考Wiki

项目里程碑

-

2023年4月:Langchain-ChatGLM 0.1.0发布,支持基于 ChatGLM-6B 模型的本地知识库问答。 -

2023年8月:Langchain-ChatGLM改名为Langchain-Chatchat,0.2.0发布,使用fastchat作为模型加载方案,支持更多的模型和数据库。 -

2023年10月:Langchain-Chatchat 0.2.5发布,推出 Agent 内容,开源项目在Founder Park & Zhipu AI & Zilliz举办的黑客马拉松获得三等奖。 -

2023年12月:Langchain-Chatchat开源项目获得超过 20K stars. -

2024年1月:LangChain 0.1.x推出,Langchain-Chatchat 0.2.x发布稳定版本0.2.10后将停止更新和技术支持,全力研发具有更强应用性的Langchain-Chatchat 0.3.x。 -

🔥 让我们一起期待未来 Chatchat 的故事 ···

联系我们

Telegram

项目交流群

公众号