ready 1.5 (#290)

* Update README.md Polish README Co-authored-by: NZeyu Chen <chenzeyu01@baidu.com> Co-authored-by: NSteffy-zxf <48793257+Steffy-zxf@users.noreply.github.com>

Showing

demo/elmo/README.md

已删除

100644 → 0

demo/elmo/elmo_finetune.py

已删除

100644 → 0

demo/elmo/predict.py

已删除

100644 → 0

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

demo/lac/cli_demo.sh

已删除

100644 → 0

demo/lac/test/test.txt

已删除

100644 → 0

demo/lac/test/test.yml

已删除

100644 → 0

文件已移动

demo/senta/cli_demo.sh

已删除

100644 → 0

demo/ssd/cli_demo.sh

已删除

100644 → 0

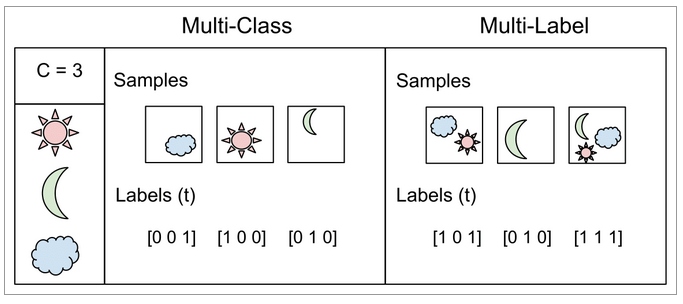

docs/imgs/multi-label-cls.png

0 → 100644

53.7 KB