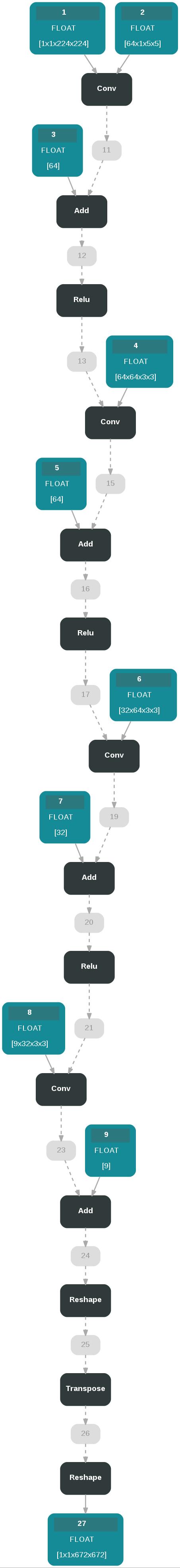

Mxnet grpah (#142)

* mxnet graph * long graph * added full graph * add gif back * updated gif * fix comments * remove python highlight for one line

Showing

demo/mxnet/mxnet_graph.gif

0 → 100644

715.0 KB

89.3 KB

* mxnet graph * long graph * added full graph * add gif back * updated gif * fix comments * remove python highlight for one line

715.0 KB

89.3 KB