Merge pull request #4377 from MissPenguin/dygraph

update doc

Showing

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

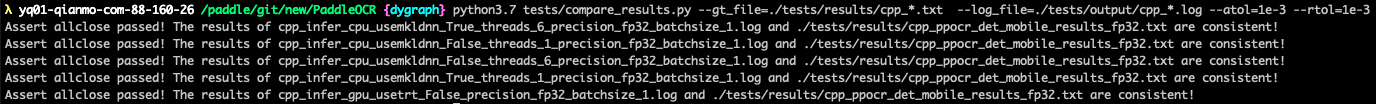

PTDN/docs/compare_cpp_right.png

0 → 100644

49.4 KB

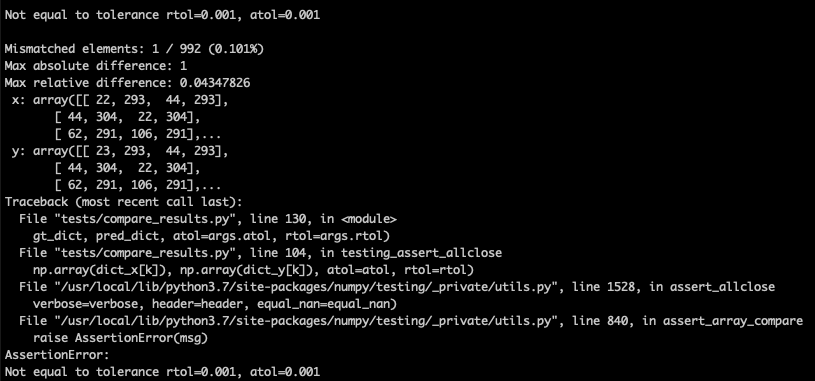

PTDN/docs/compare_cpp_wrong.png

0 → 100644

63.3 KB

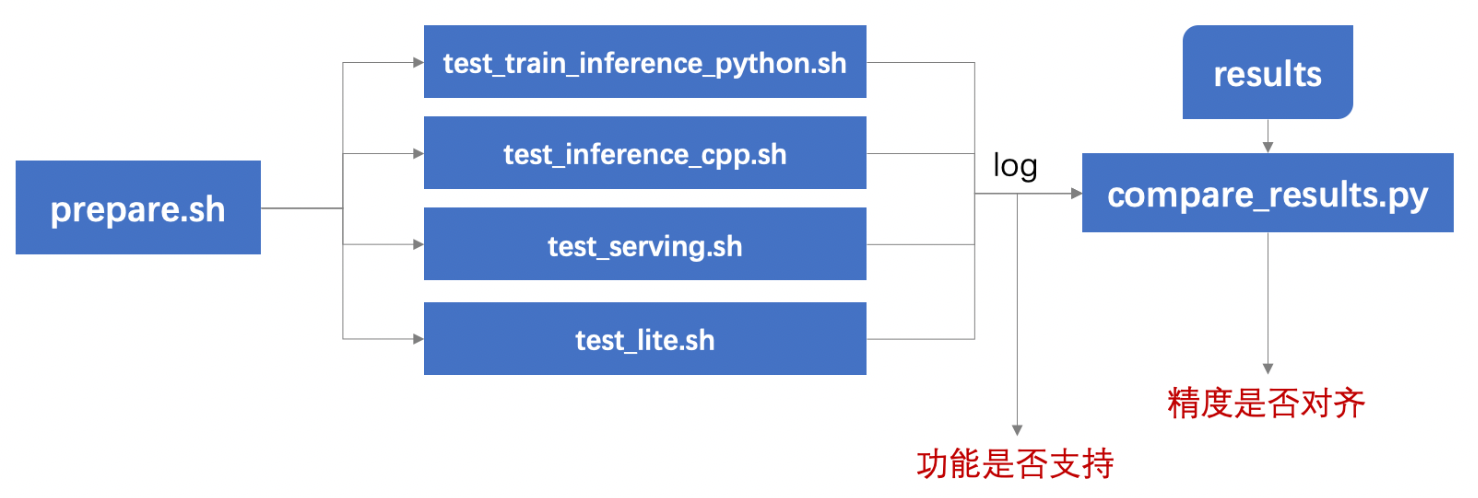

PTDN/docs/test.png

0 → 100644

223.8 KB

文件已移动

文件已移动

文件已移动

文件已移动

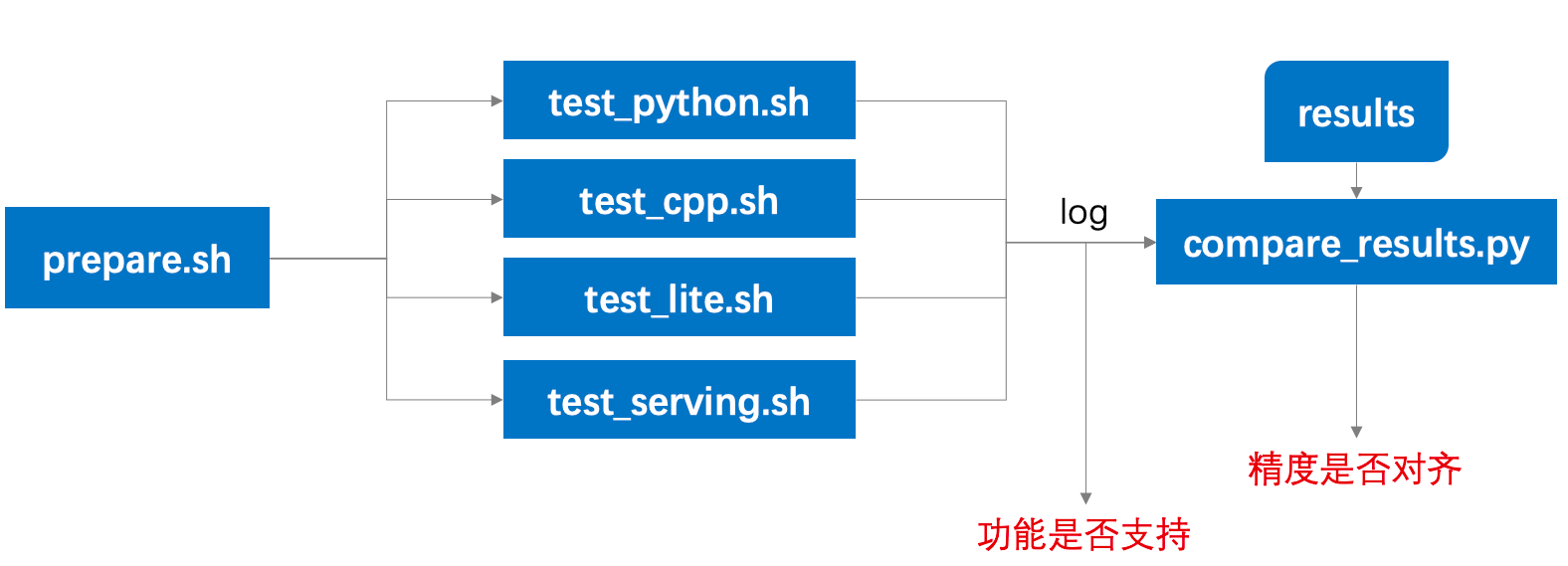

tests/docs/test.png

已删除

100644 → 0

71.8 KB