Merge pull request #1057 from luotao1/doc

add translated chinese docs into catalog

Showing

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

| W: | H:

| W: | H:

| W: | H:

| W: | H:

Fork自 PaddlePaddle / Paddle

add translated chinese docs into catalog

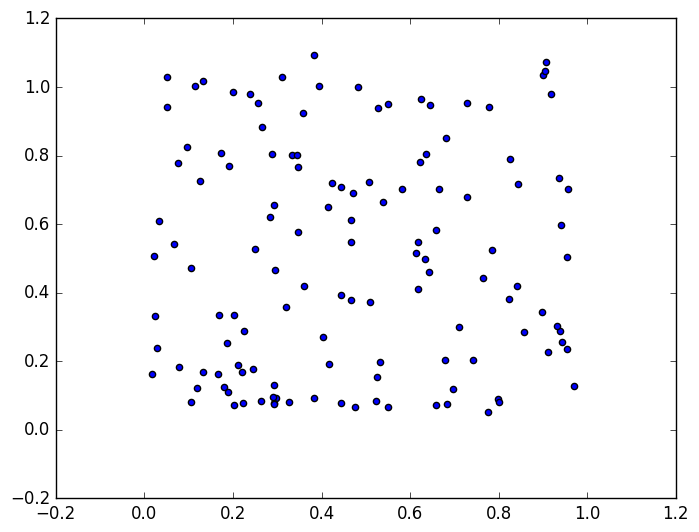

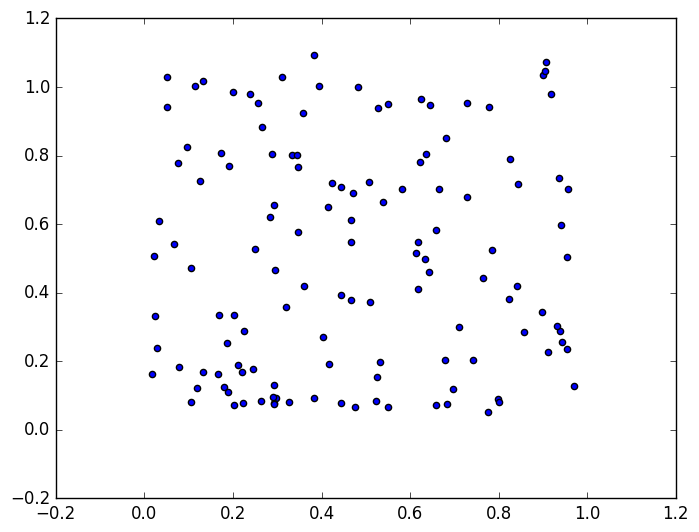

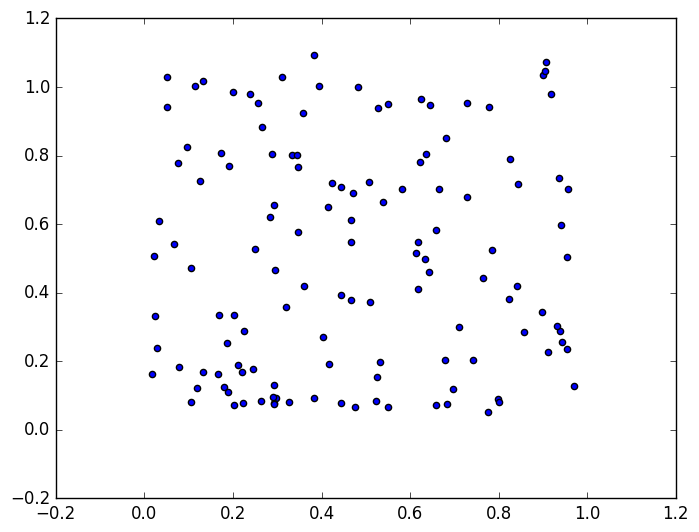

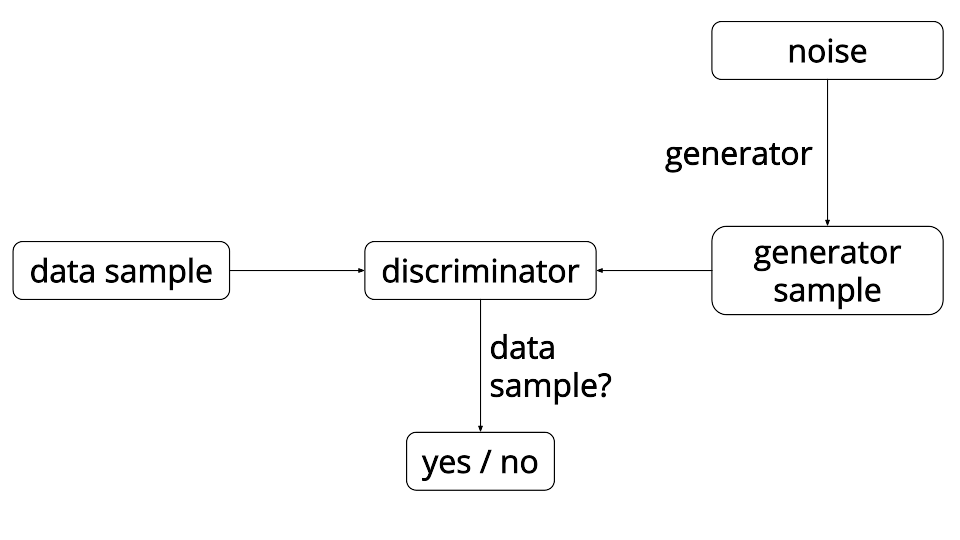

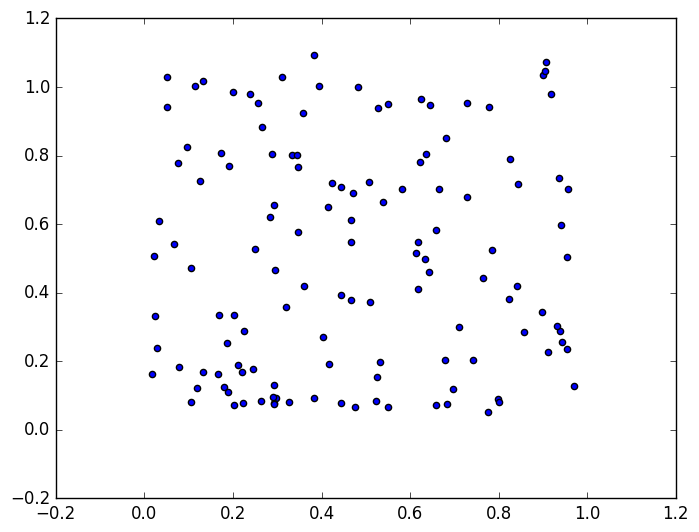

32.5 KB | W: | H:

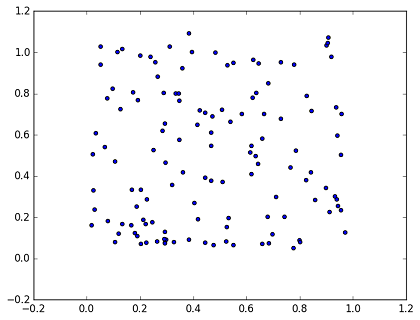

17.4 KB | W: | H:

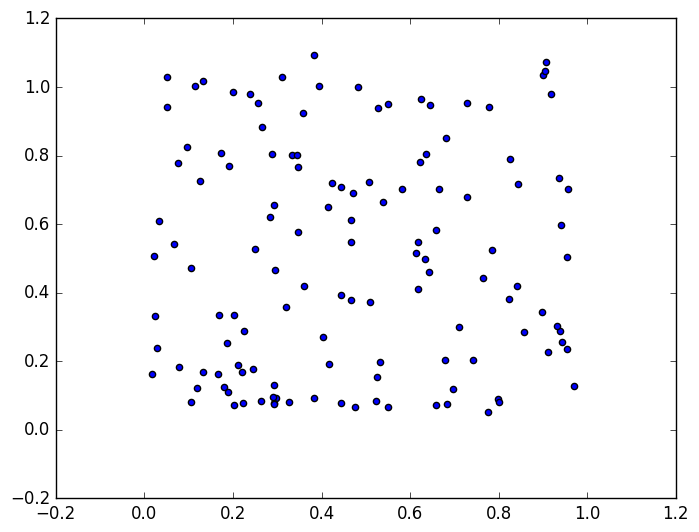

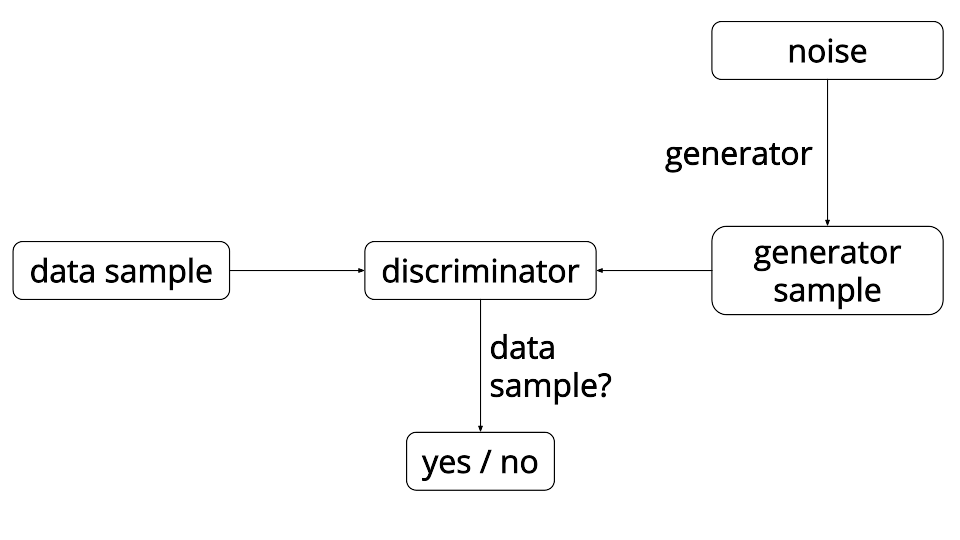

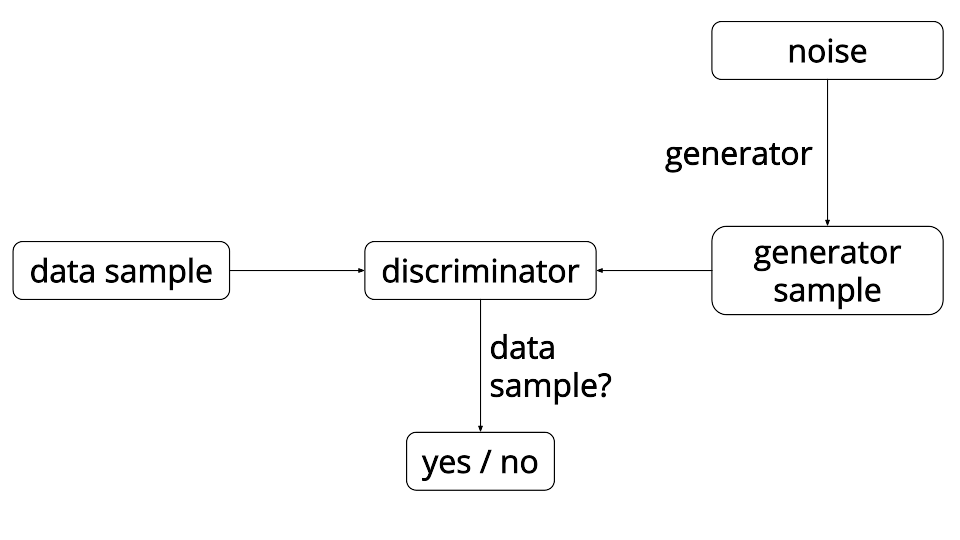

20.1 KB | W: | H:

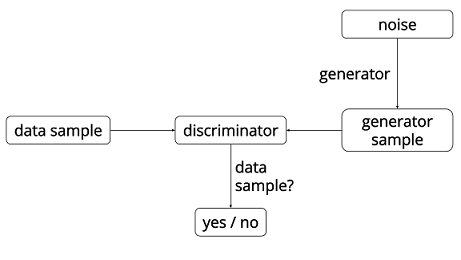

24.3 KB | W: | H: