新增tipc lite_arm_cpp文档 (#5378)

* 新增lite_arm_cpp测试文档 * add Lite_arm_cpp测测试开发规范.md * update Lite_arm docs

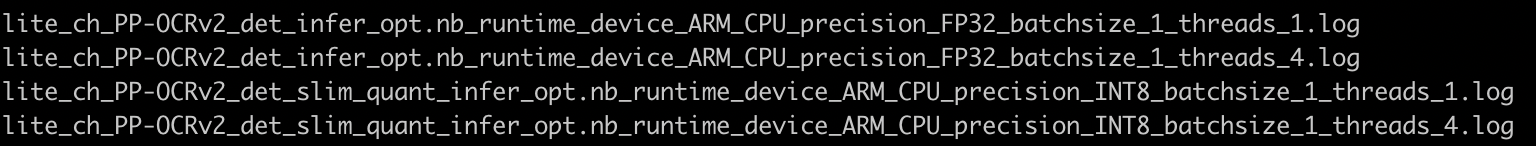

Showing

189.3 KB

203.2 KB

209.8 KB

960.3 KB

209.8 KB

168.7 KB

* 新增lite_arm_cpp测试文档 * add Lite_arm_cpp测测试开发规范.md * update Lite_arm docs

189.3 KB

203.2 KB

209.8 KB

960.3 KB

209.8 KB

168.7 KB