add tables

Showing

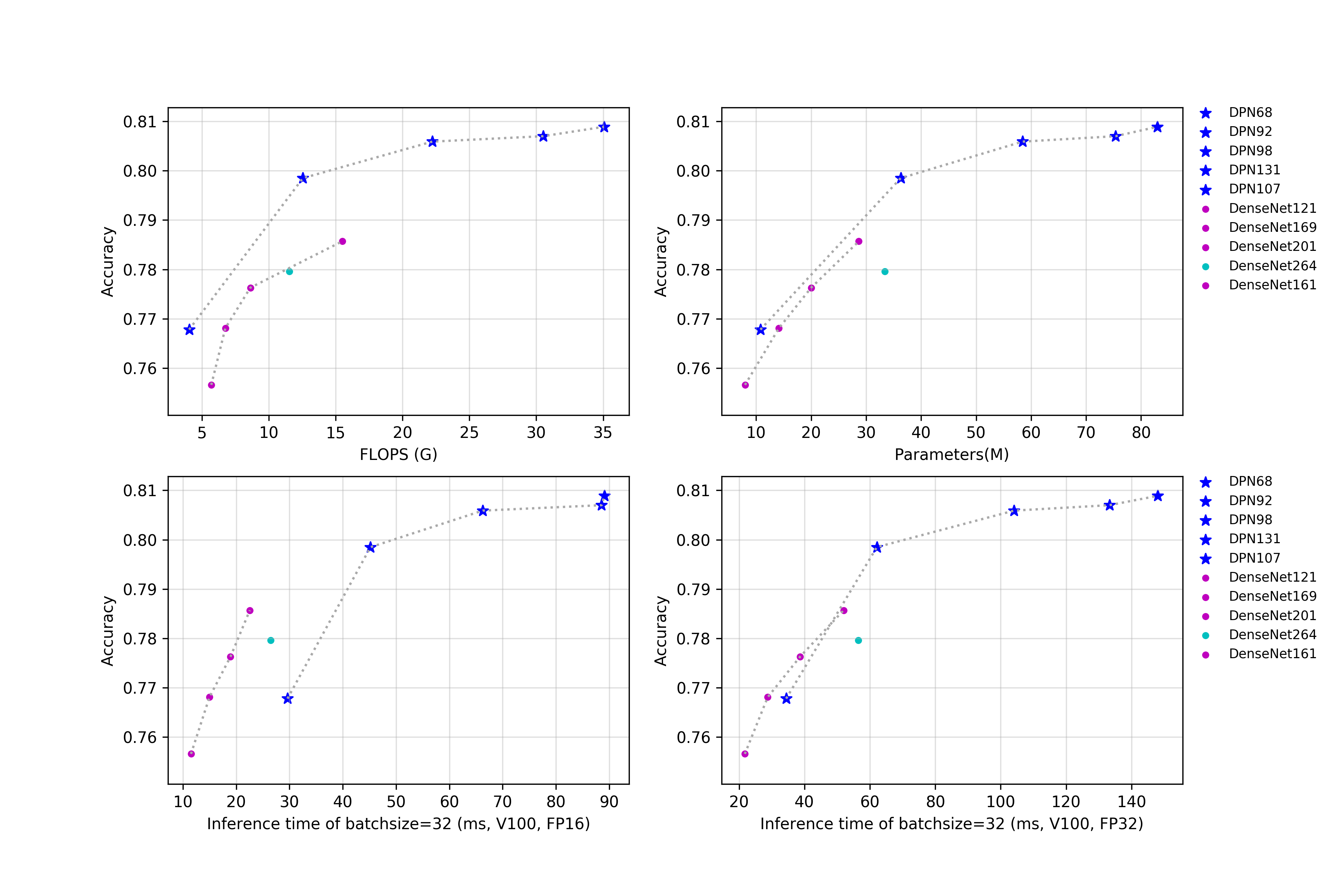

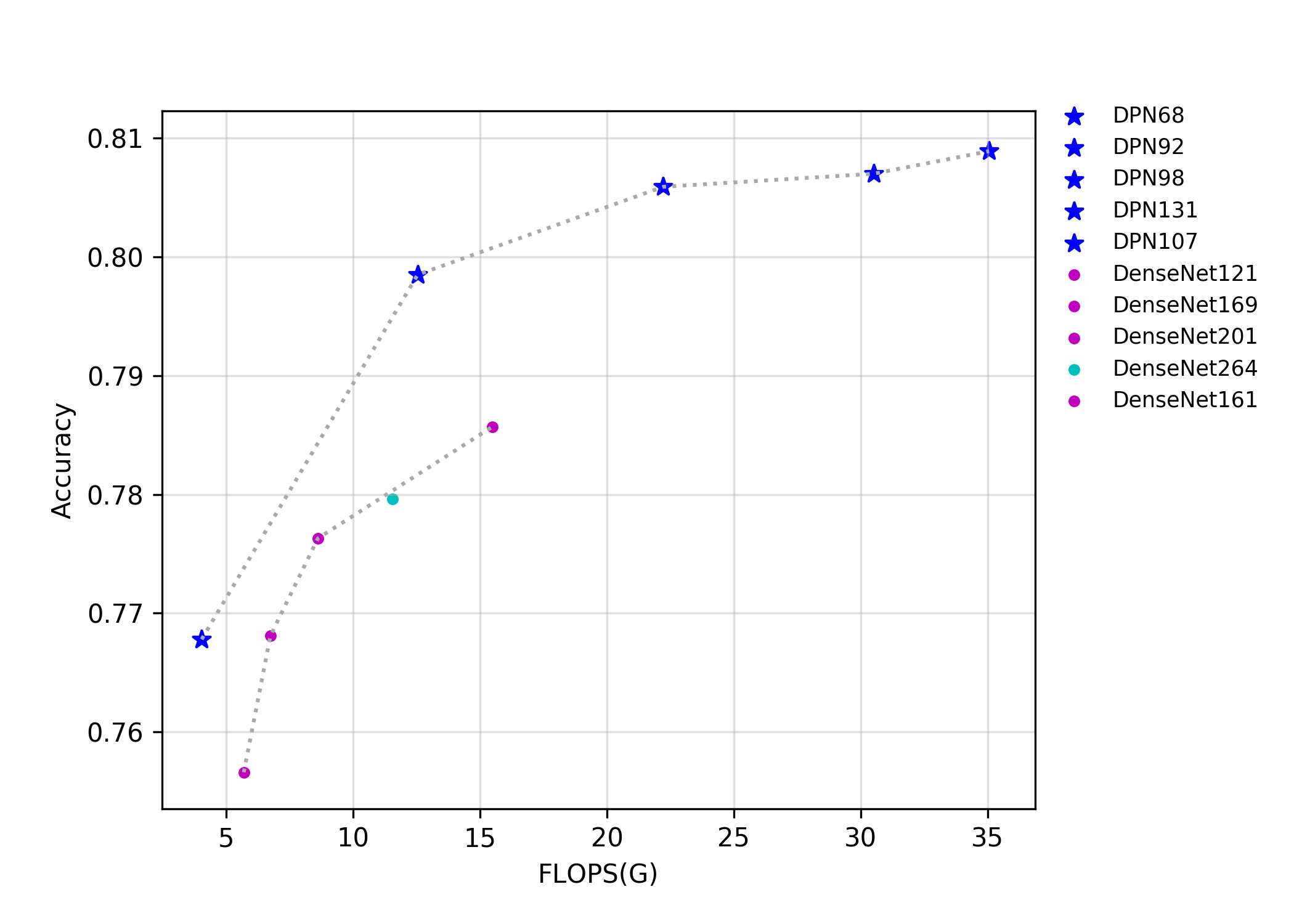

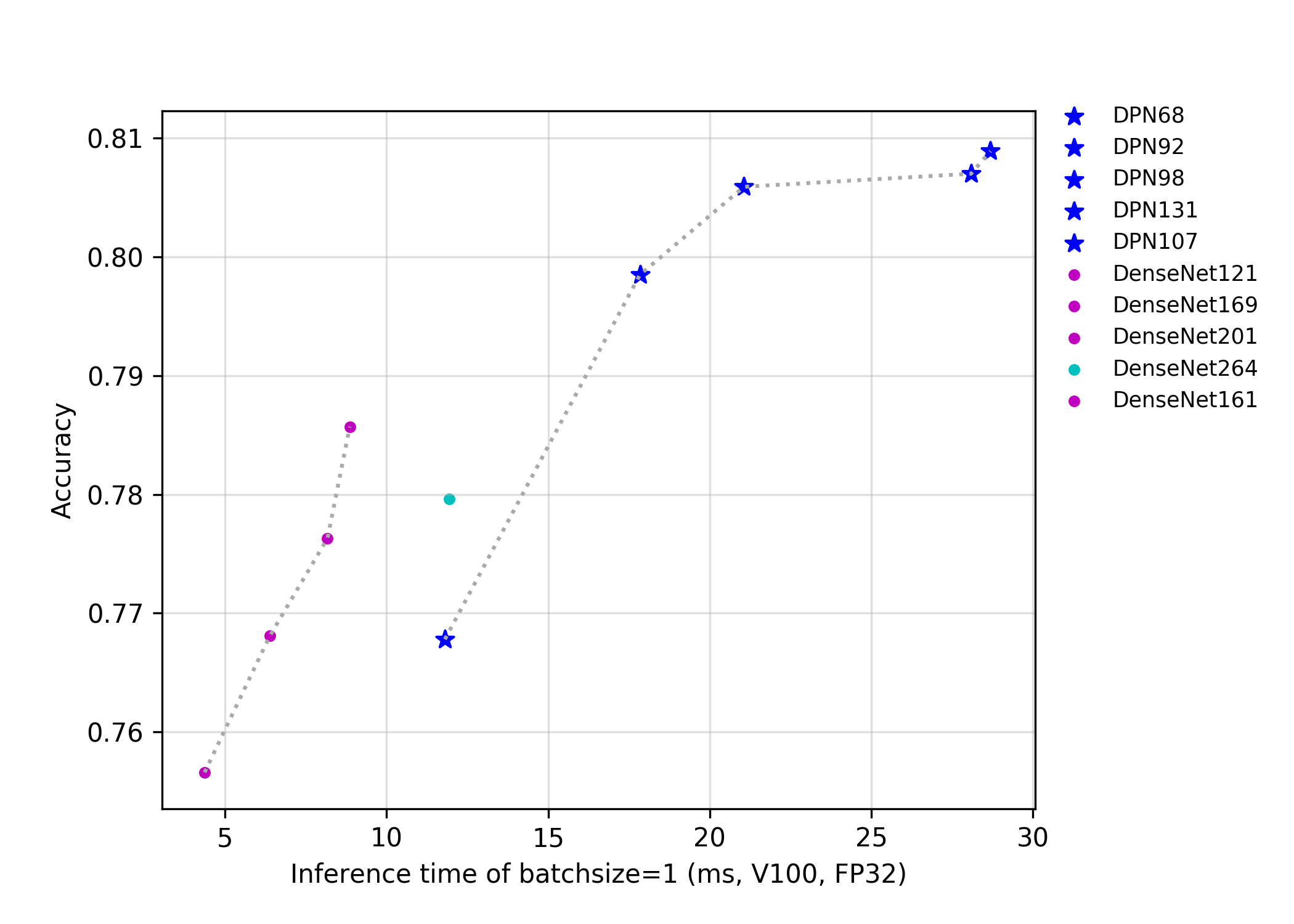

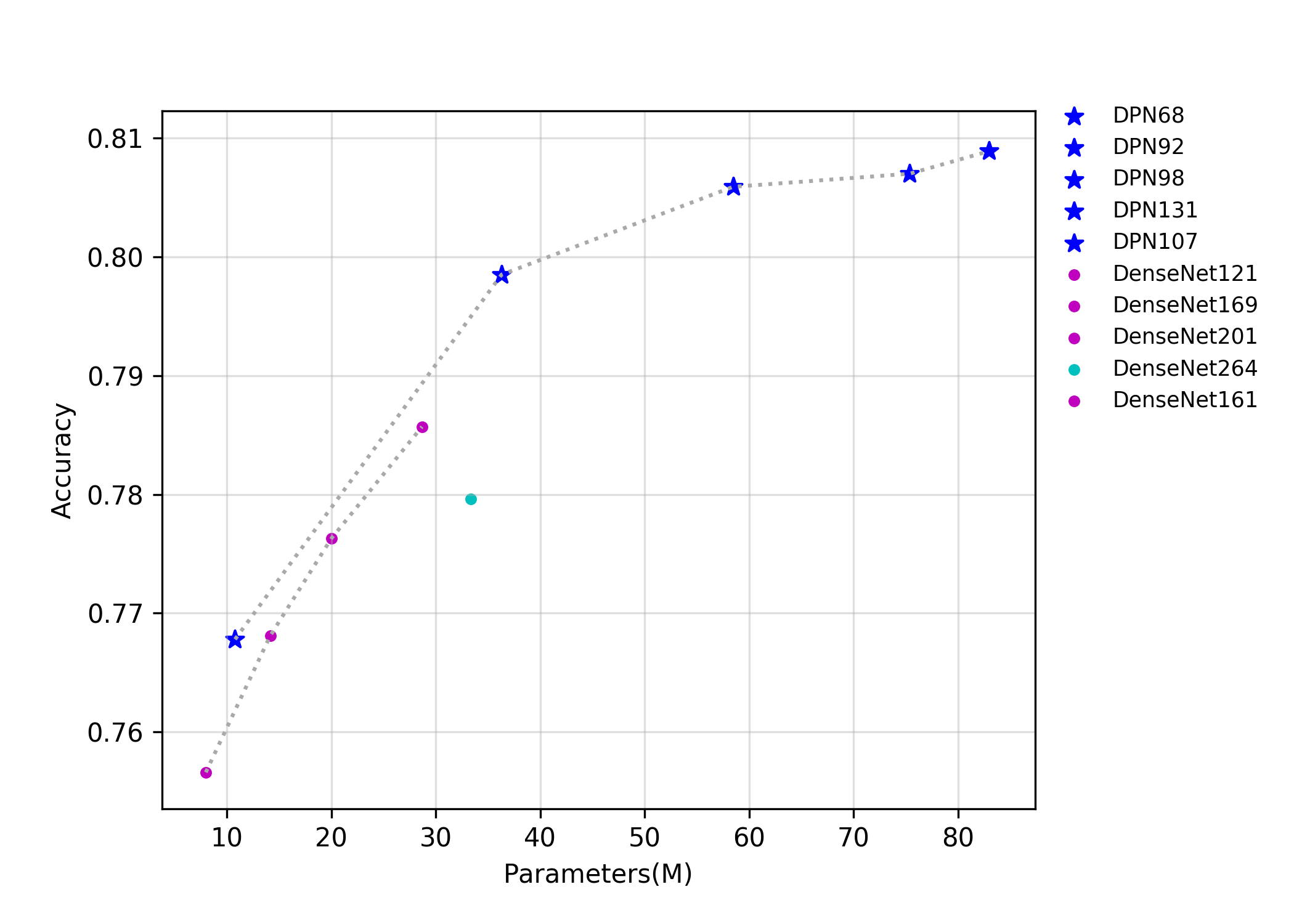

docs/images/models/DPN.png

已删除

100644 → 0

341.6 KB

134.6 KB

140.8 KB

136.6 KB

181.7 KB

194.3 KB

180.0 KB

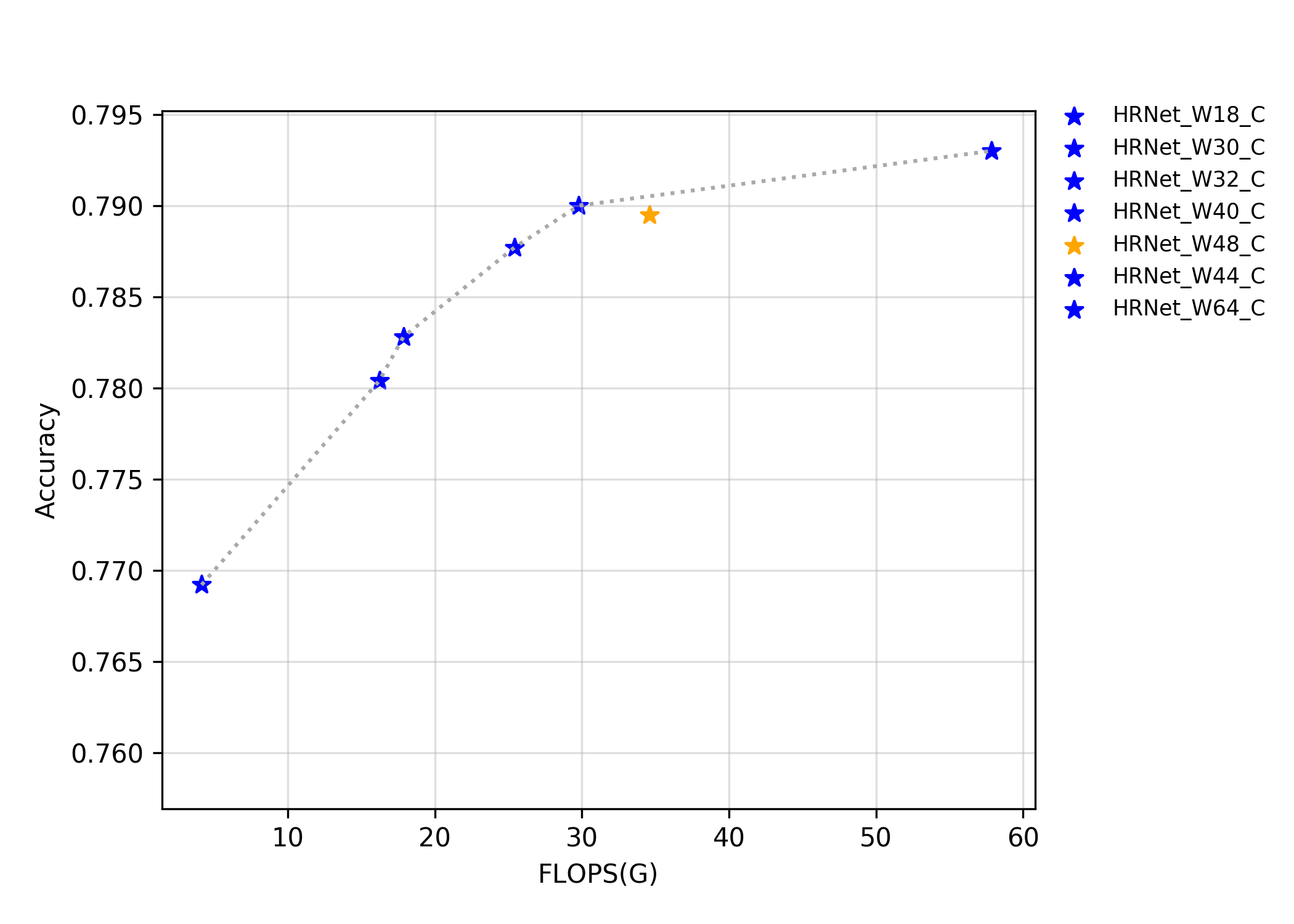

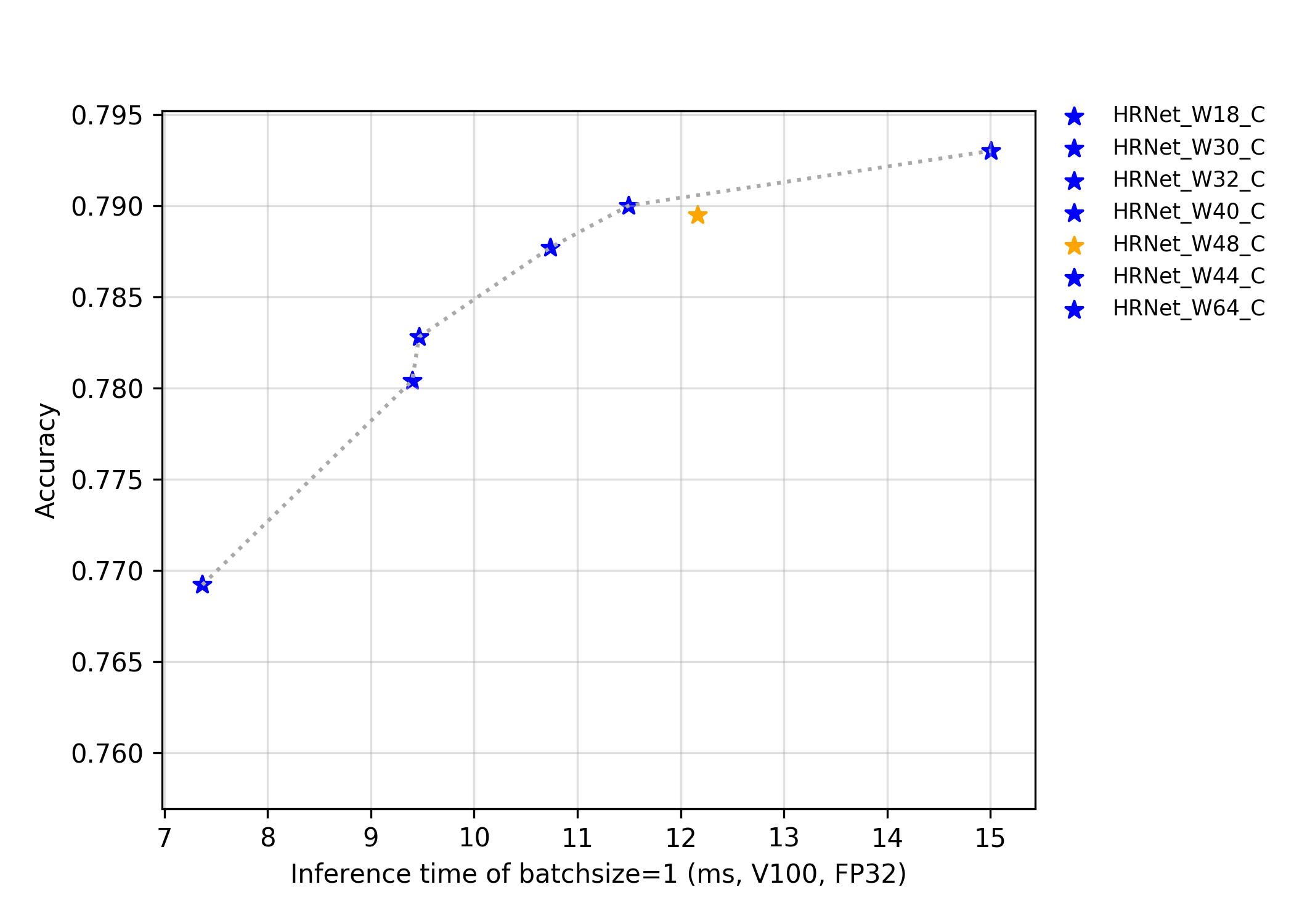

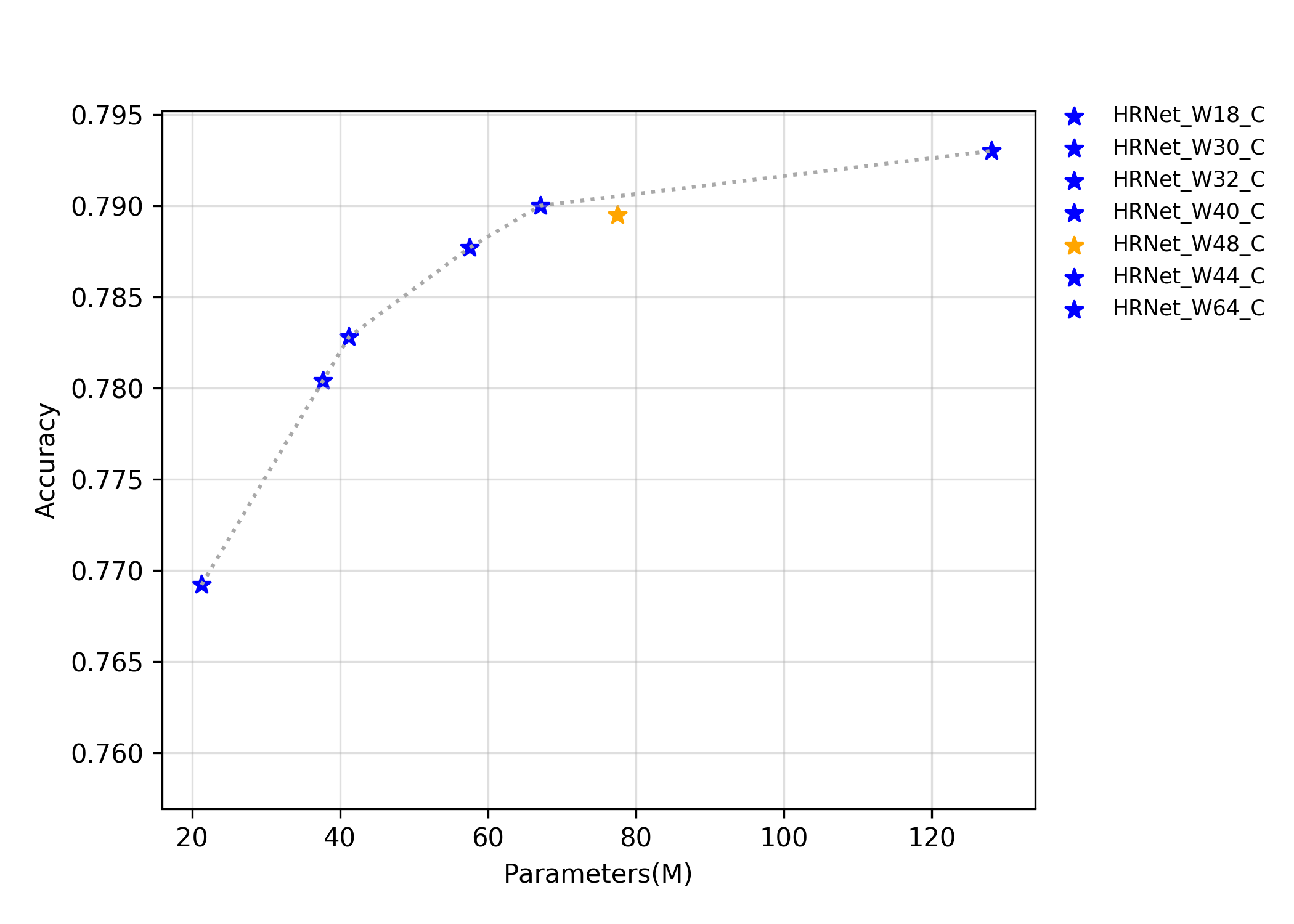

docs/images/models/HRNet.png

已删除

100644 → 0

326.6 KB

126.4 KB

139.0 KB

129.3 KB

344.0 KB

129.1 KB

129.5 KB

132.2 KB

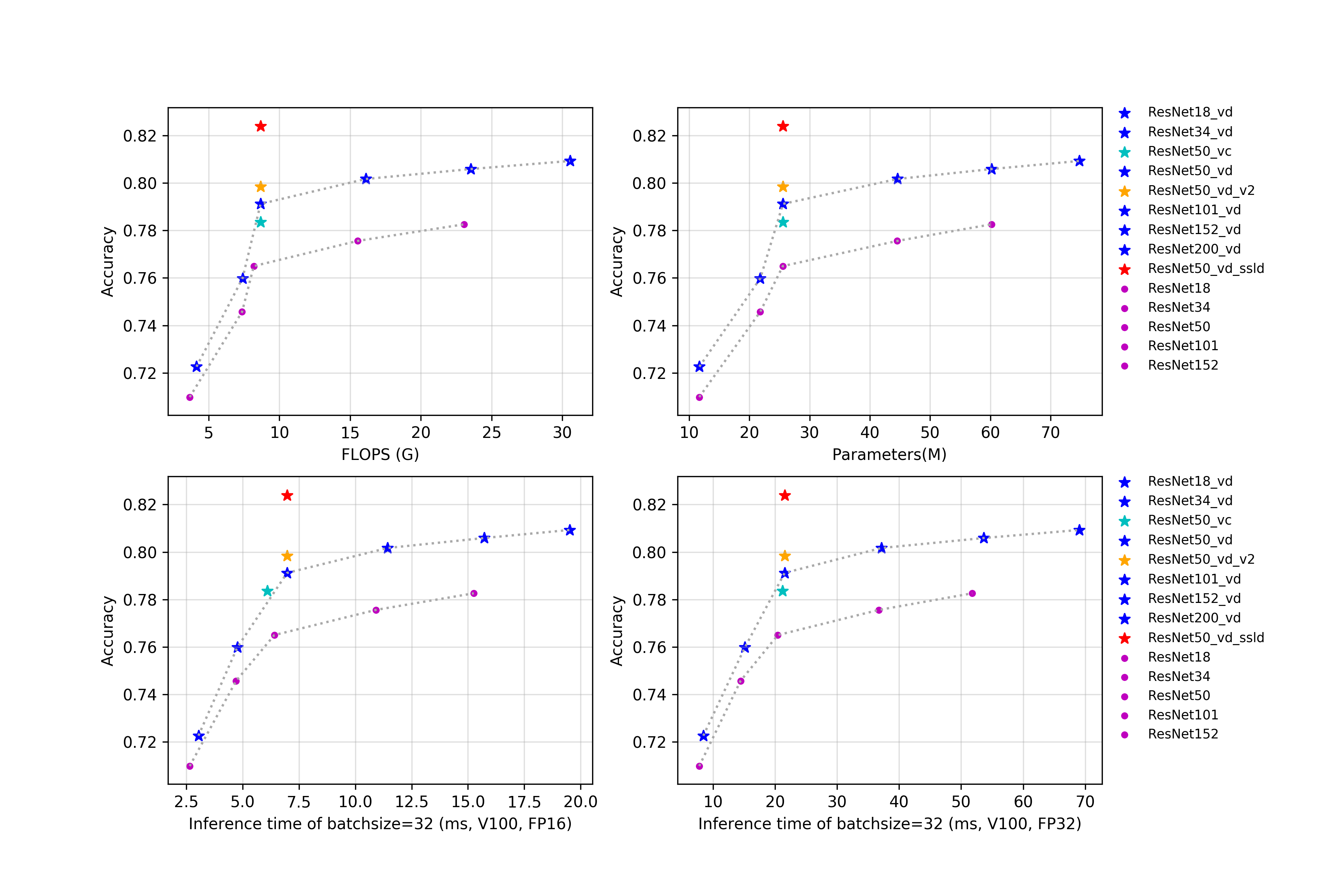

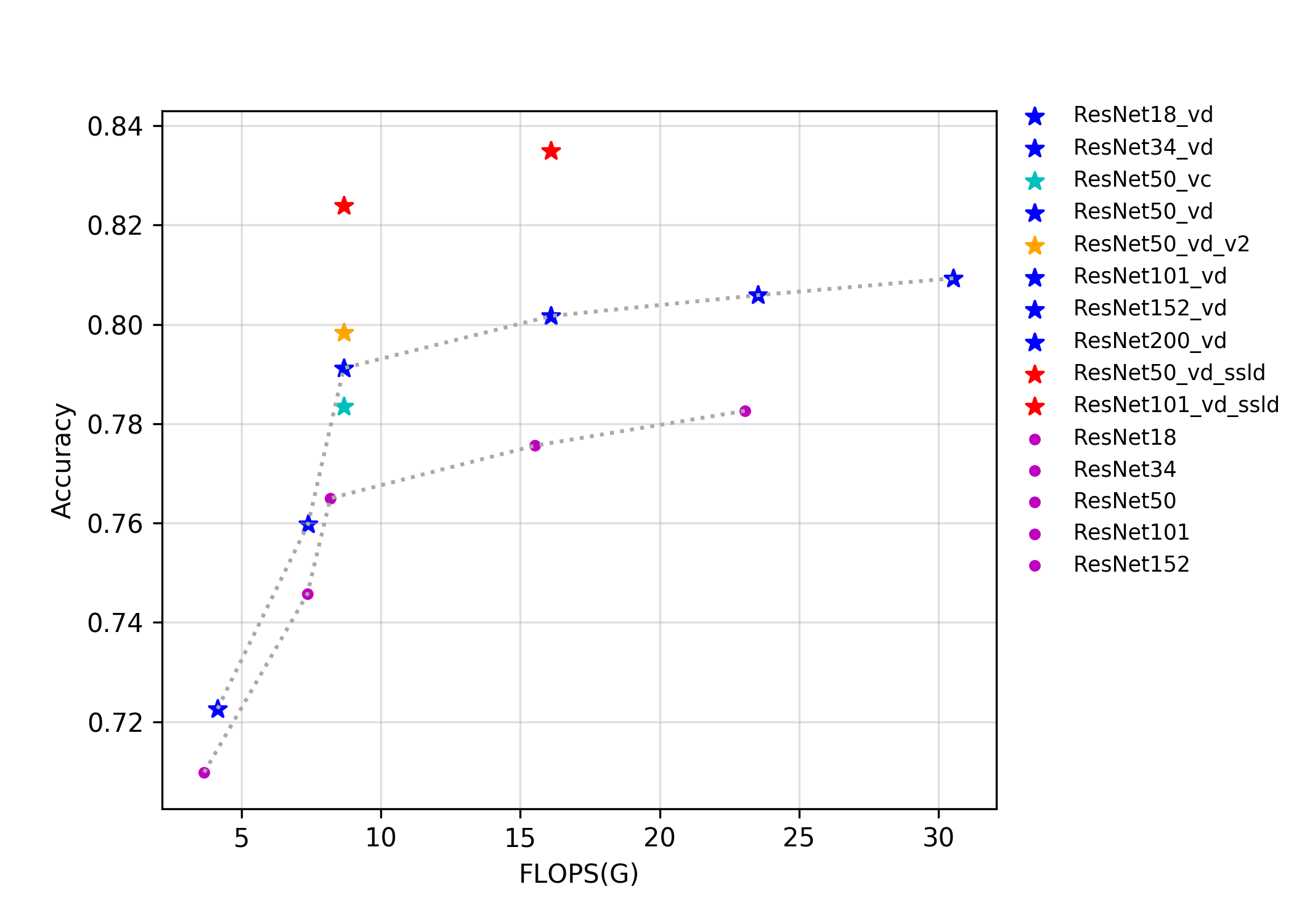

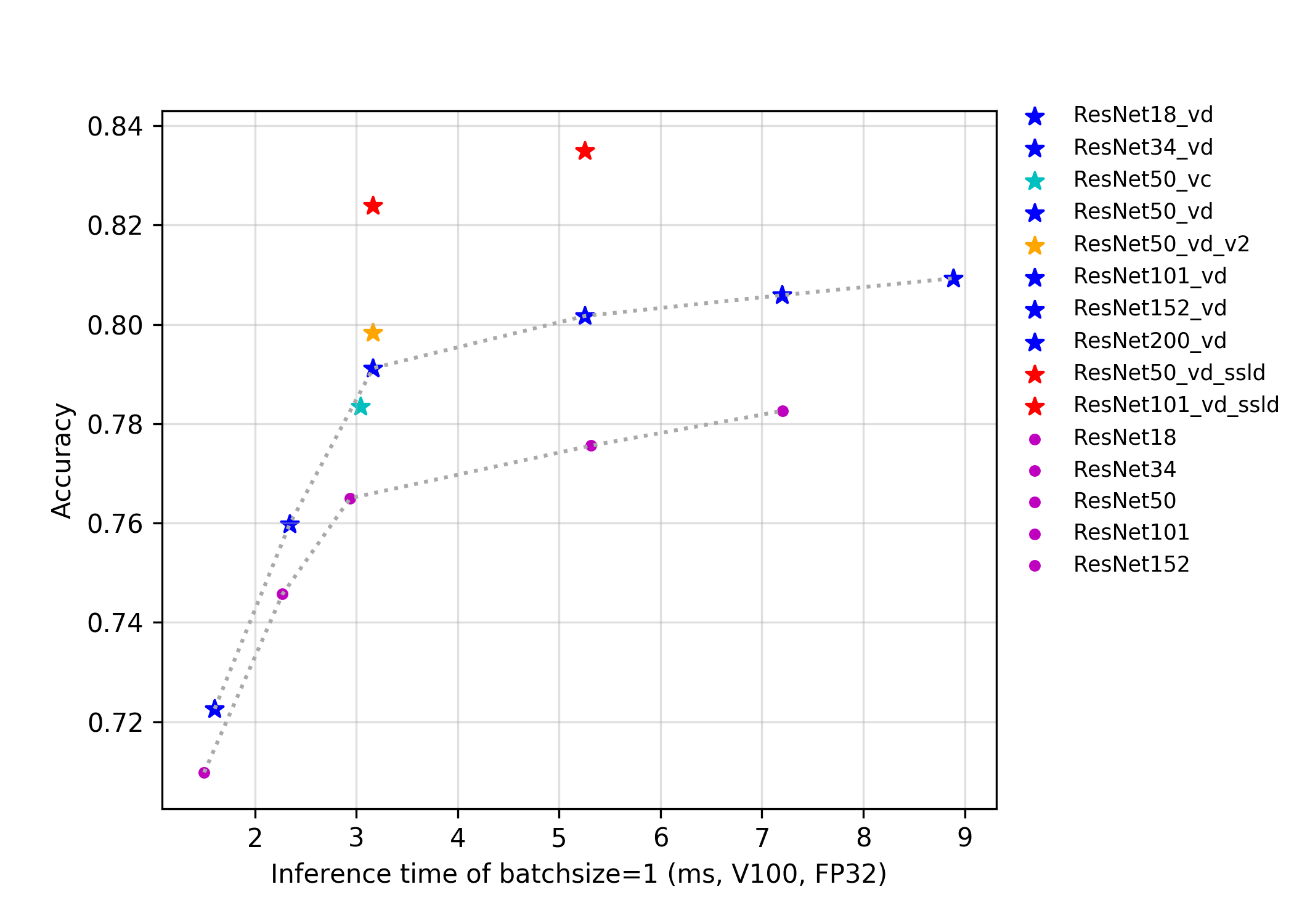

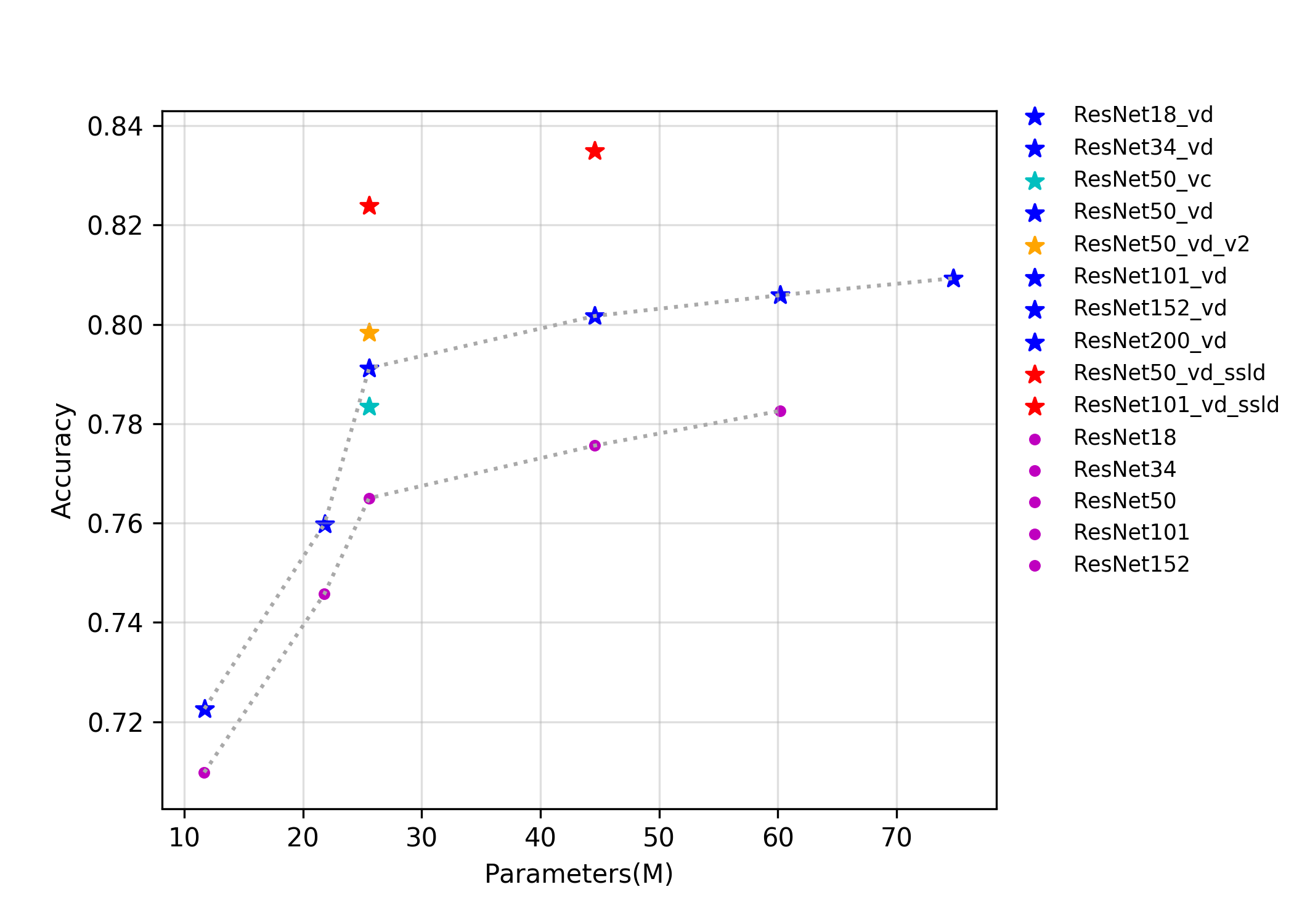

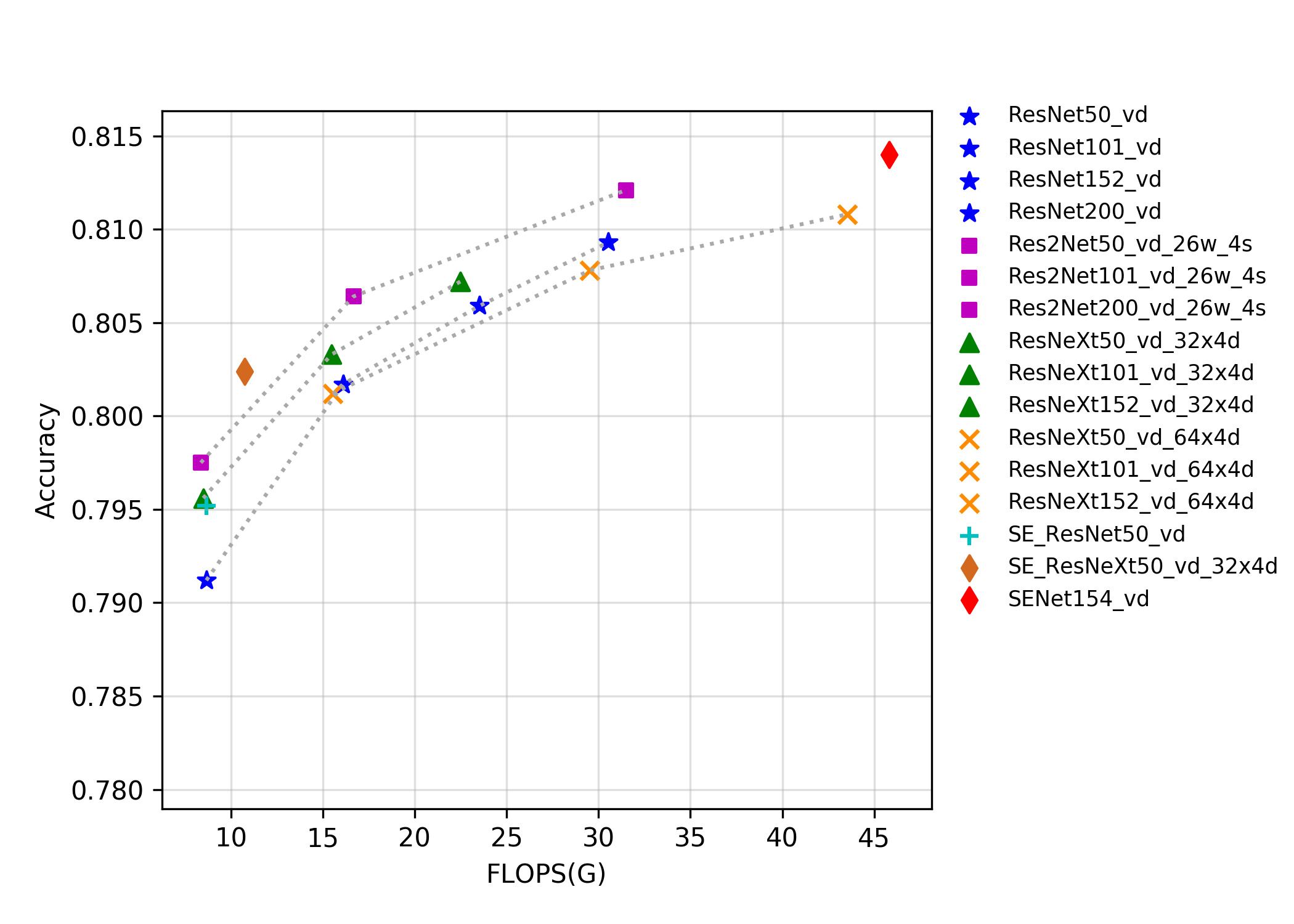

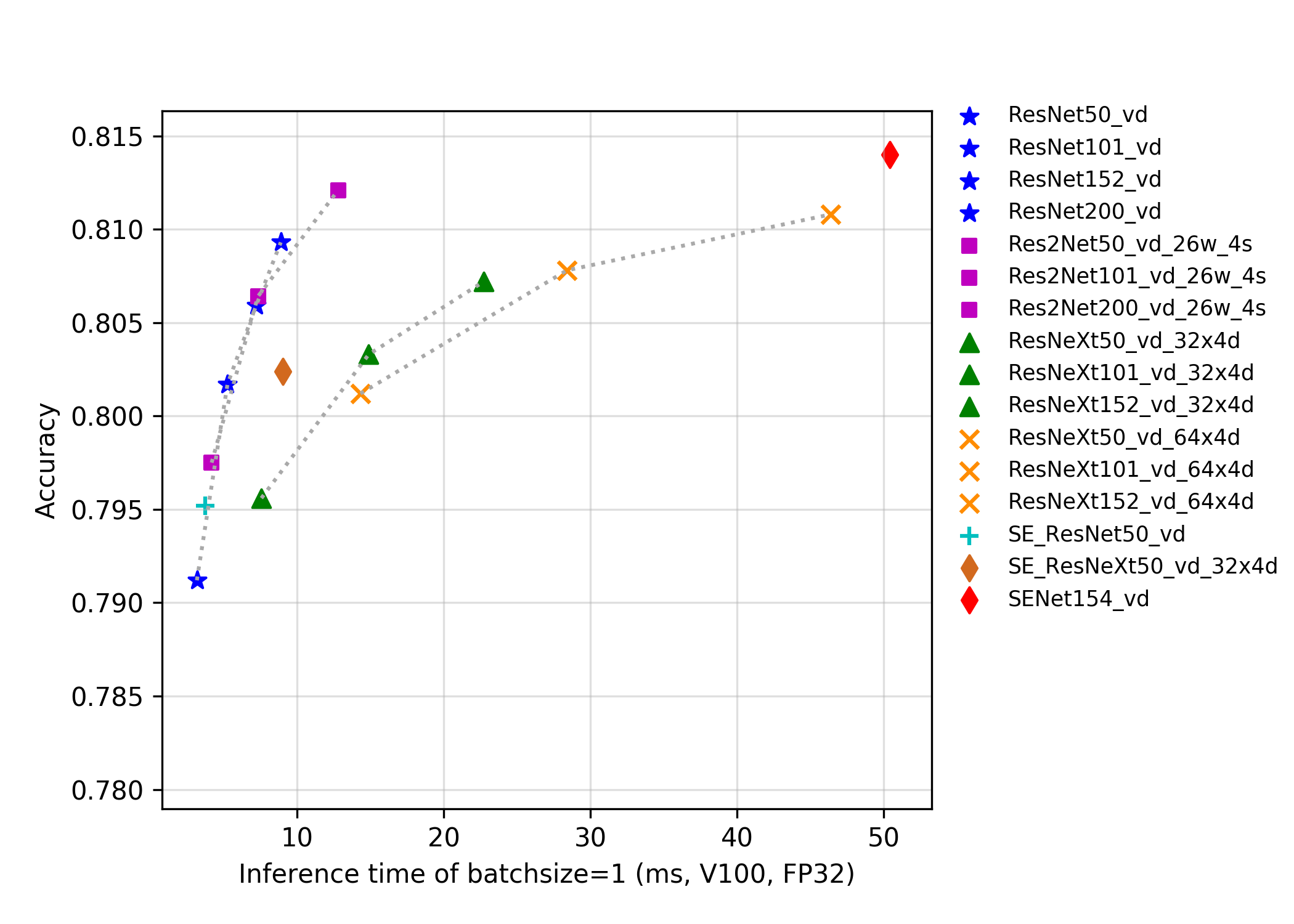

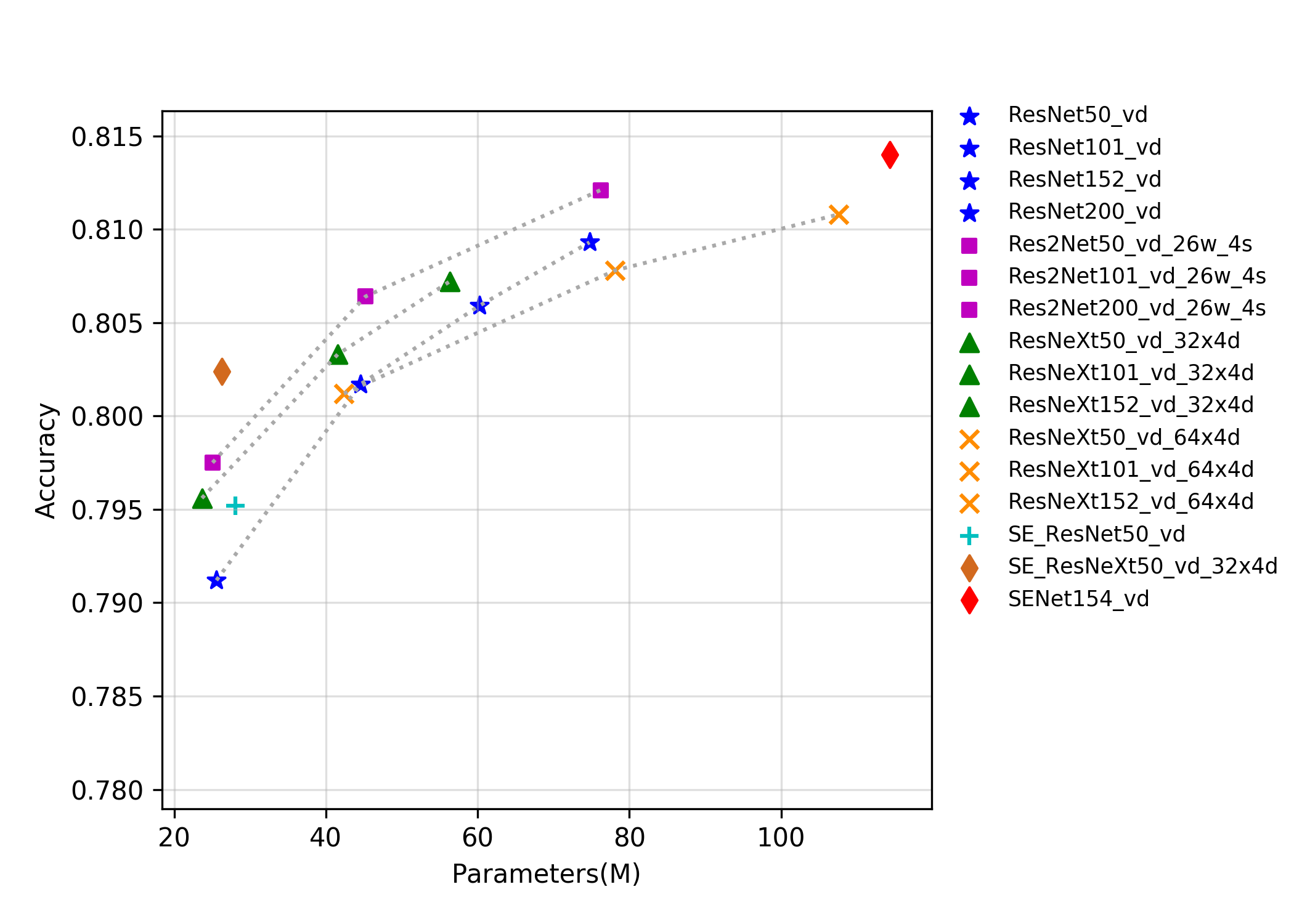

docs/images/models/ResNet.png

已删除

100644 → 0

439.7 KB

185.7 KB

197.9 KB

189.0 KB

581.4 KB

244.9 KB

244.1 KB

244.3 KB

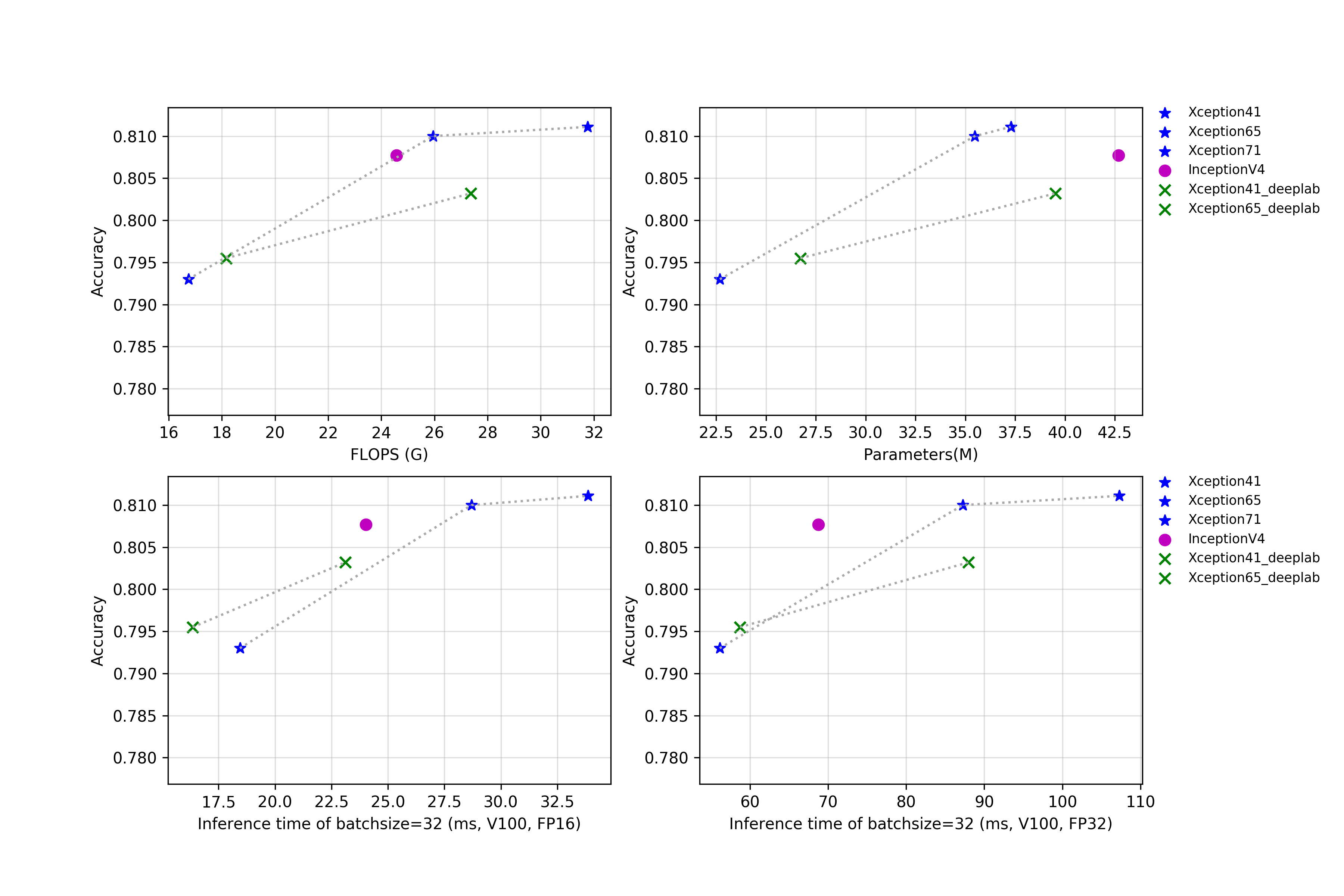

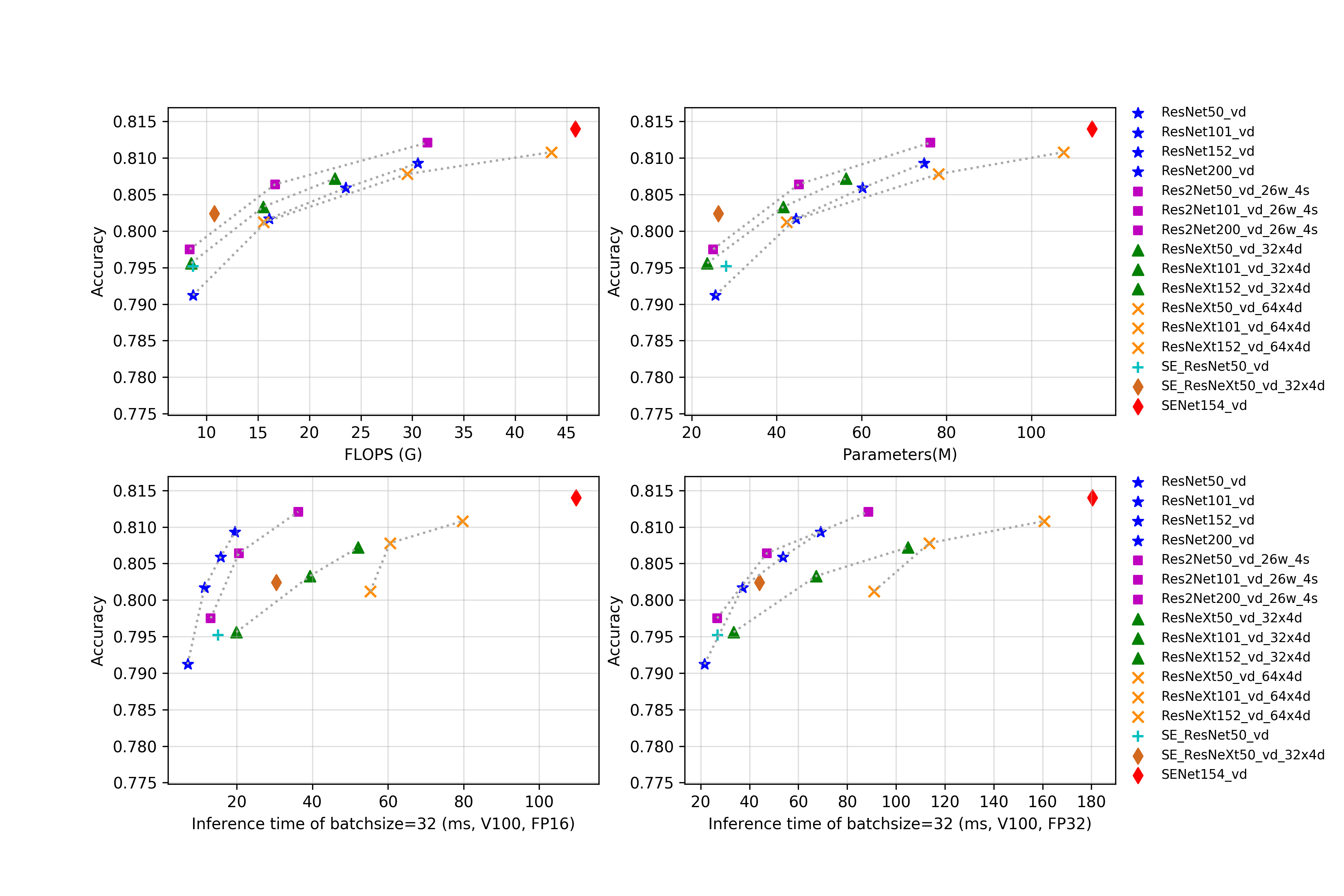

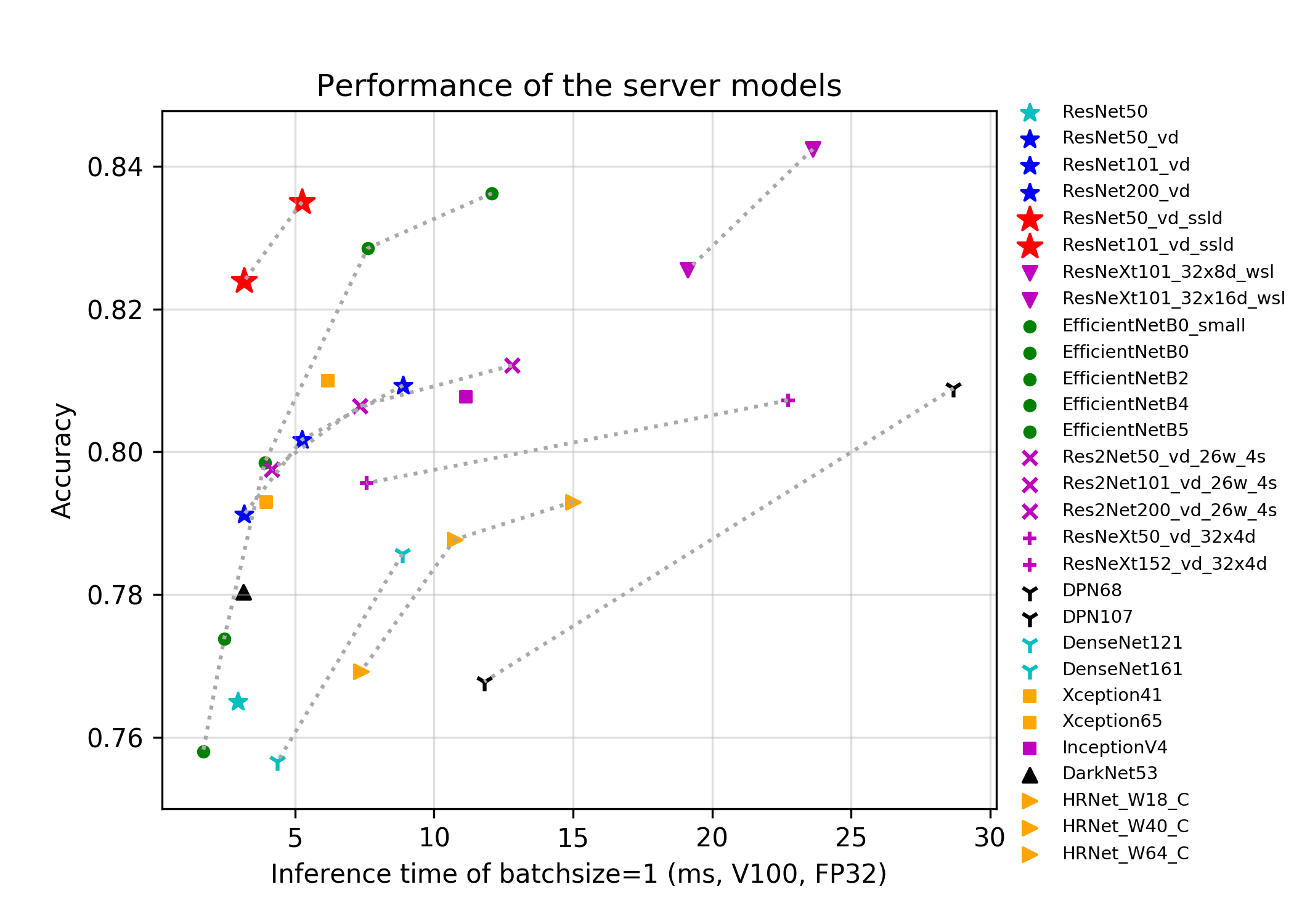

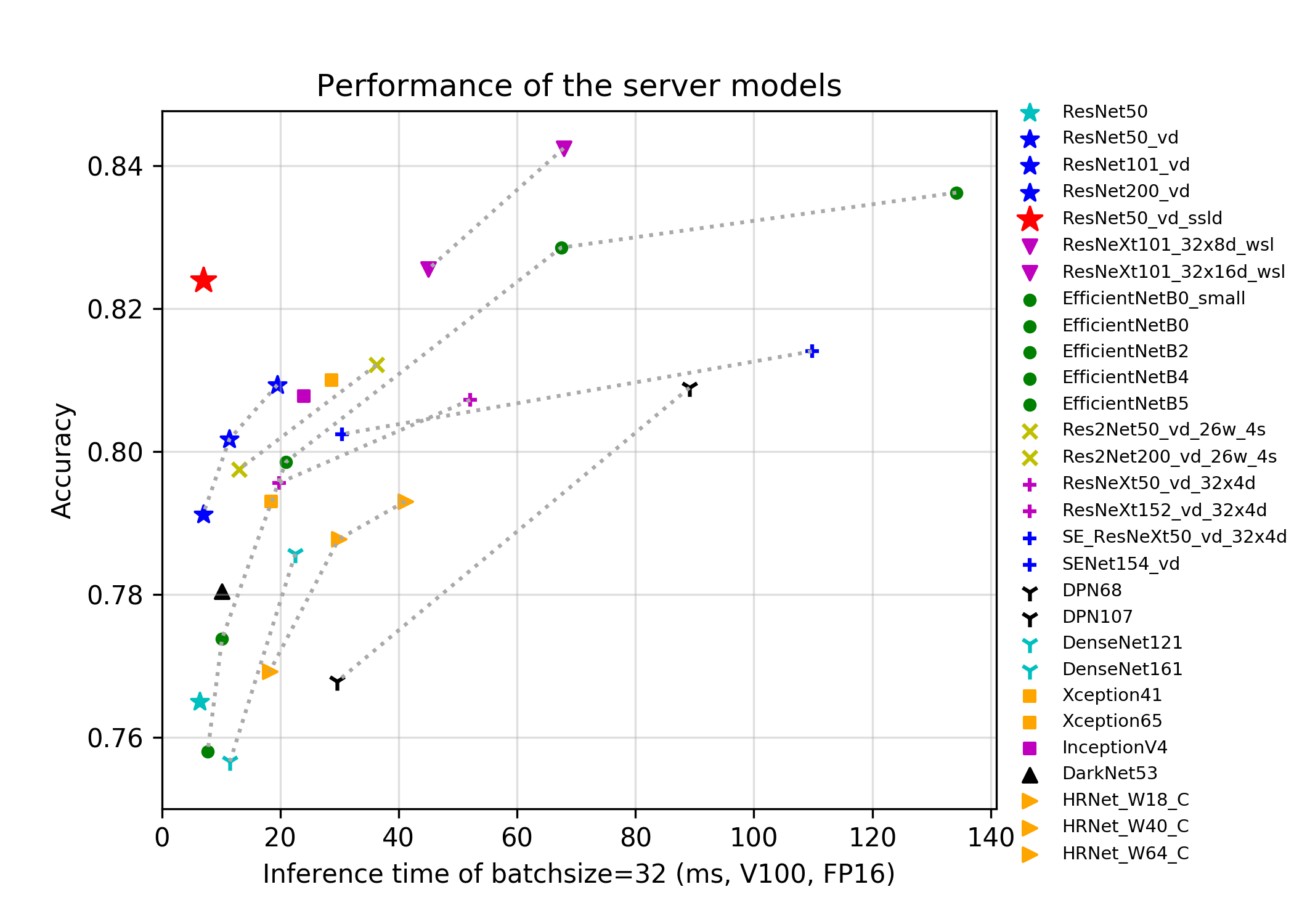

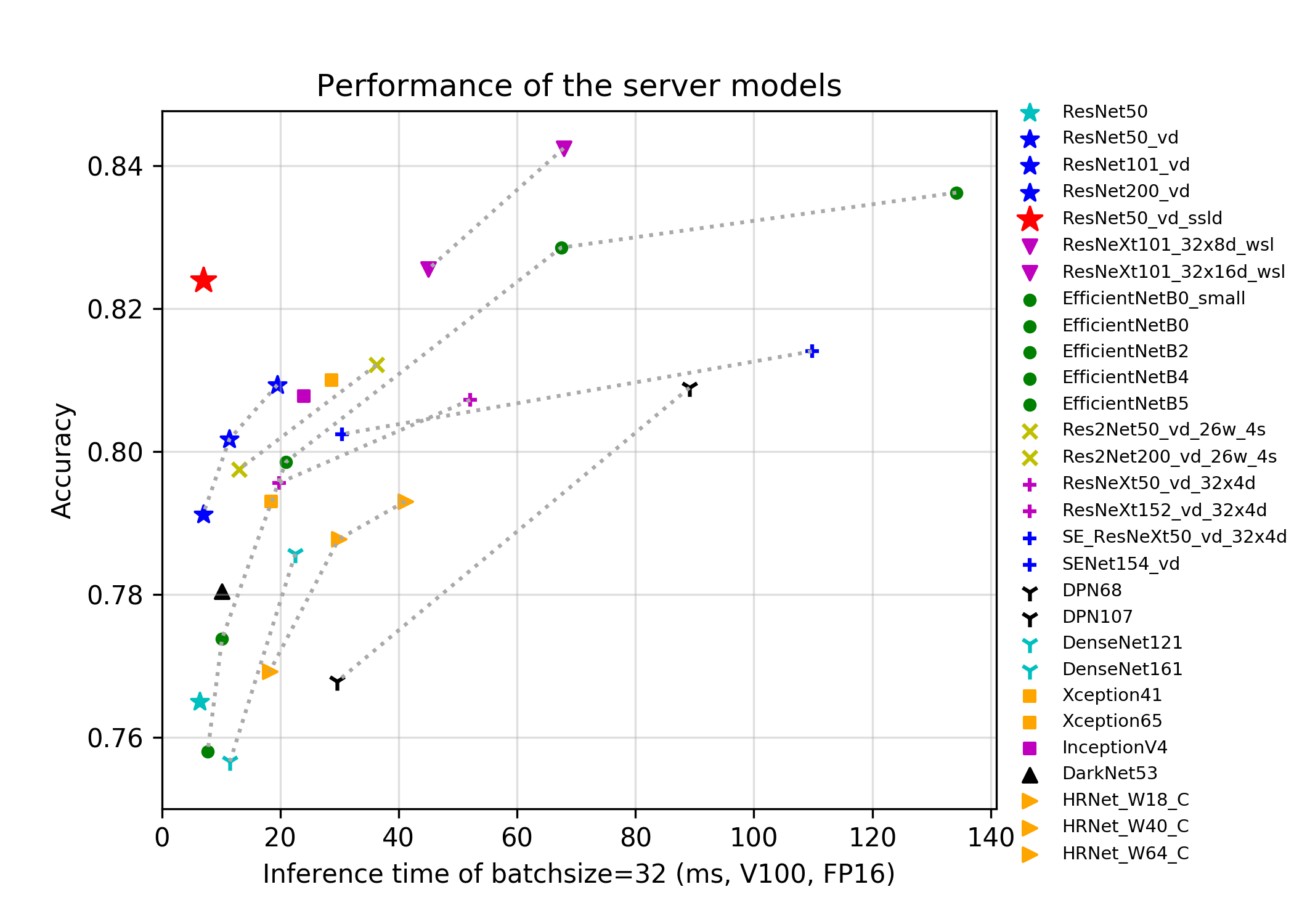

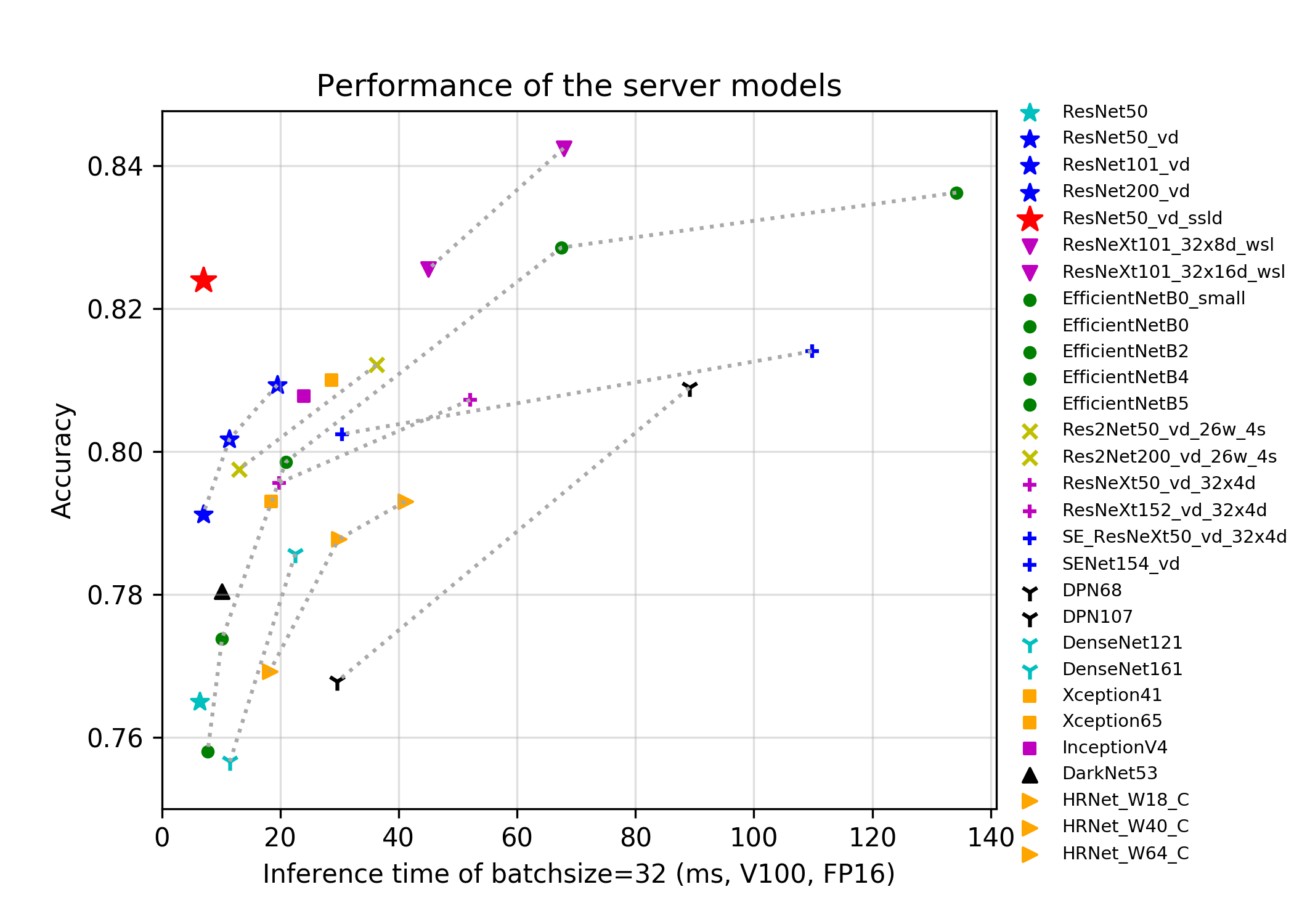

docs/images/models/main_fps_top1.png

100644 → 100755

| W: | H:

| W: | H:

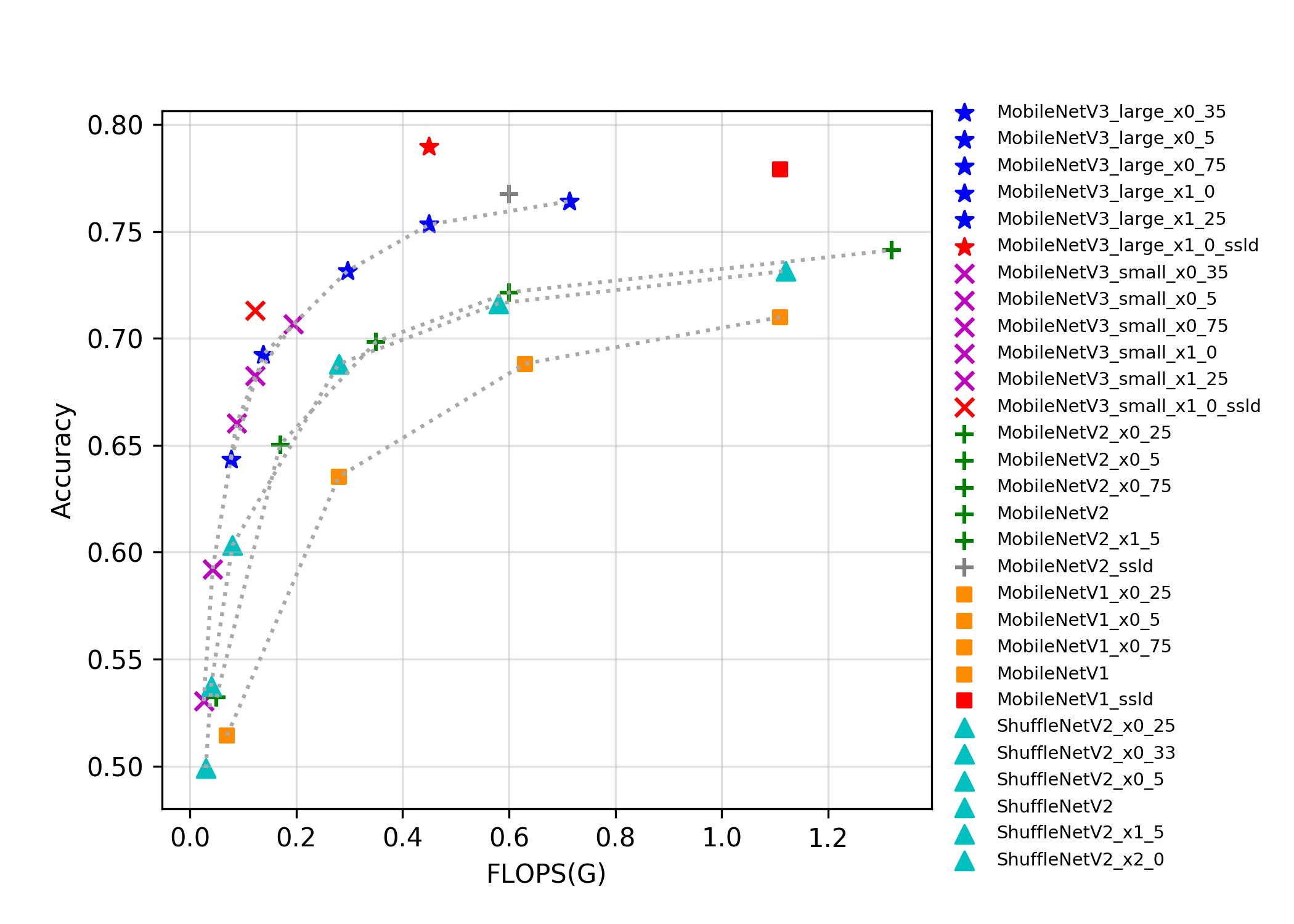

docs/images/models/mobile_arm_storage.png

100644 → 100755

文件模式从 100644 更改为 100755

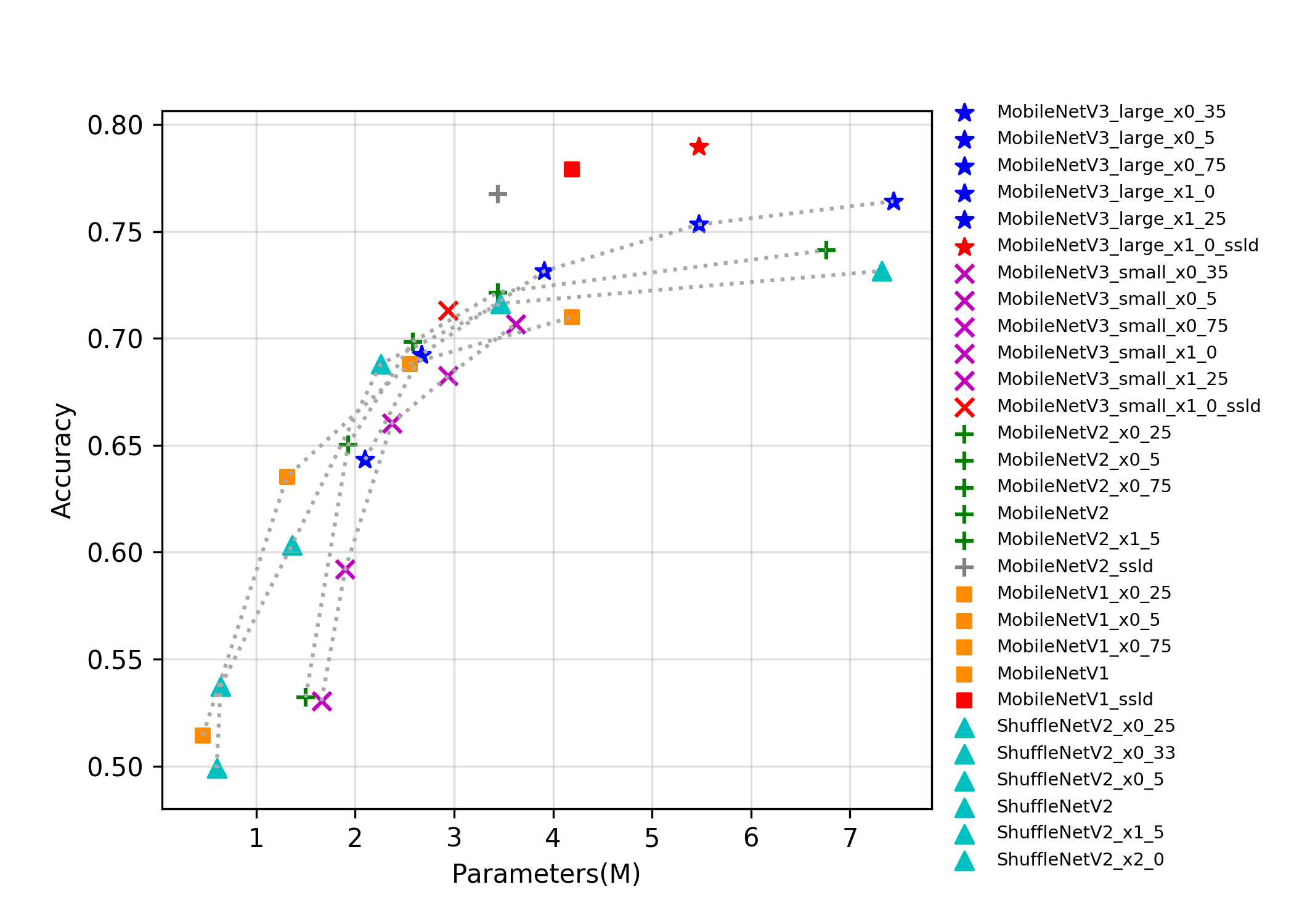

docs/images/models/mobile_arm_top1.png

100644 → 100755

文件模式从 100644 更改为 100755

312.2 KB

313.7 KB