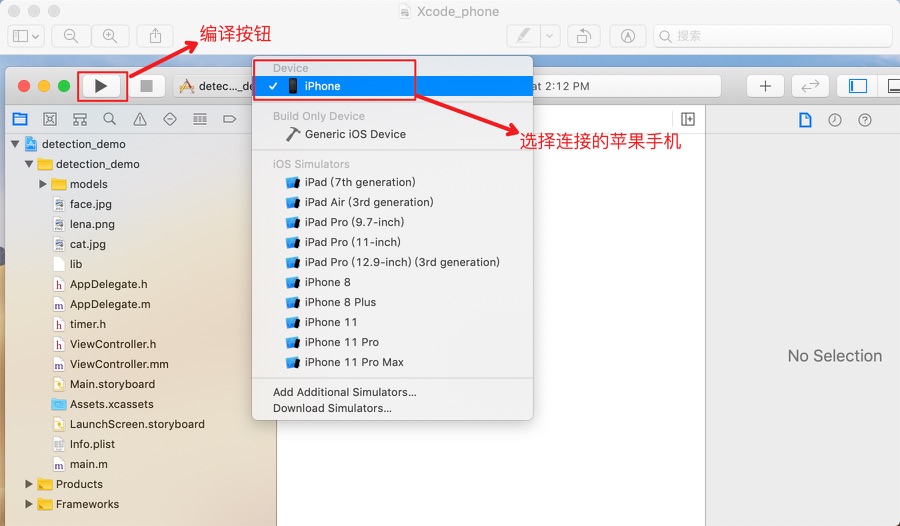

5、按下左上角的 Run按钮,自动编译APP并安装到手机。在苹果手机中设置信任该APP(进入`设置->通用->设备管理`,选中新安装的APP并`验证该应用`)

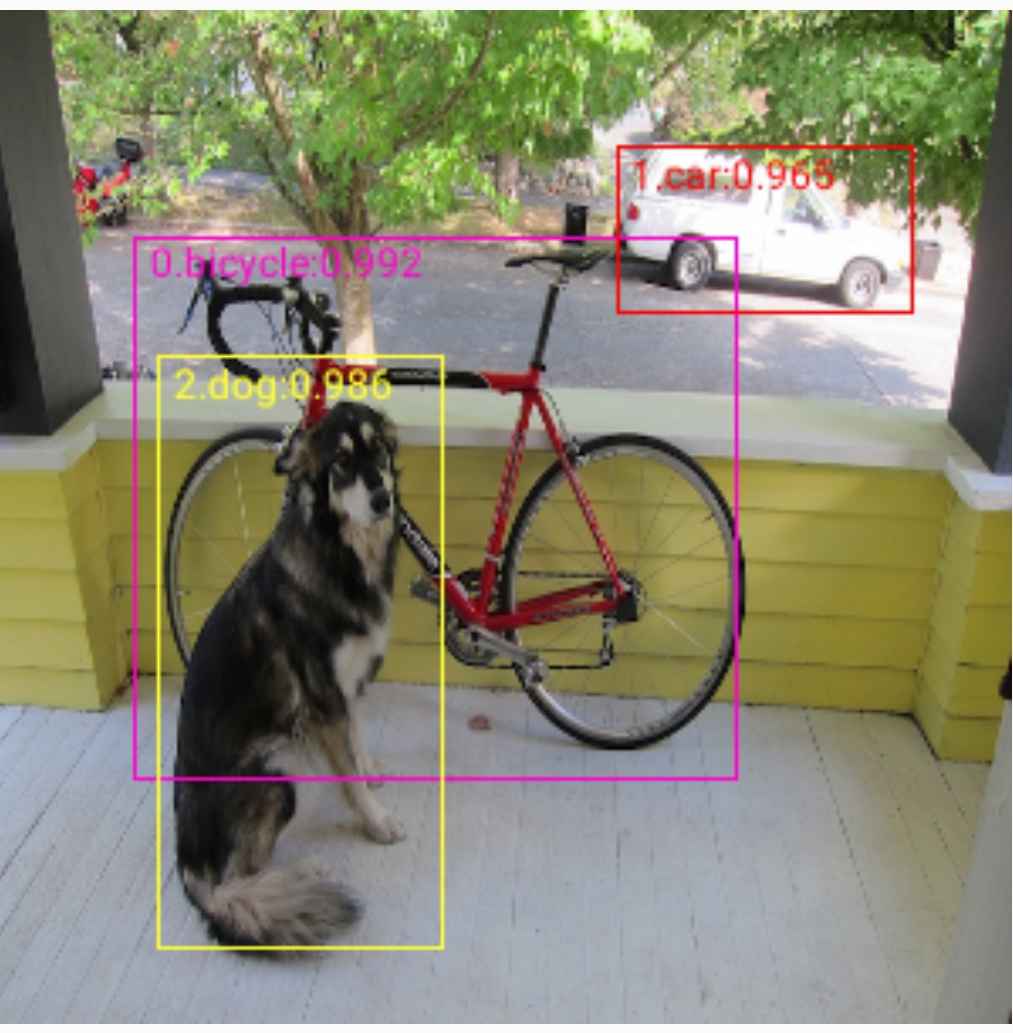

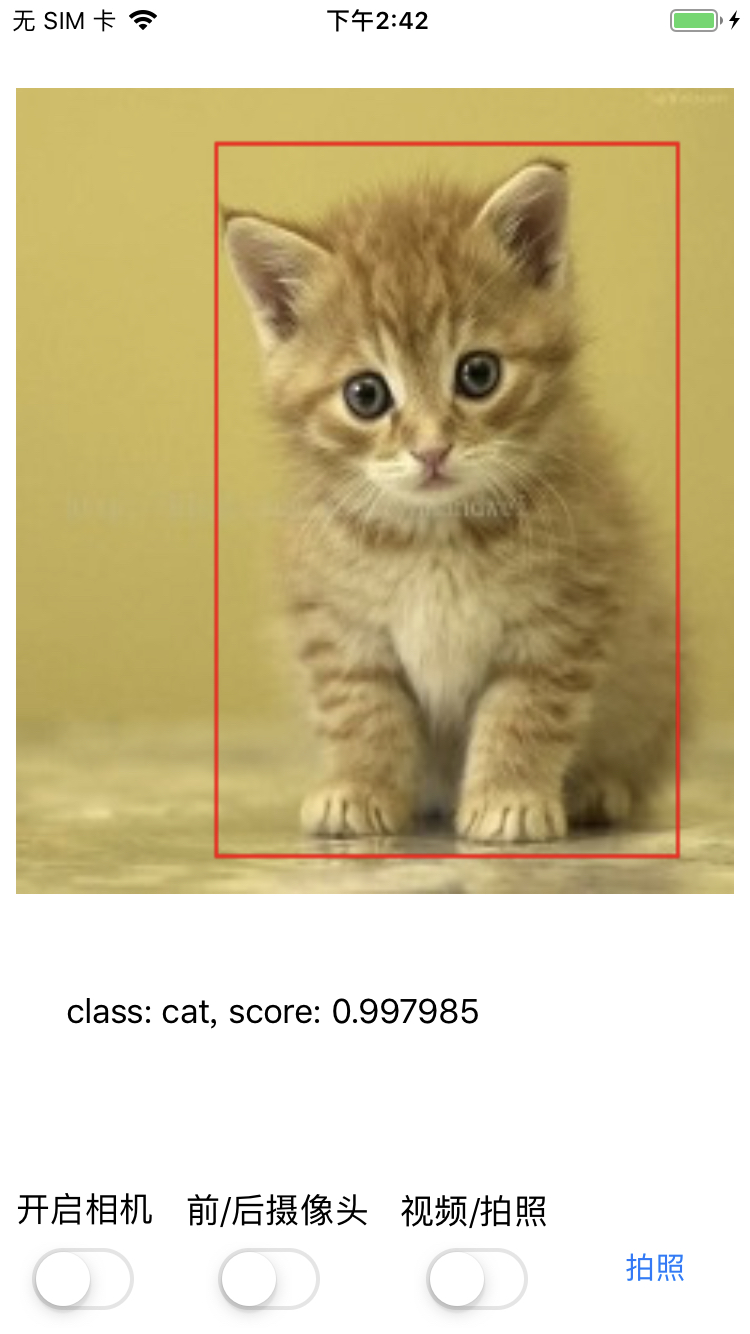

成功后效果如下,图一:APP安装到手机 图二: APP打开后的效果,会自动识别图片中的物体并标记

5、按下左上角的 Run按钮,自动编译APP并安装到手机。在苹果手机中设置信任该APP(进入`设置->通用->设备管理`,选中新安装的APP并`验证该应用`)

成功后效果如下,图一:APP安装到手机 图二: APP打开后的效果,会自动识别图片中的物体并标记

1、 mobilenetv1-ssd: 模型文件 (opt 工具转化后Paddle-Lite模型)

```shell

# 位置:

ios-detection_demo/detection_demo/models/mobilenetv1-ssd

```

2、 libpaddle_api_light_bundled.a、paddle_api.h : Paddle-Lite C++ 预测库和头文件

```shell

# 位置:

# iOS预测库

ios-detection_demo/detection_demo/lib/libpaddle_api_light_bundled.a

# 预测库头文件

ios-detection_demo/detection_demo/include/paddle_api.h

ios-detection_demo/detection_demo/include/paddle_use_kernels.h

ios-detection_demo/detection_demo/include/paddle_use_ops.h

```

3、 ViewController.mm:主要预测代码

```shell

# 位置

ios-detection_demo/detection_demo/ViewController.mm

```

## 代码讲解 (如何使用Paddle-Lite C++ API 执行预测)

IOS 示例基于C++ API 开发,调用Paddle-Lite C++ API包括以下五步。更详细的API 描述参考: [Paddle-Lite C++ API](https://paddle-lite.readthedocs.io/zh/latest/api_reference/java_api_doc.html)。

```c++

#include

1、 mobilenetv1-ssd: 模型文件 (opt 工具转化后Paddle-Lite模型)

```shell

# 位置:

ios-detection_demo/detection_demo/models/mobilenetv1-ssd

```

2、 libpaddle_api_light_bundled.a、paddle_api.h : Paddle-Lite C++ 预测库和头文件

```shell

# 位置:

# iOS预测库

ios-detection_demo/detection_demo/lib/libpaddle_api_light_bundled.a

# 预测库头文件

ios-detection_demo/detection_demo/include/paddle_api.h

ios-detection_demo/detection_demo/include/paddle_use_kernels.h

ios-detection_demo/detection_demo/include/paddle_use_ops.h

```

3、 ViewController.mm:主要预测代码

```shell

# 位置

ios-detection_demo/detection_demo/ViewController.mm

```

## 代码讲解 (如何使用Paddle-Lite C++ API 执行预测)

IOS 示例基于C++ API 开发,调用Paddle-Lite C++ API包括以下五步。更详细的API 描述参考: [Paddle-Lite C++ API](https://paddle-lite.readthedocs.io/zh/latest/api_reference/java_api_doc.html)。

```c++

#include