Add Elastic CTR Document (#1502)

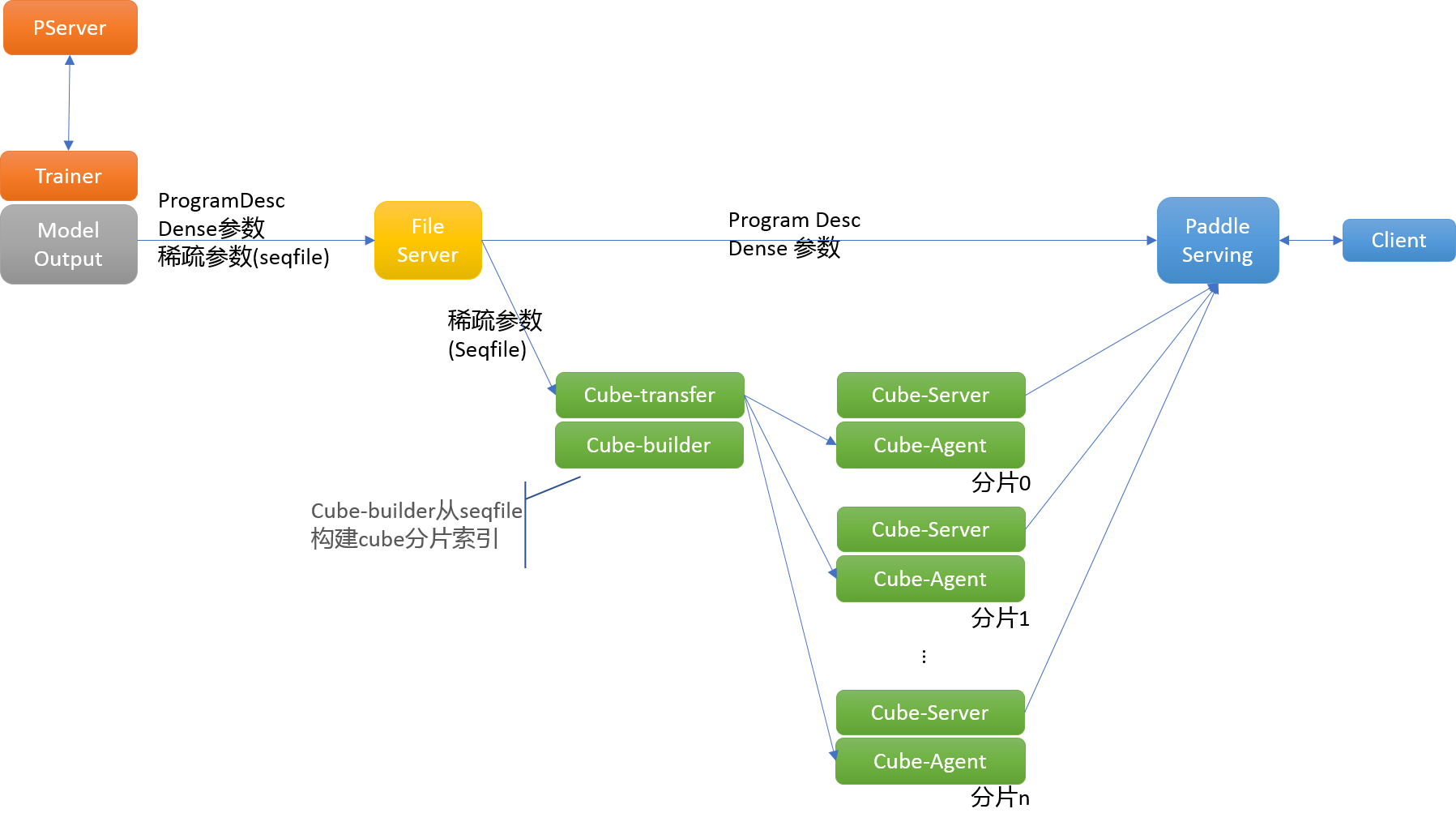

new document to upload in this PR the previous doc talks about how to run CTR training on Baidu Cloud K8S Cluster. the new doc are modified in following points. 1.Run CTR Training on Baidu Cloud K8S + Huawei Volcano 2.Auto Split CTR model into sparse ones and dense ones. 3.Cube auto fetch Sparse model, Serving auto fetch dense model. 4.provide paddle serving client to test the ctr prediction.

Showing

98.2 KB

109.7 KB

70.9 KB

320.5 KB

42.5 KB

75.6 KB

39.1 KB

13.9 KB

24.7 KB

45.3 KB

22.6 KB

23.7 KB

163.6 KB

138.9 KB

33.9 KB

39.3 KB

125.1 KB

164.3 KB

| W: | H:

| W: | H:

155.7 KB

131.0 KB

65.6 KB

56.3 KB

104.4 KB

178.2 KB

107.1 KB

150.9 KB

98.0 KB

107.3 KB

547.4 KB

145.4 KB

104.8 KB

456.1 KB

603.7 KB