集成学习,就是机器学习里面的协同作战

咖哥问:“小冰会看打篮球吗?”

小冰说:“我不是球迷,但偶尔也看。”

咖哥又说:“嗯,在球赛中,防守方的联防策略是非常有效的,几个队员彼此照应,随时协防、换位、补位、护送等,相互帮助,作为一个整体作战,面对再凶猛的进攻球员,也能够把他拿下。”

“咖哥,”小冰说,“本课的内容……说完球再讲?”

“本课就是要讲一讲,这种‘协同作战’的威力……”咖哥回道。

“什么?!”小冰惊讶地说。

集成学习,就是机器学习里面的协同作战!如果训练出一个模型比较弱,又训练出一个模型还是比较弱,但是,几个不大一样的模型组合起来,很可能其效率会好过一个单独的模型。这个思路导出的随机森林、梯度提升决策树,以及XGBoost等算法,都是常用的、有效的、经常在机器学习竞赛中夺冠的“法宝”。

集成学习,就是机器学习里面的协同作战

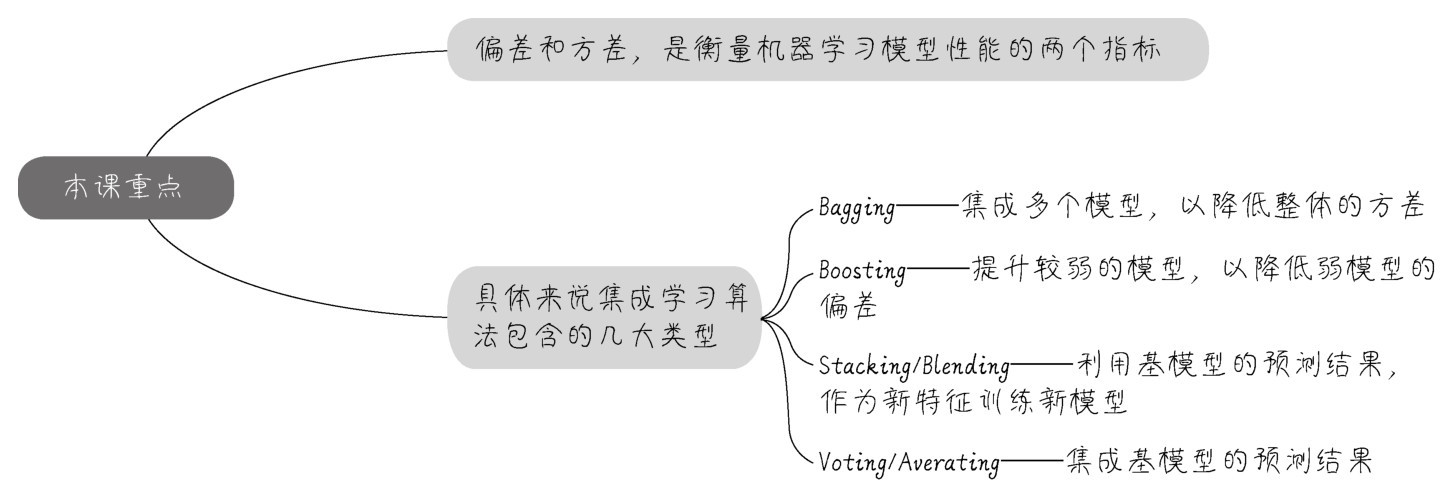

下面看看本课重点。

集成学习,是通过构建出多个模型(这些模型可以是比较弱的模型),然后将它们组合起来完成任务。名字听起来比较“高大上”,但它其实是很经典的机器学习算法。在深度学习时代,集成学习仍然具有很高的“江湖地位”。

它的核心策略是通过模型的集成减少机器学习中的偏差(bias)和方差(variance)。