[add] 添加集群监控

Showing

docs/53.监控Kubernetes集群应用.md

0 → 100644

docs/54.监控Kubernetes集群节点.md

0 → 100644

19.1 KB

78.4 KB

151.3 KB

115.3 KB

217.6 KB

342.2 KB

96.7 KB

149.0 KB

docs/images/redis-graph.png

0 → 100644

70.1 KB

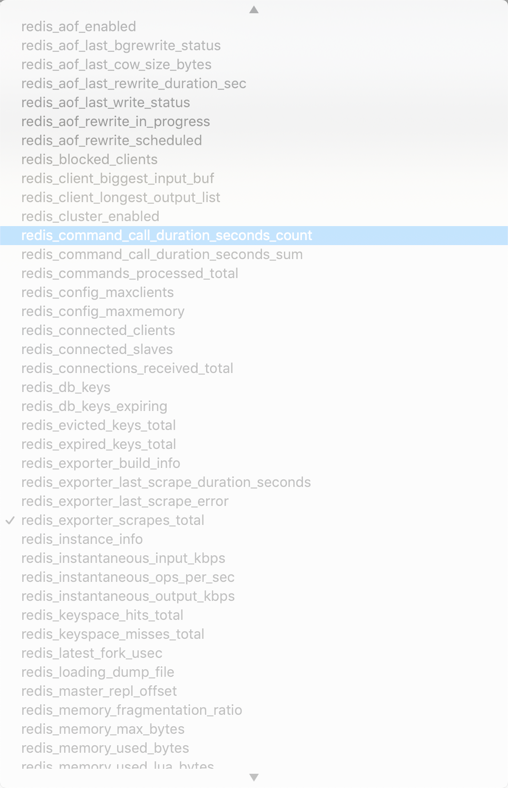

docs/images/redis-metrics.png

0 → 100644

219.7 KB

prome/prome-cm.yaml

0 → 100644

prome/prome-deploy.yaml

0 → 100644

prome/prome-rbac.yaml

0 → 100644

prome/prome-svc.yaml

0 → 100644

prome/prome-volume.yaml

0 → 100644