update cluster design

Showing

文件已移动

33.1 KB

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

文件已移动

文件已添加

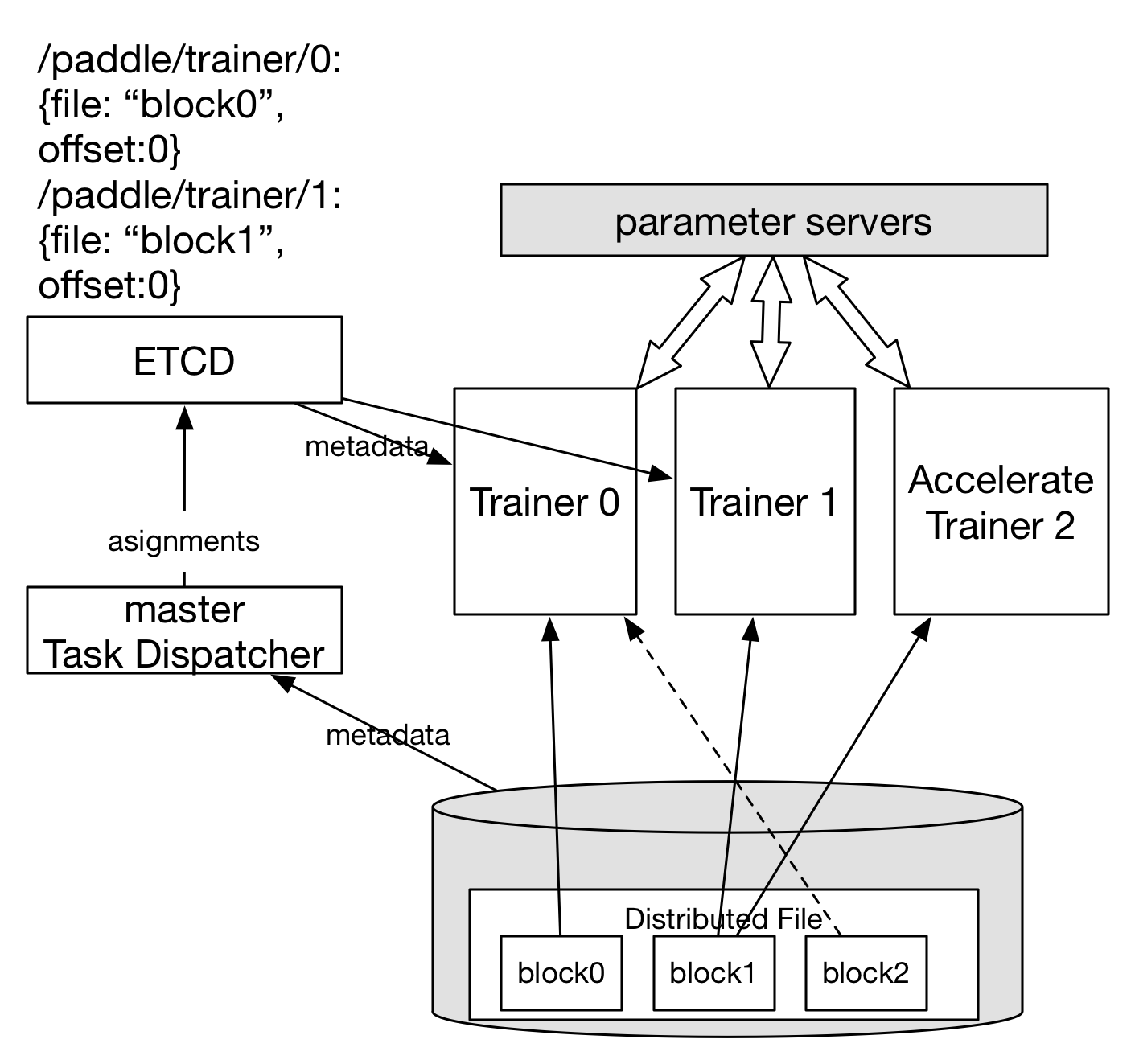

doc/design/images/master.png

已删除

100644 → 0

162.2 KB

文件已删除

134.9 KB